En mars 2026, la gestion des coûts d'infrastructure cloud représente un défi majeur pour les développeurs d'applications IA. Un développeur a récemment partagé sur Hacker News sa solution innovante : un circuit breaker applicatif pour Cloudflare Workers qui surveille et contrôle automatiquement la consommation de ressources avant que les dépassements de quota ne deviennent problématiques.

Le problème des limites cachées dans les plateformes serverless

Le créateur de 3mins.news, un agrégateur d'actualités IA entièrement construit sur Cloudflare Workers, a été confronté à une réalité coûteuse : l'offre payante impose des limites mensuelles strictes (10 millions de requêtes, 1 million d'écritures KV, 1 million d'opérations de file d'attente). Contrairement aux attentes, aucun mécanisme de pause automatique n'existe. Une fois la limite atteinte, les plateformes cloud facturent simplement des dépassements.

Les écritures KV coûtent 5 dollars par million au-delà du quota. Une simple boucle de retry mal configurée peut générer des milliers de dollars de frais en quelques heures. Ce scénario cauchemardesque pousse de nombreux développeurs à surveiller manuellement leurs tableaux de bord, une approche chronophage et peu fiable.

Circuit breaker inversé : une approche préventive innovante

Contrairement au pattern Hystrix classique qui protège contre les défaillances des services externes, ce circuit breaker surveille les ressources internes. L'approche est simple mais efficace : traiter son propre budget de ressources comme un signal de santé applicative, exactement comme on surveillerait le taux d'erreur d'une API tierce.

Cette philosophie rejoint les bonnes pratiques de gouvernance IA qui préconisent une surveillance proactive plutôt que réactive. Les alertes budgétaires AWS arrivent souvent trop tard : le temps de lire l'email, les dégâts sont faits.

Seuils différenciés selon la criticité des ressources

Le système implémente une logique sophistiquée de seuils adaptés à chaque type de ressource :

- Requêtes Workers (0,30 $/million en dépassement) : alerte à 80%, pas de coupure automatique

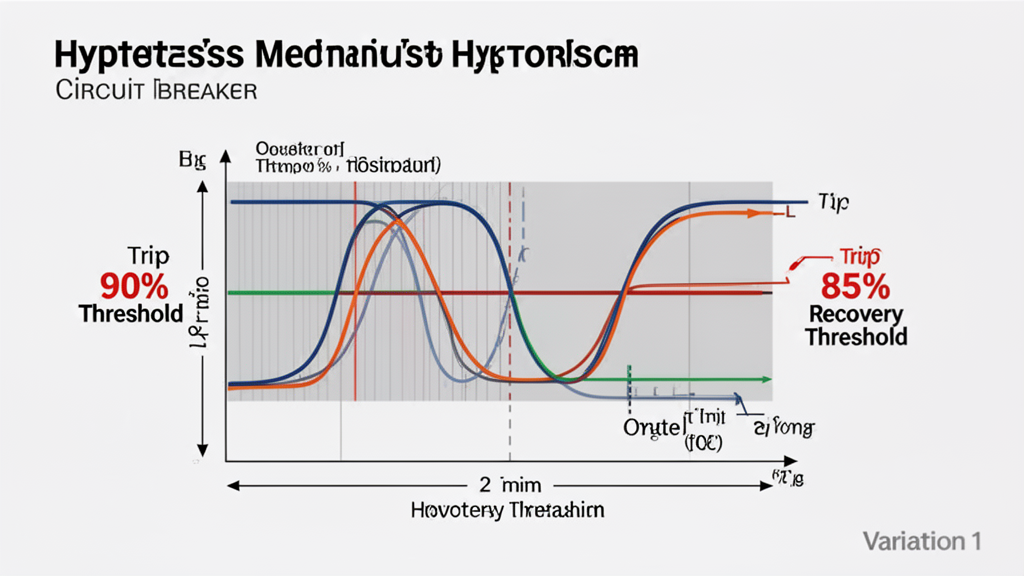

- Écritures KV (5 $/million en dépassement) : coupure à 90%, récupération à 85%

- Opérations de file d'attente : surveillance adaptée au coût réel

- CPU et logs : configuration en mode avertissement uniquement

Cette granularité permet d'éviter les coupures inutiles tout en protégeant contre les ressources les plus coûteuses. Toutes les ressources ne représentent pas le même danger financier, donc certaines restent en surveillance passive.

Architecture technique : efficacité et résilience

L'implémentation repose sur trois piliers techniques qui garantissent performance et fiabilité.

Collecte de métriques en parallèle

Toutes les 5 minutes, le système interroge simultanément deux sources de données Cloudflare :

- API GraphQL pour les requêtes, CPU, KV et files d'attente

- API Observability Telemetry pour les logs et traces

Cette approche parallèle réduit la latence globale et permet d'évaluer 8 dimensions de ressources en une seule passe. Entre deux vérifications, une simple lecture KV suffit, rendant le système pratiquement gratuit à opérer.

Hystérésis pour éviter l'oscillation

Le mécanisme d'hystérésis (déclenchement à 90%, récupération à 85%) constitue une décision d'architecture cruciale. Sans cet écart de 5%, le système basculerait en boucle entre état déclenché et état normal à chaque cycle de vérification. Cette instabilité rendrait le dispositif inutilisable et générerait des centaines d'alertes redondantes.

Ce principe s'applique également dans l'architecture des systèmes cloud modernes où la stabilité prime sur la réactivité immédiate.

Fail-safe sur défaillance de surveillance

Si l'API de métriques Cloudflare devient indisponible, le système conserve le dernier état connu plutôt que d'assumer que tout va bien. Une panne de monitoring ne doit jamais masquer un pic de consommation réel. Cette logique défensive évite les angles morts coûteux.

Résultats en production et cas d'usage réels

Après deux semaines d'exploitation, le système a démontré son efficacité en détectant un pic de lectures KV à 82% en début de mois. Une seule alerte email a été envoyée, permettant d'investiguer et de corriger la cause racine avant d'atteindre le seuil de déclenchement à 90%.

| Métrique | Seuil d'alerte | Seuil de coupure | Coût de dépassement |

|---|---|---|---|

| Requêtes Workers | 80% | Aucun | 0,30 $/million |

| Écritures KV | 80% | 90% | 5 $/million |

| Opérations de file | 80% | 90% | Variable |

| CPU Workers | 80% | Aucun | 0,02 $/million ms |

Dédoublonnement d'alertes intelligent

Le système implémente une déduplication par ressource et par mois. Sans cette fonctionnalité, un franchissement de seuil à 80% générerait environ 8 600 emails identiques pour le reste du mois (une toutes les 5 minutes). Cette logique évite la saturation des boîtes mail tout en maintenant la visibilité nécessaire.

Les développeurs d'applications IA, notamment ceux qui intègrent des modèles dans leurs infrastructures, peuvent particulièrement bénéficier de cette approche pour contrôler les coûts d'inférence.

Applicabilité à d'autres plateformes serverless

Le pattern s'étend naturellement à toute plateforme serverless avec facturation à l'usage : AWS Lambda, Vercel, Supabase, ou même des API tierces comme OpenAI et Twilio. Le principe reste identique : surveiller proactivement les quotas et dégrader gracieusement avant d'atteindre les plafonds budgétaires.

Adaptation aux pipelines CI/CD

Un commentateur sur Hacker News a souligné un problème similaire avec les pipelines CI : une boucle de retry défectueuse peut épuiser un budget mensuel GitHub Actions en quelques heures, sans mécanisme de protection intégré. L'approche du circuit breaker s'applique parfaitement à ce contexte.

Cette problématique rejoint les préoccupations croissantes autour des coûts dans l'écosystème IA, où les dépassements budgétaires peuvent rapidement compromettre la viabilité d'un projet.

Limites par worker : la prochaine évolution

Une amélioration suggérée consiste à implémenter des limites par worker en plus des seuils globaux. Cette granularité permettrait d'isoler les workers problématiques sans impacter l'ensemble de l'infrastructure. Un worker RSS gourmand pourrait être bridé sans affecter les workers de traitement LLM ou d'envoi d'emails.

Cette segmentation s'avère particulièrement pertinente pour les architectures IA complexes qui combinent plusieurs modèles et services avec des profils de consommation très différents.

Bonnes pratiques pour le polling RSS

Un développeur a recommandé de limiter la collecte RSS à un intervalle de 10 minutes maximum par source. Le créateur de 3mins.news a opté pour une heure, estimant que la plupart des flux ne se mettent pas à jour assez fréquemment pour justifier des requêtes plus rapprochées. Cette décision réduit significativement la consommation de ressources sans impacter l'expérience utilisateur.

Optimisation des cron triggers

Même lorsque le circuit breaker est déclenché, les cron triggers Cloudflare continuent de s'exécuter (impossible de les désactiver). La première action de chaque tâche planifiée consiste à vérifier l'état du breaker et à s'arrêter immédiatement si nécessaire. Cette approche minimise la consommation résiduelle tout en maintenant la réactivité du système.

Prévention versus détection : un changement de paradigme

L'approche du circuit breaker applicatif représente un changement fondamental dans la gestion des coûts cloud. Plutôt que de réagir après coup aux dépassements, elle prévient activement les dérives avant qu'elles ne deviennent problématiques.

Cette philosophie rejoint les préoccupations exprimées dans les débats sur la viabilité économique des infrastructures IA, où la maîtrise des coûts devient aussi critique que la performance technique.

Complexité versus protection

Un commentateur a soulevé une objection légitime : ajouter ce mécanisme introduit de l'état supplémentaire dans l'application, augmentant sa complexité et potentiellement ses modes de défaillance. C'est un compromis assumé : la complexité additionnelle est justifiée par la protection financière qu'elle apporte.

Les alternatives (ResourceQuotas Kubernetes, HorizontalPodAutoscaler) existent pour les déploiements auto-hébergés avec workerd, mais nécessitent une infrastructure beaucoup plus lourde. Le circuit breaker applicatif offre une solution légère adaptée aux environnements serverless managés.

Vers une standardisation des signaux de quota

La question de la standardisation se pose : comment intégrer ces signaux de quota dans les spécifications Containerfile, Kubernetes ou Helm ? Le Dockerfile supporte déjà HEALTHCHECK pour la surveillance de santé. Une instruction QUOTACMD pourrait spécifier une commande à exécuter lors de la réception d'un message de statut de quota.

Cette évolution permettrait aux orchestrateurs de traiter uniformément les contraintes budgétaires, qu'elles proviennent de Cloudflare, AWS, Azure ou Google Cloud. Les enjeux de souveraineté rendent cette portabilité encore plus stratégique.

Au-delà de Cloudflare : applications universelles

Le pattern s'applique à toute API avec plafonds budgétaires. Pour OpenAI, surveiller les tokens consommés et ralentir automatiquement les appels avant d'atteindre la limite mensuelle. Pour Twilio, monitorer les SMS envoyés et basculer vers un canal alternatif si nécessaire. Pour Stripe, suivre les appels API et différer les opérations non critiques.

Cette approche défensive devient indispensable dans un contexte où les services IA multiplient les mécanismes de contrôle et où les coûts peuvent exploser sans visibilité préalable.

Conclusion : l'autodéfense budgétaire comme standard

Le circuit breaker pour Cloudflare Workers illustre une tendance émergente : les applications doivent désormais intégrer leur propre protection budgétaire. Les plateformes cloud ne fourniront pas de filet de sécurité automatique, c'est aux développeurs d'implémenter ces garde-fous.

Cette responsabilisation s'inscrit dans un mouvement plus large de transparence et de contrôle exigé des services numériques. Les coûts cachés et les dépassements silencieux ne sont plus acceptables.

Pour les développeurs d'applications IA, cette approche offre la tranquillité d'esprit nécessaire pour expérimenter sans craindre la facture du lendemain. Elle transforme l'angoisse nocturne du "Denial of Wallet" auto-infligé en une surveillance sereine et automatisée.

Pour aller plus loin dans l'optimisation de vos workflows IA et la maîtrise de vos coûts d'infrastructure, créez votre compte gratuit sur Roboto et découvrez nos outils de génération de contenu avec contrôle budgétaire intégré.