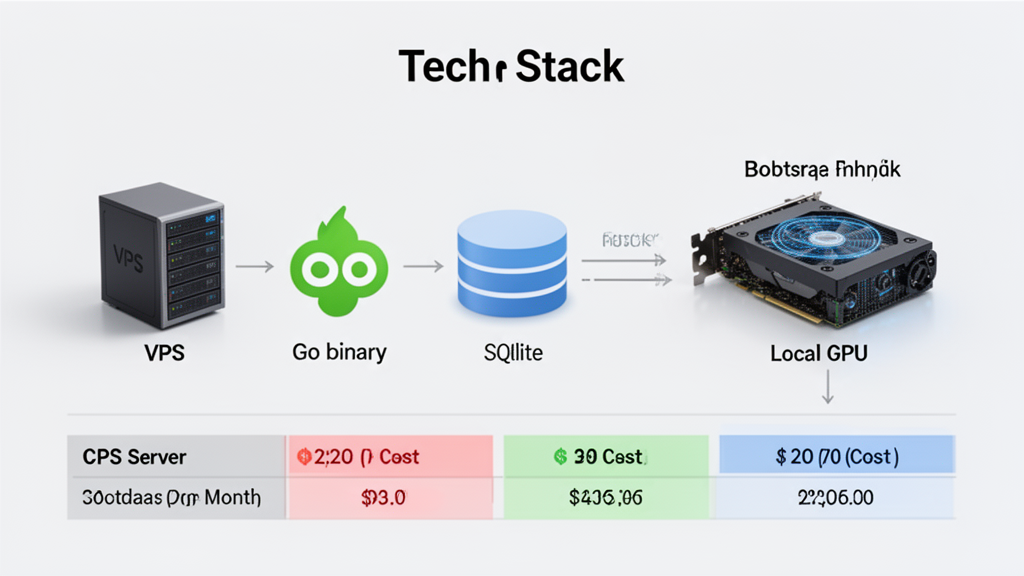

Les entrepreneurs français rêvent souvent de lever des fonds pour lancer leur startup. Pourtant, Steve Hanov démontre qu'il est possible de gérer plusieurs entreprises générant plus de 10 000 dollars de revenus récurrents mensuels avec une infrastructure technique coûtant à peine 20 dollars par mois. Cette approche minimaliste, loin des architectures cloud complexes et coûteuses, offre une alternative crédible pour les créateurs qui privilégient la rentabilité immédiate à la croissance financée par capital-risque.

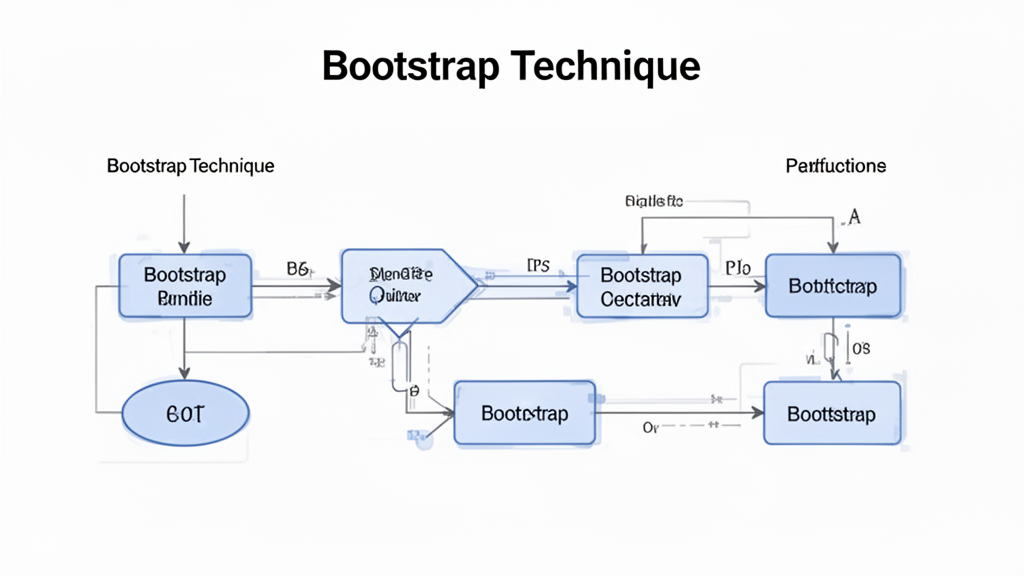

La philosophie du bootstrap technique en 2026

Contrairement aux startups qui brûlent des millions en infrastructure AWS avant même d'avoir trouvé leur premier client, l'approche lean consiste à maintenir des coûts quasi nuls. Cette stratégie procure exactement la même runway qu'un million de dollars levé avec un burn rate élevé, mais sans le stress ni la pression d'un conseil d'administration. En gardant une architecture simple, vous disposez du temps nécessaire pour identifier votre product-market fit.

Cette méthode s'oppose radicalement aux pratiques courantes de 2026, où l'infrastructure cloud devient de plus en plus sophistiquée. Pourtant, la simplicité reste souvent la clé du succès pour les entrepreneurs solo ou les petites équipes.

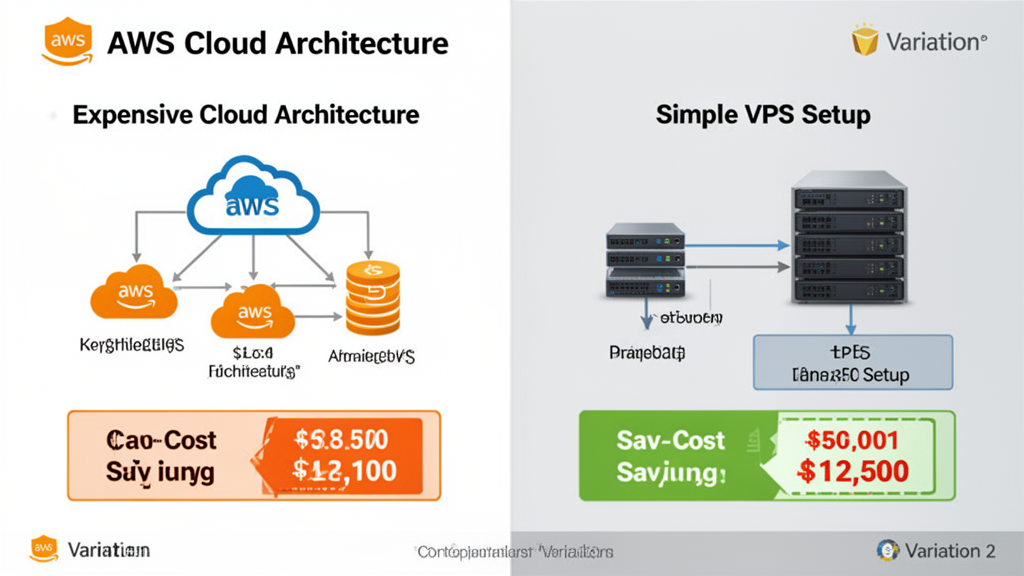

Choisir un serveur VPS plutôt qu'AWS

La première erreur des développeurs en 2026 consiste à démarrer avec AWS, provisionner un cluster EKS, configurer une instance RDS et un NAT Gateway, pour finalement dépenser 300 euros mensuels avant même qu'un utilisateur ne visite la page d'accueil. L'alternative intelligente ? Louer un simple serveur privé virtuel (VPS) chez Linode ou DigitalOcean pour 5 à 10 euros par mois.

Un gigaoctet de RAM peut sembler dérisoire aux développeurs web modernes, mais c'est largement suffisant si vous maîtrisez votre stack technique. Au besoin, un simple fichier swap apporte la marge de manœuvre nécessaire. L'objectif est de servir des requêtes, pas de maintenir une infrastructure complexe. Avec un seul serveur, vous savez exactement où trouver les logs, pourquoi le système a planté, et comment le redémarrer.

Les avantages concrets d'un serveur unique

- Logs centralisés et facilement accessibles

- Débogage simplifié sans naviguer entre services

- Redémarrage instantané sans orchestration complexe

- Coûts prévisibles et maîtrisés

- Pas de facturation surprise en fin de mois

Go : le langage idéal pour les contraintes de ressources

Avec seulement un gigaoctet de mémoire disponible, choisir Python ou Ruby comme backend principal serait une erreur stratégique. Ces langages consomment la moitié de la RAM rien que pour démarrer l'interpréteur et gérer les workers gunicorn. Go s'impose comme l'alternative évidente : infiniment plus performant pour les tâches web, strictement typé, et remarquablement facile à comprendre pour les modèles de langage en 2026.

La véritable magie de Go réside dans son processus de déploiement. Pas de dépendances pip install chaotiques, pas d'environnement virtuel à configurer. Vous compilez votre application entière en un seul binaire statiquement lié sur votre ordinateur portable, vous le transférez via scp vers votre serveur à 5 euros, et vous l'exécutez. Voici à quoi ressemble un serveur web complet et prêt pour la production en Go :

package main

import (

"fmt"

"net/http"

)

func main() {

http.HandleFunc("/", func(w http.ResponseWriter, r *http.Request) {

fmt.Fprintf(w, "Vos revenus récurrents sont en sécurité ici.")

})

http.ListenAndServe(":8080", nil)

}

Ce code minimaliste peut gérer des dizaines de milliers de requêtes par seconde sur une machine modeste. Pour optimiser encore davantage votre productivité, cette simplicité architecturale libère du temps pour se concentrer sur les fonctionnalités métier plutôt que sur la maintenance infrastructure.

IA locale : transformer une carte graphique en ressource illimitée

Si vous possédez une carte graphique chez vous, vous disposez déjà de crédits IA illimités. Lors du développement d'eh-trade.ca, le défi consistait à analyser qualitativement des milliers d'entreprises, en résumant d'énormes rapports trimestriels. La solution naïve aurait été d'utiliser l'API OpenAI, dépensant des centaines d'euros en crédits, avec le risque de devoir tout relancer en cas d'erreur logique dans la boucle de prompts.

L'alternative : faire tourner VLLM sur une carte graphique RTX 3090 avec 24 Go de VRAM achetée d'occasion pour 900 euros. Certes, c'est un investissement initial, mais vous ne payez plus jamais de péage à un fournisseur d'IA pour le traitement par lots. Cette approche rejoint la tendance des modèles IA optimisés pour l'edge computing.

Parcours d'évolution pour l'IA locale

| Étape | Outil | Usage | Avantages |

|---|---|---|---|

| 1. Démarrage | Ollama | Itération sur prompts | Installation en une commande, accès à des dizaines de modèles |

| 2. Production | VLLM | Requêtes concurrentes | PagedAttention, traitement par lots dans la mémoire GPU |

| 3. Avancé | Transformer Lab | Fine-tuning | Pré-entraînement et ajustement sur matériel local |

Pour gérer efficacement ces ressources, l'utilisation d'outils comme laconic permet de gérer le contexte LLM comme un gestionnaire de mémoire virtuelle d'un système d'exploitation. Il "page out" les éléments non pertinents d'une conversation, conservant uniquement les faits critiques dans la fenêtre de contexte active de 8K tokens.

OpenRouter : un hub unique pour tous les modèles frontières

Toutes les tâches ne peuvent pas s'exécuter localement. Parfois, vous avez besoin de la puissance de raisonnement de Claude 3.5 Sonnet ou GPT-4o pour des interactions chat à faible latence destinées aux utilisateurs. Plutôt que de jongler avec plusieurs comptes de facturation, clés API et limites de débit chez Anthropic, Google et OpenAI, OpenRouter centralise tout.

Vous écrivez une seule intégration compatible OpenAI dans votre code, et vous accédez instantanément à tous les principaux modèles frontières. Plus important encore, OpenRouter permet un routage de secours transparent. Si l'API d'Anthropic tombe en panne un mardi après-midi (ce qui arrive), votre application bascule automatiquement vers un modèle OpenAI équivalent. Vos utilisateurs ne voient jamais d'écran d'erreur, et vous n'avez pas besoin d'écrire une logique de retry complexe.

Cette stratégie multi-modèles devient essentielle en 2026, où la compétition entre modèles s'intensifie et où la disponibilité des API peut varier considérablement.

GitHub Copilot : l'arme secrète pour coder avec l'IA sans se ruiner

Chaque semaine, de nouveaux modèles extrêmement coûteux sont lancés. De nombreux développeurs dépensent des centaines d'euros mensuels en abonnements Cursor et crédits API Anthropic juste pour qu'une IA écrive leur code boilerplate. Pendant ce temps, l'utilisation intensive de Claude Opus 4.6 coûte à peine 60 euros par mois grâce à une stratégie simple : exploiter le modèle de tarification de Microsoft.

Un abonnement GitHub Copilot souscrit en 2023, branché sur VS Code standard, suffit amplement. Copilot a été testé contre Cursor et autres alternatives sophistiquées, mais il rattrape toujours son retard. Le secret ? Microsoft facture par requête, pas par token. Une "requête" correspond simplement à ce que vous tapez dans la boîte de chat. Même si l'agent passe ensuite 30 minutes à analyser l'intégralité de votre codebase, mapper les dépendances et modifier des centaines de fichiers, vous payez environ 0,04 euro.

La stratégie optimale consiste à rédiger des prompts extrêmement détaillés avec des critères de succès stricts (ce qui constitue de toute façon une bonne pratique), dire à l'agent de "continuer jusqu'à ce que toutes les erreurs soient corrigées", appuyer sur Entrée, et aller prendre un café pendant que Microsoft subventionne vos coûts de calcul. Cette approche s'inscrit dans les meilleures pratiques d'optimisation du travail en 2026.

SQLite : la base de données sous-estimée pour les applications web

Démarrer un nouveau projet avec sqlite3 comme base de données principale peut sembler fou, mais c'est une décision parfaitement rationnelle. La mentalité entreprise dicte qu'il faut une base de données serveur externe. Pourtant, un fichier SQLite local communiquant via l'interface C ou la mémoire est plusieurs ordres de grandeur plus rapide qu'un saut réseau TCP vers un serveur Postgres distant.

"Mais qu'en est-il de la concurrence ?" demandent les sceptiques. Beaucoup pensent que SQLite verrouille toute la base de données à chaque écriture. C'est faux. Il suffit d'activer le Write-Ahead Logging (WAL) en exécutant ces pragmas une fois lors de l'ouverture de la base :

PRAGMA journal_mode=WAL;

PRAGMA synchronous=NORMAL;

Résultat : les lecteurs ne bloquent plus les écrivains, et vice versa. Vous pouvez désormais gérer facilement des milliers d'utilisateurs simultanés depuis un seul fichier .db sur un disque NVMe. Pour simplifier l'authentification utilisateur, souvent la partie la plus ennuyeuse d'un nouveau projet SQLite, la bibliothèque smhanov/auth s'intègre directement à votre base de données et gère les inscriptions, sessions et réinitialisations de mot de passe. Elle permet même aux utilisateurs de se connecter via Google, Facebook, X ou leur propre fournisseur SAML d'entreprise.

Comparaison SQLite vs Postgres pour petites applications

| Critère | SQLite (WAL activé) | Postgres distant |

|---|---|---|

| Latence | Microseconde (interface C) | Milliseconde (réseau TCP) |

| Concurrence | Milliers d'utilisateurs simultanés | Milliers d'utilisateurs simultanés |

| Coût mensuel | 0€ (inclus dans VPS) | 10-50€ (instance dédiée) |

| Complexité déploiement | Copie d'un fichier | Configuration serveur, sauvegardes |

| Sauvegardes | Copie de fichier | pg_dump ou solutions tierces |

L'écosystème d'outils complémentaires

Au-delà des choix d'infrastructure de base, plusieurs outils spécialisés complètent cette stack technique minimaliste. Pour la gestion avancée du contexte IA, laconic fonctionne comme un chercheur agentique optimisé pour une fenêtre de contexte contrainte de 8K. Il gère le contexte LLM exactement comme un gestionnaire de mémoire virtuelle d'un système d'exploitation.

L'outil llmhub abstrait n'importe quel LLM en une simple combinaison fournisseur/endpoint/apikey, gérant élégamment les entrées/sorties texte et image, que le modèle s'exécute sous votre bureau ou dans le cloud. Cette approche modulaire facilite les tests et le basculement entre différents fournisseurs sans réécrire le code.

Ces pratiques s'inscrivent dans une tendance plus large où l'automatisation intelligente transforme les workflows des développeurs, tout en maintenant un contrôle total sur les coûts et la qualité.

Les limites et compromis de l'approche minimaliste

Cette stratégie ultra-lean présente évidemment des limites. Elle convient parfaitement pour des applications B2B avec quelques milliers d'utilisateurs actifs, mais atteint ses limites face à des charges massives nécessitant une mise à l'échelle horizontale. Cependant, la plupart des entrepreneurs n'atteindront jamais ce stade avant d'avoir validé leur marché et généré suffisamment de revenus pour justifier une migration.

Le véritable avantage réside dans la vitesse d'itération. Sans infrastructure complexe à maintenir, vous pouvez tester des hypothèses produit rapidement, pivoter sans coûts de migration prohibitifs, et vous concentrer sur ce qui compte vraiment : résoudre les problèmes de vos utilisateurs. Cette philosophie rejoint celle des systèmes décentralisés efficaces qui privilégient la simplicité.

Quand envisager une migration vers une architecture plus complexe

- Dépassement régulier de 10 000 utilisateurs simultanés

- Besoin de réplication géographique pour la latence

- Exigences de conformité nécessitant une infrastructure certifiée

- Équipe technique croissante nécessitant une séparation des services

- Revenus suffisants pour justifier des coûts infrastructure de 1000€+/mois

Perspectives pour les entrepreneurs français en 2026

L'industrie technologique française subit une pression croissante pour adopter les standards américains de levée de fonds et de burn rate élevé. Pourtant, cette approche bootstrap démontre qu'une alternative viable existe. En 2026, avec l'innovation française en IA qui progresse, les entrepreneurs disposent de plus d'outils que jamais pour construire des entreprises rentables sans dilution.

Les outils open source, les modèles IA locaux et les VPS abordables créent un environnement idéal pour le bootstrap. Cette approche permet de conserver le contrôle total de votre entreprise, de prendre des décisions stratégiques sans pression externe, et de construire une activité durable plutôt qu'une licorne hypothétique.

L'émergence de nouveaux paradigmes de recherche IA et d'outils comme PowerPresent pour automatiser les présentations montre que l'innovation ne nécessite pas forcément des budgets pharaoniques. La créativité et l'optimisation technique peuvent compenser largement des ressources financières limitées.

Conclusion : la frugalité comme avantage stratégique

L'industrie technologique cherche à vous convaincre que bâtir une vraie entreprise nécessite une orchestration complexe, des factures AWS massives et des millions en capital-risque. C'est faux. En utilisant un simple VPS, des binaires compilés statiquement, du matériel GPU local pour les tâches IA par lots, et la vitesse brute de SQLite, vous pouvez bootstrapper une startup hautement scalable pour moins que le prix de quelques cafés mensuels.

Cette approche vous offre une runway infinie, vous donnant le temps de réellement résoudre les problèmes de vos utilisateurs au lieu de stresser sur votre burn rate. Vous gardez le contrôle de votre architecture, comprenez chaque composant de votre stack, et pouvez déboguer efficacement sans naviguer dans une jungle de microservices.

Les entrepreneurs qui réussissent en 2026 ne seront pas nécessairement ceux qui lèvent le plus d'argent, mais ceux qui construisent des produits que les gens veulent vraiment, avec une efficacité opérationnelle maximale. La frugalité technique n'est pas une contrainte, c'est un avantage stratégique qui force la créativité et garantit la viabilité à long terme.

Pour aller plus loin dans l'optimisation de votre stack technique et découvrir comment l'IA peut transformer votre productivité sans exploser votre budget, créez votre compte gratuit sur Roboto et explorez nos outils de génération de contenu optimisés pour les entrepreneurs.