Lorsque le développeur d'un outil d'agrégation de feedback communautaire a consulté ses premiers coûts d'utilisation de l'API Claude, le chiffre affiché était brutal : 2,30 dollars pour quelques heures. Une projection simple révélait 70 dollars par mois, soit 840 dollars annuels pour une seule instance. Pour un développeur indépendant sans financement, ces chiffres transformaient un projet prometteur en gouffre financier.

Cette expérience illustre une réalité que beaucoup de développeurs découvrent : les API d'IA peuvent rapidement devenir prohibitives sans optimisation rigoureuse. Pourtant, avec les bonnes stratégies, il est possible de diviser ces coûts par plus de cent tout en maintenant la qualité des résultats. Cet article détaille les techniques concrètes qui ont permis cette transformation.

Le diagnostic initial : identifier les sources de surcoûts

L'analyse approfondie des dépenses a révélé plusieurs problèmes structurels. Le premier concernait la fréquence des appels API : des requêtes horaires multipliaient inutilement les coûts. Le second touchait au volume de données envoyées : messages sans valeur, extraits de code volumineux, et sorties détaillées gonflaient artificiellement chaque transaction.

Un bug spécifique coûtait à lui seul un dollar quotidien, mais au-delà de cette erreur technique, c'était l'architecture même du système qui nécessitait une refonte. Comme l'expliquent les analyses sur l'optimisation des systèmes IA, la qualité des entrées détermine directement l'efficacité économique.

Stratégie 1 : choisir le modèle adapté à chaque tâche

La première décision radicale fut d'abandonner Claude Sonnet au profit de Claude Haiku. Les tests comparatifs sur données réelles ont démontré que Haiku offrait des performances équivalentes voire supérieures pour cette application spécifique, tout en coûtant trois fois moins cher.

Cette découverte rejoint les conclusions du classement des modèles IA performants : le modèle le plus puissant n'est pas toujours le plus adapté. Pour des tâches de classification et d'extraction d'informations structurées, les modèles compacts excellent.

Tableau comparatif des modèles pour tâches de classification

| Modèle | Coût par million tokens | Qualité classification | Cas d'usage optimal |

|---|---|---|---|

| Claude Sonnet | 3,00 $ | Excellent | Analyse complexe, raisonnement |

| Claude Haiku | 1,00 $ | Excellent | Classification, extraction |

| Gemini 2.5 Flash-Lite | 0,10 $ | Très bon | Volume élevé, simplicité |

| Grok 4.1 Fast | 0,20 $ | Très bon | Équilibre coût/performance |

Stratégie 2 : implémenter le traitement par lots

Le passage d'appels horaires à un traitement nocturne en batch a constitué le deuxième levier majeur d'économies. L'API Batch d'Anthropic propose des tarifs réduits de 50% pour les traitements différés, une option idéale pour l'agrégation de feedback qui ne nécessite pas de réponses instantanées.

Cette approche présente plusieurs avantages :

- Réduction immédiate des coûts de moitié via les tarifs batch

- Optimisation du regroupement des requêtes similaires

- Lissage de la charge sur l'infrastructure

- Possibilité d'implémenter des vérifications qualité sans surcoût

Pour les développeurs cherchant à exécuter des modèles localement, cette stratégie devient encore plus pertinente : le traitement nocturne permet d'utiliser pleinement les ressources matérielles disponibles.

Stratégie 3 : filtrer intelligemment avant l'IA

L'erreur coûteuse consistait à envoyer chaque message à l'API pour déterminer s'il contenait du feedback pertinent. Messages courts comme "lol" ou "thanks", spam évident, messages de bots : tout passait par Claude pour analyse.

La solution : implémenter une couche de filtrage par expressions régulières avant l'appel API. Cette approche simple élimine :

- Les messages de moins de 10 caractères sans mots-clés pertinents

- Les remerciements génériques et réactions émotionnelles

- Les messages automatiques identifiables par pattern

- Les doublons exacts déjà traités

Toutefois, le système conserve les messages courts exprimant un accord ("+1", "me too", "pareil") car ils indiquent la popularité d'un point de feedback. Cette nuance, similaire aux stratégies de débogage intelligent, évite de perdre des signaux faibles importants.

Stratégie 4 : optimiser les formats d'entrée et sortie

Deux optimisations techniques ont considérablement réduit la taille des échanges avec l'API :

Suppression des extraits de code

Les snippets de code dans les messages GitHub représentaient souvent 80% du volume sans apporter de valeur pour la classification. Le système extrait désormais ces blocs avant l'envoi, ne conservant que le texte descriptif. Le code est réinjecté après traitement si nécessaire pour le contexte.

Formats de sortie compacts

Au lieu de demander des réponses détaillées ("High priority", "Medium priority", "Low priority"), le système utilise des codes courts ("H", "M", "L"). Les titres de recommandation sont limités à 40 caractères. Ces ajustements réduisent les tokens de sortie de 60% sans perte d'information.

Cette approche d'optimisation rappelle les principes utilisés dans la génération de contenu efficace : la concision structurée surpasse souvent la verbosité.

Alternatives et compléments : modèles locaux et autres fournisseurs

Plusieurs développeurs de la communauté Hacker News ont suggéré des alternatives complémentaires pour réduire encore les coûts :

Exécution locale de modèles

Pour les traitements par lots ne nécessitant pas de réponses immédiates, les modèles locaux deviennent viables. Des configurations avec 32 Go de RAM et GPU AMD 6700XT permettent d'exécuter des modèles comme GPT-OSS-120B ou Qwen 3 8B. Les modèles MoE (Mixture of Experts) offrent un excellent compromis efficacité/performance.

Avantages des modèles locaux :

- Coût marginal nul après investissement matériel

- Confidentialité totale des données

- Absence de limites de débit

- Contrôle complet sur les paramètres

L'intégration de solutions matérielles optimisées peut transformer cette approche en option économiquement viable pour les projets à volume croissant.

Fournisseurs alternatifs

Des plateformes comme z.ai, Minimax avec M2.1, ou les modèles chinois (GLM, Deepseek, Qwen) proposent des tarifs significativement inférieurs. Gemini 2.5 Flash-Lite à 0,10 $ par million de tokens représente un dixième du coût de Claude Haiku pour des tâches simples.

Mise en œuvre d'une architecture optimisée

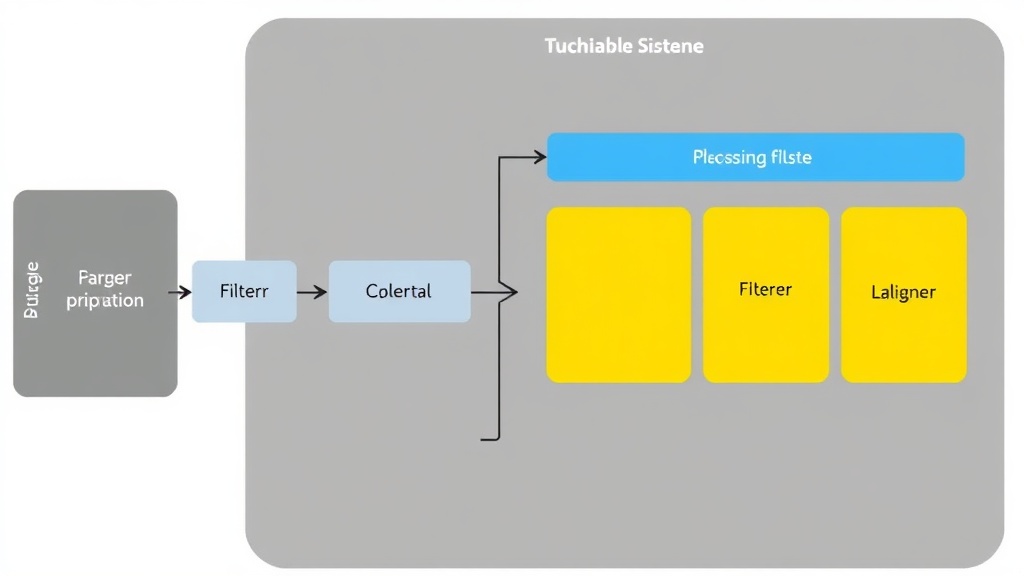

L'architecture finale repose sur un pipeline en plusieurs étapes :

- Collecte : Les sources (Discord, GitHub, forums) alimentent une file d'attente tout au long de la journée

- Filtrage préliminaire : Expressions régulières éliminent le bruit évident

- Prétraitement : Extraction des blocs de code, normalisation des formats

- Traitement batch nocturne : Envoi groupé via l'API Batch d'Anthropic

- Clustering : Regroupement des feedbacks similaires

- Contrôle qualité intermittent : Vérification périodique sur échantillon

Cette architecture modulaire, inspirée des systèmes de génération de contenu modernes, permet d'ajuster chaque composant indépendamment selon l'évolution des besoins et des coûts.

Résultats et enseignements pour les développeurs indépendants

La combinaison de ces optimisations a réduit les coûts quotidiens de 2,30 $ à quelques centimes, soit une division par plus de 100. Cette marge économique a permis :

- Le triplement des limites des paliers tarifaires proposés aux utilisateurs

- L'ajout de contrôles qualité réguliers sans impact budgétaire

- Une viabilité économique dès le premier jour pour un développeur sans financement

Principes clés pour optimiser vos coûts d'API IA

| Principe | Impact économique | Difficulté mise en œuvre |

|---|---|---|

| Choisir le modèle adapté | Réduction 50-70% | Faible (tests comparatifs) |

| Traitement par lots | Réduction 50% | Moyenne (refonte architecture) |

| Filtrage pré-IA | Réduction 30-60% | Faible (regex simples) |

| Optimisation formats | Réduction 20-40% | Faible (ajustements prompts) |

| Modèles locaux | Réduction 90-100% | Élevée (infrastructure) |

Pour les entrepreneurs et développeurs construisant des applications IA sans l'appui du capital-risque traditionnel, ces optimisations ne sont pas optionnelles : elles déterminent la viabilité même du projet.

Techniques avancées pour aller plus loin

Au-delà des optimisations de base, plusieurs techniques avancées méritent exploration :

Cache de prompts

L'API Anthropic propose des attributs de contrôle de cache qui ne sont pas activés automatiquement. Pour les prompts système réutilisés fréquemment, le caching peut réduire les coûts de 90% sur la partie système du prompt. Cette fonctionnalité reste sous-exploitée par manque de documentation.

Classification hiérarchique

Utiliser un modèle ultra-léger (comme Gemma 3 1B) pour la première classification, puis ne solliciter un modèle plus puissant que pour les cas ambigus. Cette approche en cascade optimise le rapport qualité/coût global.

Outils spécialisés

Pour les tâches de clustering de feedback, des bibliothèques comme BERTopic offrent des alternatives sans LLM pour certaines étapes du pipeline. Ces outils, combinés judicieusement avec des appels API ciblés, créent des systèmes hybrides performants.

L'intégration de bonnes pratiques de développement web garantit également que l'application cliente n'envoie que les données strictement nécessaires.

Perspective : l'évolution du marché des API IA

Le marché des API d'IA connaît une pression concurrentielle croissante. Les modèles open-source atteignent des performances comparables aux solutions propriétaires, forçant les fournisseurs à réduire leurs tarifs. Gemini 2.5 Flash-Lite à 0,10 $ par million de tokens illustre cette tendance.

Parallèlement, les capacités matérielles grand public progressent. Une configuration à 1500-2000 € permet désormais d'exécuter localement des modèles qui auraient nécessité des serveurs cloud il y a deux ans. Cette démocratisation, comparable à celle observée avec l'évolution historique du computing, redéfinit l'économie des applications IA.

Les développeurs avisés construisent dès aujourd'hui des architectures flexibles, capables de basculer entre API cloud et exécution locale selon les volumes et les contraintes budgétaires. Cette agilité devient un avantage compétitif décisif.

Conclusion : repenser l'économie de l'IA dès la conception

L'expérience de ce développeur indépendant démontre qu'une réduction de coûts de 100x reste possible sans compromettre la qualité. Les clés du succès résident dans le choix du modèle adapté, l'architecture par lots, le filtrage intelligent et l'optimisation des formats.

Pour les entrepreneurs bootstrappés, ces optimisations ne constituent pas de simples améliorations techniques : elles déterminent la viabilité économique du projet. Alors que les solutions propriétaires offrent une facilité d'implémentation initiale, une architecture réfléchie transforme les coûts d'exploitation d'obstacle insurmontable en avantage concurrentiel.

L'avenir appartient aux développeurs capables d'orchestrer intelligemment modèles cloud, solutions locales et filtrage traditionnel. Cette maîtrise technique, combinée à une compréhension fine des cas d'usage, permet de construire des applications IA économiquement soutenables dès le premier jour.

Pour aller plus loin dans l'optimisation de vos projets IA et découvrir des outils de génération de contenu performants, créez votre compte gratuit sur Roboto et explorez nos solutions adaptées aux besoins des développeurs indépendants.