En février 2026, Anthropic et OpenAI ont simultanément dévoilé leurs modes "rapides" pour accélérer l'inférence de leurs meilleurs modèles de codage. Pourtant, derrière cette apparente convergence se cachent deux approches radicalement différentes : l'une privilégie la fidélité au modèle original, l'autre mise sur une vitesse spectaculaire au prix de compromis techniques. Ces stratégies révèlent des visions opposées de l'avenir de l'IA générative et posent une question cruciale : faut-il privilégier la performance brute ou la qualité des résultats ?

Deux approches diamétralement opposées de l'accélération

Les chiffres parlent d'eux-mêmes. Le mode rapide d'Anthropic atteint environ 170 tokens par seconde, soit 2,5 fois plus que les 65 tokens/s d'Opus 4.6 en mode standard. OpenAI, de son côté, franchit la barre des 1000 tokens par seconde avec GPT-5.3-Codex-Spark, contre 65 tokens/s pour GPT-5.3-Codex classique. Cela représente une multiplication par 15 de la vitesse, rendant le système d'OpenAI six fois plus rapide que celui d'Anthropic.

Mais cette différence de performance masque une distinction fondamentale. Anthropic propose son modèle Opus 4.6 authentique en mode rapide, garantissant ainsi la même qualité de sortie qu'en mode standard. OpenAI, en revanche, déploie GPT-5.3-Codex-Spark, une version allégée qui, bien que nettement plus véloce, présente des lacunes notables. Les modèles de codage IA comme Spark peuvent se montrer confus lors des appels d'outils, une faiblesse que GPT-5.3-Codex standard ne présente jamais.

La technique du batching réduit chez Anthropic

Bien que les laboratoires d'IA restent discrets sur leurs méthodes, l'analyse des performances suggère fortement qu'Anthropic s'appuie sur une inférence à taille de batch réduite. Cette approche exploite une contrainte fondamentale de l'économie de l'inférence IA : le compromis entre débit et latence.

Le goulot d'étranglement de la mémoire GPU

Les GPU sont extrêmement rapides pour les calculs, mais le transfert de données vers ces processeurs reste lent. Chaque opération d'inférence nécessite de copier l'intégralité des tokens du prompt utilisateur sur le GPU avant de commencer les calculs. Le batching consiste à regrouper plusieurs utilisateurs pour maximiser le débit global, mais au prix d'un temps d'attente pour constituer le batch complet.

L'analogie du système de bus illustre parfaitement ce principe. Sans batching, chaque passager monterait dans un bus qui démarrerait immédiatement, réduisant drastiquement les temps de trajet individuels. Mais le débit global s'effondrerait, car les passagers attendraient des heures avant qu'un bus ne se présente.

Un pass prioritaire six fois plus cher

Le mode rapide d'Anthropic équivaut à un pass garantissant le départ immédiat du bus dès votre montée. Le tarif est multiplié par six, car vous payez essentiellement pour toutes les places qui auraient pu être occupées par d'autres passagers. En contrepartie, vous éliminez totalement le temps d'attente avant le départ.

Cette stratégie s'inscrit dans l'économie actuelle de l'IA, où les coûts d'infrastructure restent élevés. Le rapport "six fois plus cher pour 2,5 fois plus rapide" correspond exactement aux gains attendus d'un passage à un régime de batch de petite taille, renforçant la crédibilité de cette hypothèse.

Les puces géantes Cerebras derrière OpenAI

L'approche d'OpenAI diffère radicalement. L'introduction d'un nouveau modèle spécifiquement pour le mode rapide constitue un indice majeur : si seule la taille des batchs était modifiée, aucune raison ne justifierait de créer un modèle distinct. De plus, OpenAI a explicitement révélé dans son annonce que Cerebras alimente ce mode rapide.

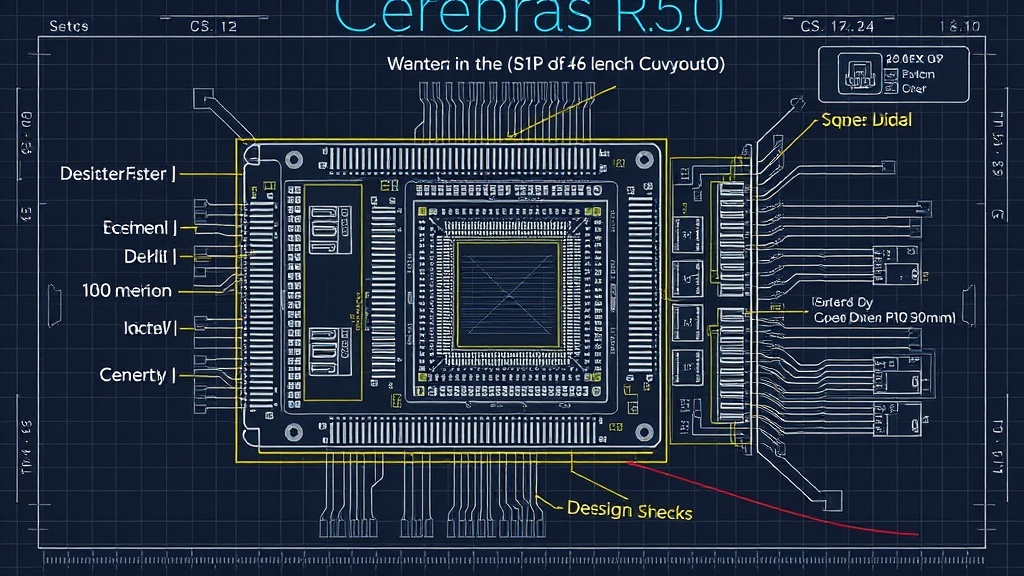

Des puces de 70 pouces carrés

Cerebras construit des "puces de calcul à ultra-faible latence", ce qui se traduit concrètement par des composants gigantesques. Une puce H100, proche de la frontière technologique pour l'inférence, mesure un peu plus d'un pouce carré. Une puce Cerebras s'étend sur 70 pouces carrés.

Les images de ces puces révèlent un motif de grille avec des trous caractéristique. Normalement, les wafers de silicium de cette taille sont découpés en dizaines de puces individuelles. Cerebras grave au contraire une puce géante unique sur toute la surface du wafer.

La mémoire SRAM comme avantage décisif

Plus la puce est grande, plus elle peut intégrer de mémoire interne. L'objectif consiste à disposer d'une SRAM suffisamment volumineuse pour contenir l'intégralité du modèle, permettant ainsi une inférence entièrement en mémoire. La SRAM des GPU classiques se mesure en dizaines de mégaoctets, ce qui implique de passer beaucoup de temps à transférer des portions des poids du modèle depuis l'extérieur de la SRAM vers les unités de calcul du GPU.

Si l'ensemble de ces données pouvait être streamé depuis la SRAM (bien plus rapide), l'inférence gagnerait considérablement en vitesse : quinze fois plus rapide, comme le démontrent les résultats. La dernière puce Cerebras embarque 44 Go de mémoire interne, suffisants pour accueillir un modèle de taille modeste (environ 20 milliards de paramètres en fp16, ou 40 milliards en quantification int8).

Un compromis qui explique GPT-5.3-Codex-Spark

Cette limitation place OpenAI dans une position délicate. Si 44 Go suffisent pour un petit modèle, ils ne peuvent évidemment pas contenir GPT-5.3-Codex dans son intégralité. D'où l'introduction de Spark, un nouveau modèle qui présente certaines caractéristiques typiques des modèles de petite taille : il s'agit d'une distillation plus compacte du bien plus volumineux GPT-5.3-Codex.

Cette approche rappelle les stratégies d'optimisation que d'autres acteurs majeurs déploient pour équilibrer performance et capacités.

Comparaison des performances et cas d'usage

| Critère | Anthropic (Opus 4.6) | OpenAI (Spark) |

|---|---|---|

| Vitesse | 170 tokens/s (×2,5) | 1000+ tokens/s (×15) |

| Qualité du modèle | Identique au modèle standard | Version distillée moins capable |

| Coût | ×6 du tarif standard | Non communiqué |

| Technologie | Batching réduit | Puces Cerebras (44 Go SRAM) |

| Fiabilité | Excellente (modèle complet) | Erreurs occasionnelles sur appels d'outils |

Une course à l'annonce stratégique

La chronologie des annonces suggère une dimension stratégique intéressante. OpenAI a formé son partenariat avec Cerebras mi-janvier 2026, manifestement pour déployer un modèle OpenAI sur une puce Cerebras rapide. Anthropic, sans solution équivalente disponible, savait qu'OpenAI annoncerait une inférence ultra-rapide en février.

Anthropic a donc rapidement assemblé le type d'inférence rapide qu'elle pouvait fournir : simplement réduire la taille des batchs sur son infrastructure d'inférence existante. L'entreprise a probablement attendu quelques jours avant qu'OpenAI ne finalise sa bien plus complexe implémentation Cerebras pour l'annoncer, créant l'impression qu'OpenAI l'avait copiée.

L'exploit technique d'OpenAI reste objectivement plus impressionnant. Faire fonctionner un modèle sur des puces Cerebras n'a rien de trivial, tant ces composants sont atypiques. Entraîner une distillation de 20 ou 40 milliards de paramètres de GPT-5.3-Codex qui reste suffisamment performante représente également un défi considérable. Mais la manœuvre d'Anthropic pour devancer l'annonce d'une façon largement opaque pour les non-spécialistes mérite d'être saluée.

Cette dynamique concurrentielle s'inscrit dans le contexte plus large de la course à l'IA en 2026, où chaque avancée technique devient un enjeu de communication majeur.

L'inférence rapide est-elle vraiment prioritaire ?

Voir les deux laboratoires majeurs lancer cette fonctionnalité pourrait laisser penser que l'inférence rapide constitue leur nouvel objectif principal. Pourtant, plusieurs éléments contredisent cette hypothèse.

Des motivations différentes selon les acteurs

Si l'analyse précédente est correcte, Anthropic ne se soucie pas particulièrement de l'inférence rapide : l'entreprise voulait simplement éviter de paraître en retard sur OpenAI. De son côté, OpenAI explore principalement les capacités de son nouveau partenariat Cerebras. Il reste largement incertain quels types de modèles peuvent tenir sur ces puces géantes, quelle sera leur utilité réelle, et si l'économie globale sera viable.

Vitesse versus précision : un mauvais compromis

L'expérience pratique révèle des limites importantes. L'utilité des agents IA dépend avant tout du nombre d'erreurs qu'ils commettent, non de leur vitesse brute. Acheter six fois plus de rapidité au prix de 20% d'erreurs supplémentaires constitue un mauvais marché, car l'utilisateur passe la majorité de son temps à corriger les erreurs plutôt qu'à attendre le modèle.

Cette observation rejoint les réflexions sur l'optimisation des assistants IA, où la fiabilité prime sur la vélocité pour les tâches complexes.

Un primitif pour des systèmes plus complexes

Néanmoins, l'inférence rapide mais moins capable pourrait devenir un élément fondamental de niveau inférieur dans les systèmes d'IA. Claude Code utilise déjà Haiku pour certaines opérations. OpenAI pourrait employer Spark de manière similaire, réservant les modèles lourds aux tâches critiques et déléguant les opérations simples aux versions rapides.

Cette architecture hybride rappelle les approches multicouches que certains acteurs développent pour optimiser l'expérience utilisateur sans compromettre la qualité.

Implications pour les développeurs et entreprises

Ces deux approches de l'inférence rapide créent des opportunités distinctes pour différents cas d'usage professionnels.

Quand privilégier le mode rapide d'Anthropic

- Applications critiques nécessitant une fiabilité maximale

- Génération de code complexe où les erreurs coûtent cher

- Tâches de raisonnement avancé ne tolérant aucun compromis

- Workflows où la qualité prime absolument sur le temps de réponse

Quand exploiter le mode rapide d'OpenAI

- Prototypage rapide et itérations exploratoires

- Génération de contenu à volume élevé avec validation humaine

- Assistants conversationnels où la réactivité améliore l'expérience

- Tâches simples et répétitives nécessitant peu de raisonnement complexe

Pour les développeurs travaillant avec des frameworks modernes, l'intégration de ces modes rapides peut considérablement optimiser les pipelines de développement, à condition de bien comprendre leurs limites respectives.

Perspectives techniques et économiques

La complexité de ces systèmes rend difficile l'élaboration d'un modèle mental simple et précis. Plusieurs facteurs entrent en jeu simultanément.

Les subtilités du batching continu

Anthropic avertit explicitement que le temps jusqu'au premier token peut rester lent, voire s'allonger. OpenAI, au contraire, considère la latence de Spark suffisamment faible pour justifier le passage à une websocket persistante, estimant que les 50-200 ms d'aller-retour pour la poignée de main représentent une portion significative du temps jusqu'au premier token.

Ces différences de latence impactent directement l'expérience utilisateur et doivent être prises en compte dans la conception d'applications. Les techniques d'optimisation web deviennent cruciales pour tirer parti de ces nouvelles capacités.

L'équation économique reste incertaine

Les coûts d'infrastructure pour ces modes rapides demeurent élevés. Le facteur multiplicateur de six chez Anthropic reflète les réalités économiques du batching réduit. Chez OpenAI, l'investissement dans les puces Cerebras et le développement de modèles distillés représentent des coûts substantiels dont la rentabilité à long terme reste à prouver.

Cette incertitude économique s'inscrit dans les questionnements plus larges sur la viabilité économique de l'IA générative à grande échelle.

Enjeux de transparence et de détection

L'introduction de modèles distillés comme Spark soulève des questions de transparence. Les utilisateurs reçoivent-ils toujours le modèle qu'ils attendent ? Comment distinguer les sorties d'un modèle complet de celles d'une version allégée ?

Ces interrogations rejoignent les problématiques de détection qui préoccupent de plus en plus les professionnels utilisant l'IA dans leurs workflows. La traçabilité et l'authenticité des sorties deviennent des enjeux majeurs à mesure que les modèles se diversifient.

Pour les créateurs de contenu visuel, les outils de génération d'images posent des défis similaires en termes de qualité et de cohérence entre différentes versions de modèles.

L'inférence rapide en IA représente moins une nouvelle priorité stratégique qu'une exploration de possibilités techniques distinctes. Anthropic et OpenAI ont choisi des chemins radicalement différents, reflétant leurs philosophies respectives : fidélité au modèle original contre vitesse maximale. L'avenir dira laquelle de ces approches s'imposera, ou si une synthèse des deux émergera pour répondre aux besoins variés des utilisateurs professionnels.