En mars 2026, le projet OldNYC franchit une étape majeure : 10 000 photographies historiques supplémentaires géolocalisées avec précision grâce à l'intelligence artificielle. Cette prouesse technique illustre comment les modèles de langage transforment la préservation du patrimoine numérique, en permettant de cartographier des lieux disparus depuis près d'un siècle.

Le créateur du projet, Dan Vanderkam, a reconstruit l'infrastructure complète du site entre 2024 et 2026. Résultat : OldNYC affiche désormais 49 000 images contre 39 000 en 2016, avec un taux de précision géographique de 96%. Cette évolution repose sur trois innovations majeures qui redéfinissent le traitement automatisé des archives photographiques.

La Géolocalisation Intelligente par GPT-4o

Le défi principal d'OldNYC consiste à transformer des descriptions textuelles anciennes en coordonnées GPS exploitables. Une phrase comme "Broad Street, au sud de Wall Street" doit devenir une latitude et une longitude précises. Problème : de nombreuses intersections mentionnées dans les archives n'existent plus aujourd'hui.

L'intégration de GPT-4o pour l'extraction de données a permis de géolocaliser 6 000 photographies supplémentaires. Le modèle analyse les descriptions complètes des images, pas seulement leurs titres, pour identifier les informations spatiales pertinentes.

Exemple Concret d'Extraction Contextuelle

Prenons cette description d'archive : "Public Schools - Brooklyn - P.S. 143. 1930 Havemeyer Street, côté ouest, de North 6th à North 7th Streets, montrant l'école publique n°143. Vue vers le nord depuis North 6th Street."

GPT-4o extrait automatiquement trois éléments géographiques :

- Havemeyer St & North 6th St

- Havemeyer St & North 7th St

- Public School No. 143

Cette capacité d'interprétation contextuelle représente un bond qualitatif par rapport aux systèmes traditionnels de traitement du langage. Le modèle comprend que "North 6th" signifie "North 6th Street" et ignore les mentions directionnelles comme "côté ouest" qui ne constituent pas des adresses précises.

OpenStreetMap et les Données Historiques

Vanderkam a également remplacé l'API de géocodage Google Maps par OpenStreetMap, combiné aux jeux de données historiques de la bibliothèque publique de New York. Cette approche résout les cas où des rues se sont déplacées ou ont disparu.

Exemple révélateur : l'intersection "Fulton Street – Nassau Street" existait à Brooklyn dans les années 1930, mais a été supprimée depuis. Google Maps géocode cette adresse à Manhattan, où ces noms de rues se croisent encore. Grâce aux données historiques, OldNYC positionne désormais correctement la photo à son emplacement d'origine à Brooklyn.

| Méthode | Photos géolocalisées | Précision |

|---|---|---|

| Système original (2016) | 39 000 | ~80% |

| Avec GPT-4o + OSM (2026) | 49 000 | 96% |

OCR Nouvelle Génération avec GPT-4o-mini

Les photographies d'OldNYC incluent des descriptions provenant du catalogue de la bibliothèque, mais celles-ci existent uniquement sous forme d'images numérisées de documents dactylographiés. En 2015, convertir ces images en texte exploitable constituait le principal obstacle technique du projet.

Vanderkam avait développé un pipeline personnalisé utilisant Ocropus, atteignant 99% de précision au niveau des caractères. Malgré ce score élevé, les erreurs restaient visibles à la lecture. Pour y remédier, il avait ajouté une fonctionnalité "Corriger les fautes" permettant aux utilisateurs de soumettre des corrections manuelles.

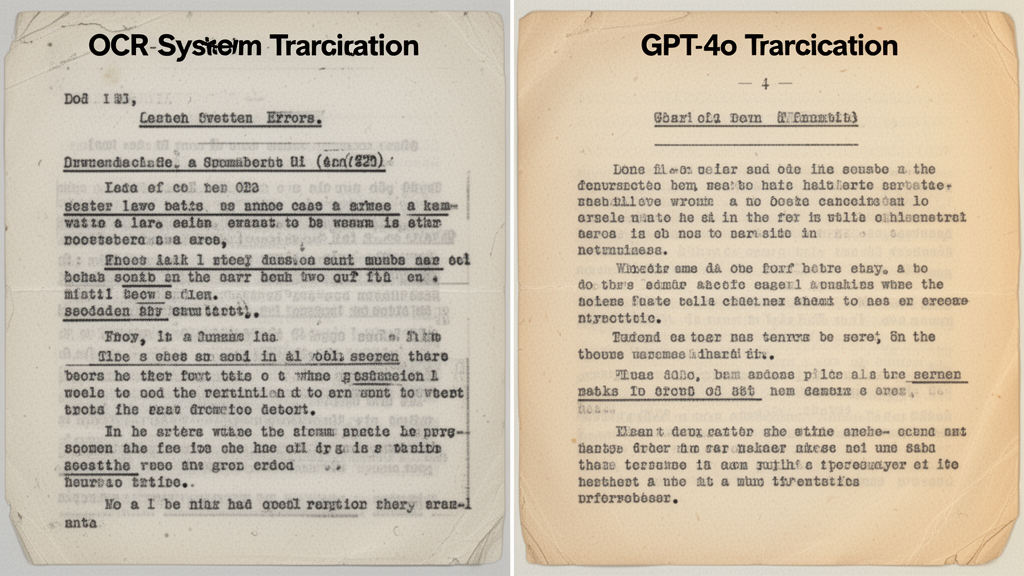

Comparaison des Performances OCR

La reconstruction du système OCR en 2024 avec GPT-4o-mini a produit des résultats spectaculaires :

- Couverture textuelle étendue de 25 000 à 32 000 images

- GPT-4o-mini surpasse l'ancien système dans 75% des cas

- Résultats clairement inférieurs dans seulement 2% des situations

Un exemple frappant montre l'ancien système OCR produisant du charabia complet face à une police de caractères inhabituelle, tandis que GPT transcrit le texte parfaitement. Cette amélioration s'explique par la capacité des modèles de langage à comprendre le contexte, pas seulement à reconnaître des formes.

Leçons Techniques du Pipeline OCR

Trois enseignements clés émergent de cette reconstruction :

- Résolution source : GPT-4o-mini fonctionne mieux avec des images haute résolution, pas les versions basse résolution disponibles sur le site de la bibliothèque

- Détection de texte : Le code de détection écrit en 2015 reste utile pour recadrer les images avant l'OCR

- Hallucinations : Fournir le titre de l'image comme contexte pousse GPT à inventer du texte inexistant. Les meilleurs résultats proviennent de l'image seule

Ces observations confirment que l'OCR est devenu un problème beaucoup plus simple en 2024 qu'en 2015, grâce aux avancées des modèles OpenAI.

Migration vers OpenStreetMap et MapLibre

Lors du lancement d'OldNYC, Google Maps constituait le choix par défaut pour la cartographie web, avec une utilisation gratuite. Mais le modèle tarifaire de Google a évolué. Fin 2024, l'entreprise a remplacé son crédit gratuit de 200$/mois par des quotas distincts pour chaque API.

Sous ce nouveau système, OldNYC aurait coûté environ 35$/mois. Plutôt que de payer Google indéfiniment pour un projet personnel, Vanderkam a migré le site vers des tuiles vectorielles OpenStreetMap et la bibliothèque MapLibre.

Avantages de la Stack Ouverte

Cette nouvelle infrastructure apporte plusieurs bénéfices tangibles :

- Rendu accéléré : Affichage plus rapide des cartes

- Zoom fluide : Transitions sans saccades entre les niveaux de détail

- Contrôle du style : Personnalisation complète de l'apparence cartographique

Cette maîtrise stylistique permet notamment de supprimer les anachronismes comme les autoroutes et tunnels construits après les années 1930. Le tunnel Brooklyn-Battery, inauguré en 1950, n'apparaît plus sur les cartes d'images datant des années 1920-1930, évitant toute confusion temporelle.

Perspectives d'Évolution du Projet

Vanderkam identifie plusieurs axes d'amélioration pour les prochaines années. L'IA pourrait extraire des informations supplémentaires directement des images : identification de personnes, de bâtiments, distinction scènes intérieures/extérieures. Ces métadonnées enrichiraient considérablement les possibilités de recherche.

L'intégration de photographies provenant d'autres collections constitue un autre objectif. Le créateur contribue également à OpenHistoricalMap, le projet cartographique historique cousin d'OpenStreetMap. Si cette base de données intègre un jour les plans de rues complets du New York historique, la géolocalisation des photos deviendrait encore plus précise.

Démocratiser la Technologie

Vanderkam souhaite faciliter la création de sites similaires pour d'autres villes. Cette volonté de partage technique s'inscrit dans une démarche de préservation patrimoniale collaborative, où les outils d'IA servent le bien commun.

Le projet illustre comment les technologies de traitement d'images peuvent servir des objectifs culturels et éducatifs, au-delà des applications commerciales habituelles.

Implications pour la Préservation Numérique

Le succès d'OldNYC démontre que les modèles de langage de grande taille transforment la gestion des archives numériques. Des tâches qui nécessitaient des années de développement spécialisé en 2015 deviennent accessibles via des API en 2026.

| Tâche | Approche 2015 | Approche 2026 |

|---|---|---|

| OCR | Pipeline Ocropus personnalisé | GPT-4o-mini via API |

| Extraction d'entités | Expressions régulières complexes | GPT-4o avec prompts contextuels |

| Coût développement | Plusieurs mois | Quelques semaines |

Cette évolution pose néanmoins des questions sur la pérennité des projets dépendant de services commerciaux. La migration vers OpenStreetMap montre l'importance de privilégier les solutions open source pour les projets à long terme, particulièrement dans le domaine patrimonial.

Réplication et Scalabilité

Les techniques employées par OldNYC sont transposables à d'autres contextes : archives municipales, collections photographiques familiales, documentation d'entreprises historiques. La combinaison GPT + OpenStreetMap + MapLibre constitue une stack accessible pour des projets similaires.

Cependant, comme le soulignent les analyses sur les coûts de l'IA, la viabilité économique nécessite une réflexion approfondie. Pour un projet personnel comme OldNYC, les appels API restent abordables. Pour une institution traitant des millions d'images, l'équation change radicalement.

Leçons pour les Développeurs et Archivistes

L'expérience d'OldNYC offre plusieurs enseignements pratiques pour quiconque travaille avec des archives numériques :

- Qualité des sources : Toujours privilégier les images haute résolution originales plutôt que les versions web compressées

- Prompts minimalistes : Fournir trop de contexte aux modèles IA peut provoquer des hallucinations. Parfois, moins d'information produit de meilleurs résultats

- Validation humaine : Même avec 96% de précision, les 4% d'erreurs restants justifient un système de correction communautaire

- Infrastructure ouverte : Pour les projets à long terme, privilégier les technologies open source évite les dépendances coûteuses

Ces principes s'appliquent au-delà de la cartographie historique, dans tous les domaines où l'IA traite des données patrimoniales ou culturelles. Ils rappellent que la technologie doit servir la précision et l'accessibilité, pas seulement l'automatisation.

Le cas OldNYC montre également comment les avancées en IA bénéficient directement aux projets citoyens et culturels, pas uniquement aux applications commerciales. Cette démocratisation technologique ouvre des perspectives passionnantes pour la préservation du patrimoine mondial.

Pour aller plus loin dans l'utilisation des outils d'IA pour vos propres projets de traitement d'images ou de textes, créez votre compte gratuit sur Roboto et découvrez comment automatiser vos workflows créatifs et techniques.