Imaginez converser avec quelqu'un qui ignore tout du monde moderne, des smartphones aux réseaux sociaux. Cette expérience fascinante devient possible grâce aux modèles de langage vintage, des intelligences artificielles entraînées exclusivement sur des textes historiques. En avril 2026, une équipe de chercheurs a présenté talkie, un modèle IA de 13 milliards de paramètres formé uniquement sur 260 milliards de tokens de textes anglais publiés avant le 31 décembre 1930.

Cette approche novatrice ouvre des perspectives inédites pour comprendre les capacités de généralisation de l'IA. Contrairement aux assistants conversationnels modernes, talkie représente un voyage dans le temps technologique qui soulève des questions fondamentales sur l'apprentissage automatique.

Les modèles de langage vintage : une nouvelle approche de la recherche en IA

Les modèles de langage vintage constituent une innovation méthodologique majeure dans l'étude de l'intelligence artificielle. En limitant volontairement les données d'entraînement à une période historique définie, les chercheurs créent des laboratoires expérimentaux uniques pour tester les capacités réelles des systèmes d'IA.

Cette démarche répond à plusieurs objectifs scientifiques précis. Premièrement, elle permet d'évaluer la capacité de prédiction du futur d'un modèle. Les chercheurs ont mesuré la « surprise » de talkie face à des descriptions d'événements historiques postérieurs à 1930, révélant une augmentation notable dans les années 1950-1960, suivie d'un plateau. Cette métrique quantifie littéralement l'imprévisibilité du progrès technologique et social.

Deuxièmement, ces modèles testent la capacité d'innovation indépendante. Comme le questionne Demis Hassabis, un modèle entraîné jusqu'en 1911 pourrait-il redécouvrir la théorie de la relativité générale d'Einstein publiée en 1915 ? Ou anticiper des inventions comme l'hélicoptère de Sikorsky (1935), les machines de Turing (1936) ou la xérographie de Carlson (1942) ?

Éliminer la contamination des données

La contamination des données représente un problème persistant dans l'évaluation des modèles de langage contemporains. Lorsqu'un modèle a été exposé, directement ou indirectement, aux réponses des tests utilisés pour l'évaluer, ses performances surestiment ses véritables capacités de généralisation.

Les modèles vintage éliminent ce biais par construction. Un modèle entraîné sur des textes d'avant 1931 ne peut avoir mémorisé du code Python moderne ou des concepts informatiques qui n'existaient pas à l'époque. Cette approche rejoint les préoccupations soulevées dans l'intégration responsable de l'IA, où la validation rigoureuse des capacités réelles est essentielle.

Talkie : performances et capacités d'un modèle IA des années 1930

Talkie-1930-13b représente le plus grand modèle de langage vintage développé à ce jour. Entraîné sur 260 milliards de tokens provenant de livres, journaux, périodiques scientifiques, brevets et jurisprudence publiés avant 1931, il offre une fenêtre unique sur l'apprentissage automatique sans exposition au web moderne.

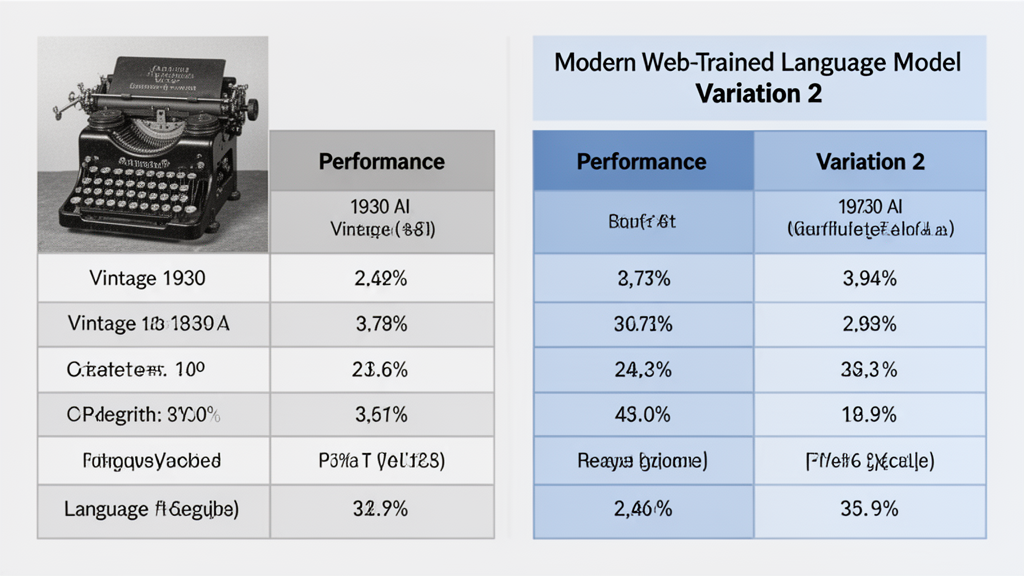

Comparaison avec un jumeau moderne

Pour contextualiser ses performances, les chercheurs ont créé un « jumeau moderne » de talkie : un modèle architecturalement identique mais entraîné sur FineWeb, un corpus web contemporain. Cette comparaison révèle des écarts significatifs mais instructifs.

En moyenne, talkie sous-performe son homologue moderne sur les évaluations standards, même après correction des questions anachroniques (concernant des événements postérieurs à 1930). Cependant, sur les tâches de compréhension linguistique fondamentale et de calcul numérique, les performances restent comparables.

| Catégorie d'évaluation | Talkie-1930 | Jumeau moderne | Écart |

|---|---|---|---|

| Connaissances générales | Faible | Élevé | Important |

| Compréhension linguistique | Moyen | Moyen-élevé | Modéré |

| Raisonnement numérique | Moyen | Moyen | Faible |

| Programmation Python | Très faible | Élevé | Très important |

Apprentissage de la programmation sans exposition préalable

L'expérience la plus fascinante concerne la capacité de talkie à apprendre la programmation Python uniquement via des exemples contextuels (in-context learning). Malgré l'absence totale de code informatique dans ses données d'entraînement, le modèle parvient à résoudre certains problèmes simples du benchmark HumanEval.

Les solutions correctes restent basiques : programmes d'une ligne (comme additionner deux entrées) ou modifications mineures d'exemples fournis. Par exemple, talkie a réussi à implémenter la fonction de décodage d'un chiffrement par rotation après avoir vu la fonction d'encodage, en inversant simplement une addition en soustraction. Cette réussite suggère une compréhension émergente des fonctions inverses.

Cette capacité d'apprentissage contextualisé rappelle les avancées récentes des systèmes d'IA autonomes, bien que talkie opère avec des contraintes historiques bien plus restrictives.

Défis techniques du développement de modèles vintage

Créer un modèle de langage vintage présente des obstacles techniques uniques, bien différents de ceux rencontrés lors du développement de modèles contemporains comme ceux utilisés dans l'assistant Mistral pour l'administration française.

Prévenir les fuites temporelles

L'objectif primordial consiste à garantir qu'aucune donnée postérieure au 31 décembre 1930 ne contamine le corpus d'entraînement. Les fuites peuvent survenir de plusieurs manières :

- Documents modernes avec métadonnées de date erronées

- Anciens documents comportant des insertions anachroniques (introductions éditoriales, notes de bas de page ajoutées ultérieurement)

- Rééditions contenant des mises à jour du contenu original

Pour talkie-1930, les chercheurs ont développé un classificateur d'anachronismes basé sur les n-grammes au niveau du document. Malgré ces précautions, des fuites subsistent : le modèle connaît des détails sur la présidence Roosevelt (1933-1945), le New Deal et même la Seconde Guerre mondiale.

Ces imperfections soulignent la complexité du nettoyage de données historiques, un défi comparable aux problématiques de qualité rencontrées dans les systèmes d'IA multimodale modernes.

Qualité de la reconnaissance optique de caractères (OCR)

Contrairement aux textes web nativement numériques, tous les documents d'avant 1931 nécessitent une transcription depuis des sources physiques. Cette étape introduit un type de bruit absent des corpus modernes.

Les systèmes OCR classiques, bien qu'efficaces sur des mises en page simples et des numérisations de haute qualité, peinent sur les documents historiques complexes. Les expériences contrôlées révèlent un constat alarmant : un modèle entraîné sur des textes d'avant 1931 transcrits par OCR conventionnelle n'atteint que 30% de la performance d'un modèle entraîné sur des versions transcrites manuellement des mêmes textes, à budget de calcul égal.

Un nettoyage par expressions régulières améliore ce chiffre à 70%, laissant encore un écart substantiel de 30%. Pour combler cette lacune, l'équipe développe un système OCR vintage spécialisé, évitant les hallucinations de faits modernes que produisent parfois les systèmes basés sur les modèles de vision-langage (VLM) contemporains.

Post-entraînement vintage : créer un assistant conversationnel historique

Transformer un modèle de base en assistant conversationnel nécessite habituellement un ajustement fin (fine-tuning) sur des paires instruction-réponse. Pour talkie, utiliser des données d'entraînement conversationnel modernes introduirait des connaissances, styles et attentes anachroniques.

Sources de données structurées historiques

L'équipe a construit un pipeline de post-entraînement entièrement nouveau, basé sur des textes historiques à structure régulière :

- Manuels d'étiquette (comme celui de Beadle, 1859)

- Encyclopédies de connaissances pratiques (Henley, 1914)

- Guides de salon et de conversation (Sandison, vers 1895)

- Manuels de correspondance épistolaire (Chambers, 1900)

- Livres de cuisine historiques

- Dictionnaires et encyclopédies d'époque

Ces ouvrages présentent naturellement des formats question-réponse ou instruction-exécution, permettant de générer des paires d'entraînement authentiquement historiques. Cette méthodologie garantit que le modèle conserve une perspective cohérente avec sa période de connaissance, sans contamination par les conventions conversationnelles du XXIe siècle.

Cette approche artisanale du post-entraînement contraste fortement avec les méthodes standardisées utilisées pour les assistants de programmation modernes, qui s'appuient sur d'immenses corpus de conversations contemporaines.

Perspectives futures : vers des modèles vintage à l'échelle GPT-3

L'équipe de talkie ne compte pas s'arrêter à ce modèle de 13 milliards de paramètres. Plusieurs développements majeurs sont annoncés pour les mois à venir.

Expansion de la taille du modèle

Un modèle de taille GPT-3 (175 milliards de paramètres) est actuellement en entraînement, avec une publication prévue pour l'été 2026. Cette augmentation d'échelle permettra d'observer les tendances de performance en fonction de la taille du modèle, notamment sur les capacités de prédiction à long terme et de génération d'idées nouvelles.

Les estimations préliminaires suggèrent que le corpus pourrait être étendu à plus d'un trillion de tokens de texte historique, suffisant pour créer un modèle de niveau GPT-3.5, comparable au ChatGPT original en termes de capacités. Cette ambition rejoint les efforts d'entreprises comme xAI d'Elon Musk pour développer des modèles à grande échelle, bien que dans un contexte radicalement différent.

Extension multilingue du corpus

La version actuelle de talkie se concentre sur les textes anglophones, principalement pour des raisons de validation (les chercheurs sont anglophones natifs et peuvent vérifier la qualité des sources). L'expansion multilingue constitue une priorité élevée pour plusieurs raisons :

- Augmentation substantielle de la taille du corpus disponible

- Diversification des perspectives culturelles et intellectuelles représentées

- Possibilité d'étudier les différences de développement conceptuel entre langues

- Accès à des traditions scientifiques et littéraires non anglophones

Cette diversification pourrait révéler comment différentes cultures et langues ont abordé des concepts similaires avant 1931, offrant des insights uniques sur l'universalité versus la spécificité culturelle de certaines idées.

Implications pour la recherche en intelligence artificielle

Au-delà de la curiosité intellectuelle de converser avec une IA « du passé », les modèles vintage soulèvent des questions fondamentales sur la nature même de l'apprentissage automatique.

L'impact de la diversité des données

Tous les modèles de langage modernes, qu'ils soient développés par OpenAI, Anthropic, Google ou d'autres acteurs comme ceux impliqués dans les alliances stratégiques récentes, partagent une caractéristique commune : ils ont été entraînés, directement ou indirectement (via distillation ou données synthétiques), sur le web contemporain.

Cette homogénéité des sources soulève une question cruciale : dans quelle mesure nos connaissances sur les modèles de langage concernent-elles le langage humain en général, plutôt que ce corpus particulier qu'est le web ?

Entraîner des modèles sur des sources radicalement différentes (textes historiques, littérature spécialisée, corpus non-occidentaux) pourrait produire des IA aux comportements, dispositions et capacités très différents. L'étude comparative de ces variations améliorerait notre compréhension des :

- Personas : comment les modèles développent-ils des « personnalités » distinctes ?

- Comportements : quels patterns émergent selon les données d'entraînement ?

- Dispositions : comment les biais et tendances se forment-ils ?

Généralisation au-delà des données d'entraînement

La capacité de talkie à résoudre (partiellement) des problèmes de programmation Python sans jamais avoir vu de code informatique démontre une forme de généralisation abstraite. Cette capacité reste limitée, mais son existence même est significative.

Elle suggère que certaines structures logiques et computationnelles peuvent émerger de l'exposition à des textes décrivant des processus, des raisonnements et des transformations, même sans notation formelle moderne. Cette observation pourrait éclairer les débats sur la nature de la « compréhension » des modèles de langage.

Projets vintage concurrents et écosystème de recherche

Talkie s'inscrit dans un mouvement plus large de développement de modèles de langage vintage. Plusieurs projets notables contribuent à cet écosystème émergent :

- Ranke-4B : un modèle de 4 milliards de paramètres explorant des périodes historiques spécifiques

- Mr. Chatterbox : axé sur les styles conversationnels du XIXe siècle

- Machina Mirabilis : spécialisé dans les textes scientifiques et techniques historiques

Cette prolifération de projets indique un intérêt croissant de la communauté de recherche pour cette approche méthodologique. La mise en open source de talkie (disponible sur GitHub et Hugging Face) encourage la collaboration et la reproductibilité, des valeurs essentielles dans la recherche scientifique.

L'approche collaborative rappelle les dynamiques observées dans d'autres domaines de l'IA, comme le développement d'outils spécialisés pour des cas d'usage particuliers.

Applications pratiques et considérations éthiques

Au-delà de l'intérêt purement scientifique, les modèles vintage pourraient trouver des applications concrètes dans plusieurs domaines.

Éducation et médiation culturelle

Les musées, institutions éducatives et médiathèques pourraient utiliser ces modèles pour créer des expériences immersives historiques. Imaginez des visiteurs conversant avec une IA représentant la perspective d'un intellectuel de 1920, discutant des enjeux de l'époque sans anachronisme.

Recherche historique et littéraire

Les chercheurs en histoire ou en littérature pourraient utiliser ces modèles pour :

- Analyser les patterns linguistiques d'une époque

- Identifier les concepts émergents dans les textes historiques

- Comparer les perspectives d'époques différentes sur des questions similaires

- Détecter les évolutions sémantiques de termes au fil du temps

Préoccupations éthiques

Les textes historiques reflètent inévitablement les préjugés, discriminations et perspectives problématiques de leur époque. Un modèle entraîné sur des textes d'avant 1931 reproduira nécessairement des biais racistes, sexistes et autres formes de discrimination normalisées à l'époque.

Cette réalité soulève des questions éthiques importantes sur l'utilisation appropriée de tels modèles. Les développeurs devront implémenter des garde-fous pour contextualiser ces biais historiques sans les perpétuer, un défi comparable aux enjeux réglementaires actuels de l'IA.

Conclusion : une fenêtre temporelle sur l'intelligence artificielle

Talkie-1930-13b représente bien plus qu'une curiosité technologique. Ce modèle de langage vintage offre un laboratoire unique pour étudier les capacités fondamentales de généralisation, de raisonnement et d'apprentissage des systèmes d'IA, libéré des biais de contamination qui affectent les évaluations de modèles contemporains.

Les résultats préliminaires, bien qu'encourageants, révèlent les limites actuelles : performances modestes en programmation, fuites temporelles résiduelles, défis de qualité OCR. Pourtant, la feuille de route ambitieuse – modèles à l'échelle GPT-3, expansion multilingue, amélioration de la transcription – promet des avancées significatives.

Plus fondamentalement, cette approche interroge nos présupposés sur l'IA. En nous forçant à distinguer ce qui relève du langage humain universel de ce qui découle spécifiquement du corpus web moderne, les modèles vintage enrichissent notre compréhension théorique de l'apprentissage automatique. Ils rappellent que l'intelligence artificielle, loin d'être une entité monolithique, peut prendre des formes radicalement différentes selon les données qui la nourrissent.

Pour aller plus loin dans l'exploration des capacités de l'IA moderne, créez votre compte gratuit sur Roboto et découvrez comment générer du contenu texte, image et vidéo avec les technologies les plus avancées.