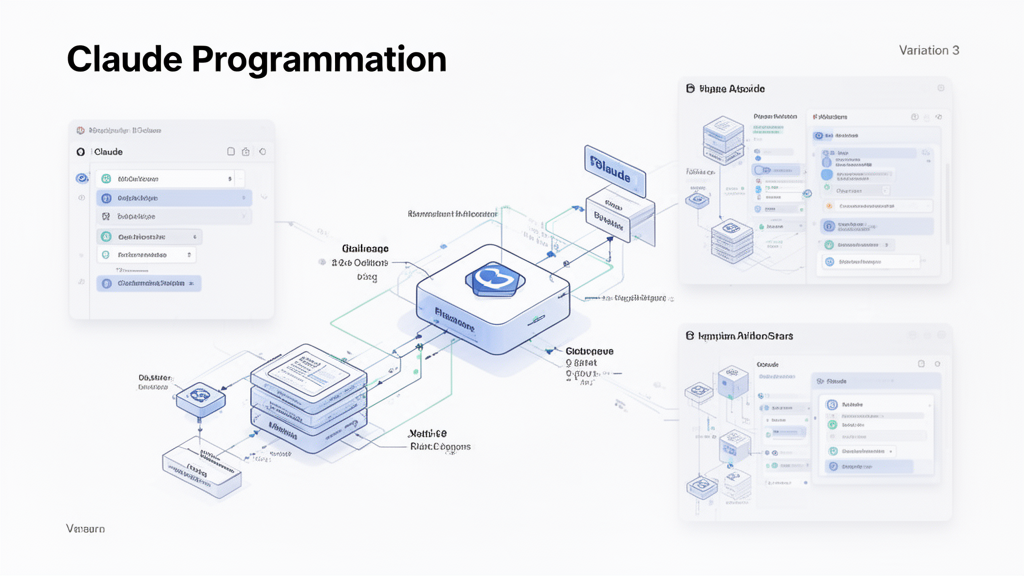

En février 2026, l'utilisation de l'IA générative dans le développement logiciel continue de diviser la communauté tech. Entre scepticisme et enthousiasme, peu d'études de cas documentent réellement l'impact concret de ces outils sur la qualité et la performance du code. L'expérience menée par Tim Bray avec Claude sur son projet Quamina apporte un éclairage factuel sur cette question sensible.

Cette analyse examine comment les capacités de Claude en programmation ont permis de doubler les performances d'une bibliothèque Go complexe, sans rhétorique ni parti pris.

Le Contexte : Quamina, une Bibliothèque Go Haute Performance

Quamina est une bibliothèque Go spécialisée dans le pattern matching événementiel. Son architecture repose sur deux API principales : AddPattern() pour ajouter des motifs (littéraux ou expressions régulières), et MatchesForEvent() qui analyse des données JSON pour identifier les correspondances.

La particularité de Quamina réside dans son utilisation d'automates finis (déterministes et non-déterministes) pour maintenir des performances élevées même avec un nombre croissant de patterns. Pour un code non lié aux I/O, l'optimisation se concentre sur deux aspects critiques : le choix algorithmique et la gestion mémoire.

Les Défis de la Gestion Mémoire en Go

Go propose deux structures natives : les maps (tables de hachage) et les slices (tableaux extensibles). Cette simplicité cache une complexité d'optimisation. Dans un code performant, le profiler ne devrait montrer que du temps passé dans la logique métier, l'ajout aux slices et la mise à jour des maps.

Le problème survient lorsque le profiler révèle un temps excessif dans les routines malloc et le garbage collector. L'objectif : minimiser les allocations lors de l'exécution de MatchesForEvent().

La Collaboration Claude-Développeur : Méthodologie et Workflow

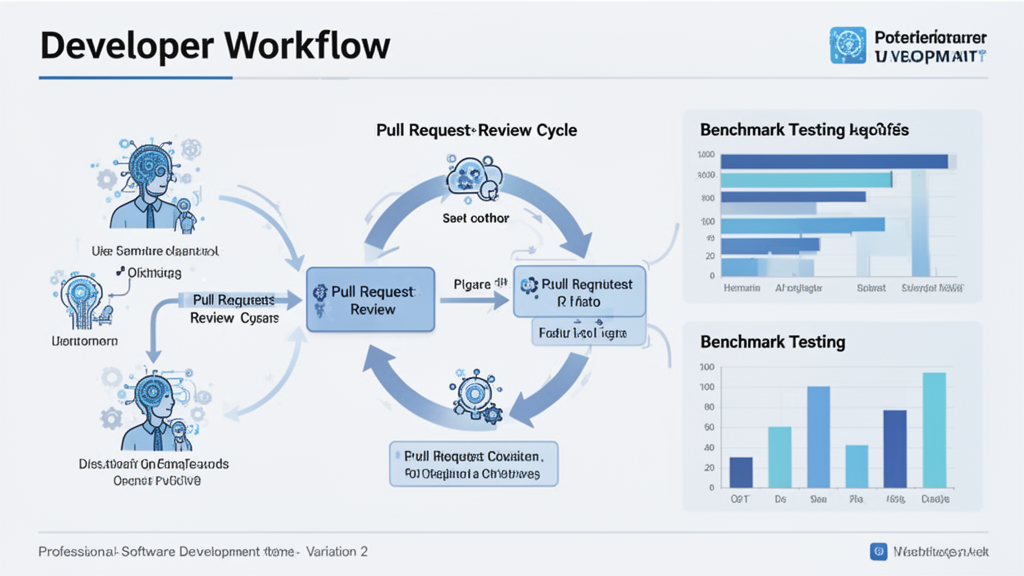

Rob Sayre, collaborateur occasionnel de Tim Bray dans le cadre de l'IETF, a initié en janvier 2026 une série de pull requests générées avec Claude. Contrairement aux débats abstraits sur l'utilisation de l'IA dans le développement, cette approche documentait chaque étape.

Le Processus Itératif

Le workflow décrit par Rob illustre une collaboration homme-machine efficace : "Je peux changer de contexte très rapidement avec Claude. Vous laissez un commentaire, je demande à Claude de corriger, car vous avez raison. Parfois je modifie manuellement, mais généralement il s'approche ou atteint la perfection (ce qu'ils appellent un 'one-shot')."

Cette méthode rappelle les principes du kaizen japonais : de petites améliorations successives produisant un impact substantiel. Chaque PR était accompagnée de tests unitaires, de benchmarks et de commentaires détaillés.

Les Optimisations Classiques : Slices et Capacité

Les premières pull requests exploitaient deux techniques standard d'optimisation Go connues de tout développeur expérimenté :

- Pré-allocation de capacité : créer des slices avec une capacité suffisante pour éviter les réallocations dynamiques

- Réutilisation de slices : conserver et vider les slices après chaque enregistrement, permettant à leur capacité de croître naturellement jusqu'à stabilisation

- Optimisation des maps : réduire les créations répétées de tables de hachage dans les boucles critiques

Ces optimisations, bien que classiques, nécessitaient une analyse minutieuse du code pour identifier tous les points d'amélioration. Claude excellait dans cette tâche systématique, repérant des opportunités que même un développeur chevronné avec 47 ans d'expérience avait manquées.

Les Innovations Algorithmiques : Au-delà des Optimisations Standard

L'aspect le plus remarquable de cette collaboration émergea lorsque Claude proposa deux améliorations non triviales, dépassant le répertoire habituel des optimisations Go.

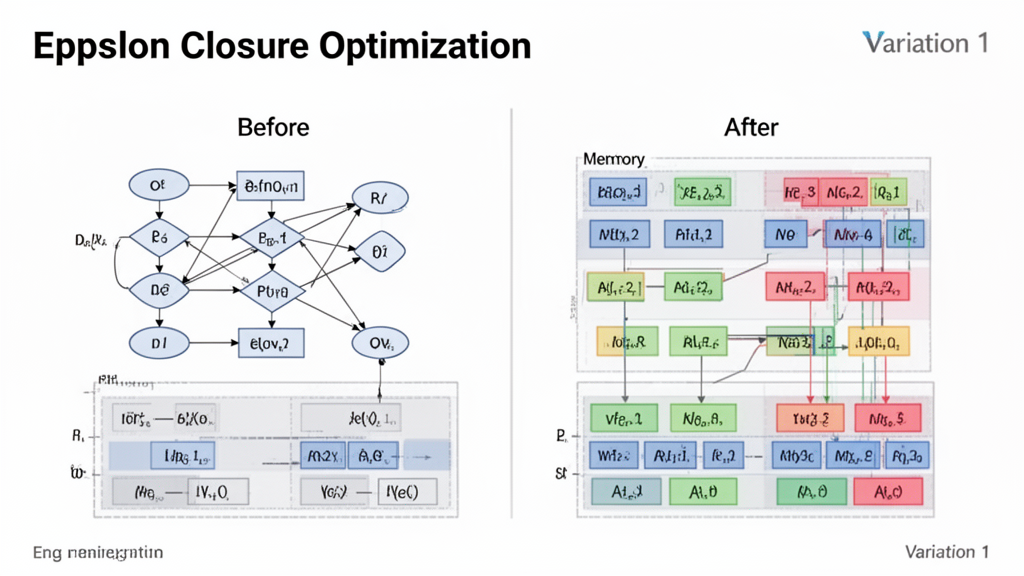

Pré-calcul des Fermetures Epsilon

Dans un automate fini non-déterministe (NFA), la fermeture epsilon d'un état représente l'ensemble des états accessibles via des transitions epsilon. L'implémentation initiale calculait ces fermetures à la volée avec un cache par thread.

L'observation de Claude : "Les fermetures epsilon sont une propriété de la structure de l'automate, pas des données d'entrée. Une fois qu'un pattern est ajouté et le NFA construit, la fermeture epsilon pour n'importe quel état est fixe et ne change jamais."

Cette approche, similaire aux techniques d'optimisation algorithmique assistée par IA, permettait de pré-calculer les fermetures lors de la construction du NFA et de les partager entre tous les threads, éliminant la redondance des caches locaux.

Remplacement des Sets par des Compteurs de Génération

Le calcul des fermetures nécessite une mémorisation pour éviter les boucles infinies dans le NFA. L'implémentation utilisait un set (map[whatever]bool en Go).

Claude proposa une alternative élégante : attribuer un champ "génération de fermeture" entier à chaque état et maintenir une valeur globale de génération. Cette technique éliminait complètement le besoin d'allocation de set, au coût d'un seul entier par état.

Les benchmarks confirmèrent l'amélioration mesurable des performances.

Résultats Quantifiables : Doublement des Performances

L'ensemble des optimisations produisit des résultats tangibles sur plusieurs benchmarks représentatifs des tâches typiques de Quamina. Les performances furent approximativement doublées, une amélioration significative pour une bibliothèque déjà optimisée.

| Aspect | Avant Optimisation | Après Optimisation |

|---|---|---|

| Allocations mémoire (matching) | Multiples allocations par événement | Zéro allocation (allocation-free) |

| Fermetures epsilon | Cache par thread | Pré-calcul global partagé |

| Mémorisation NFA | Sets (map[x]bool) | Compteurs de génération |

| Performance globale | Baseline | ~2x plus rapide |

Qualité du Code et Maintenabilité

Un aspect crucial souvent négligé dans les discussions sur le code généré par IA concerne sa qualité et sa maintenabilité. Dans ce cas précis, plusieurs indicateurs positifs émergent :

Critères de Qualité Respectés

- Commentaires détaillés : chaque PR incluait des explications claires des modifications

- Couverture de tests : aucune régression de la suite de tests unitaires existante

- Benchmarks systématiques : preuves quantifiables des améliorations

- Code idiomatique : respect des conventions Go établies

- Révision humaine : validation et ajustements par un développeur expérimenté

Tim Bray nota : "J'ai trouvé quelques points à contester mais Rob et moi n'avons eu aucun problème à les résoudre." Cette capacité à itérer et corriger rapidement constitue un avantage majeur du workflow homme-IA.

Limites et Garde-fous Nécessaires

Cette expérience positive ne doit pas masquer les précautions indispensables lors de l'utilisation d'IA générative pour le code de production.

Le Rôle Critique de l'Expertise Humaine

Rob Sayre possédait l'expertise nécessaire pour évaluer les suggestions de Claude : "Il propose de bonnes et de mauvaises idées, puis je les sélectionne." Sans cette capacité de discernement, les suggestions inappropriées auraient pu être intégrées.

Cette dynamique rappelle les enjeux de supervision et validation dans les systèmes IA, où l'intervention humaine reste essentielle.

Infrastructure de Validation

Le succès reposait sur une infrastructure solide :

- Suite complète de tests unitaires pré-existante

- Benchmarks représentatifs des cas d'usage réels

- Processus de revue de code rigoureux

- Documentation technique détaillée du projet

Implications pour le Développement Logiciel en 2026

Cette étude de cas illustre un modèle de collaboration homme-IA qui pourrait se généraliser dans l'industrie logicielle. Contrairement aux craintes de remplacement, on observe plutôt une amplification des capacités humaines.

Changement de Paradigme dans l'Optimisation

L'IA permet d'explorer systématiquement l'espace des optimisations possibles, une tâche fastidieuse pour un humain. Le développeur conserve le rôle de curateur, sélectionnant et validant les améliorations pertinentes.

Ce modèle s'apparente aux évolutions observées dans d'autres secteurs adoptant l'IA, où l'expertise métier reste centrale.

Vélocité de Développement

Rob soulignait la capacité à "changer de contexte très rapidement" avec Claude. Cette agilité transforme le processus d'optimisation, traditionnellement chronophage, en une conversation itérative rapide.

Perspectives et Questions Ouvertes

Tim Bray annonce deux articles complémentaires : l'un sur quamina-rs (port Rust généré par Claude), l'autre sur les implications pour l'open source. Ces développements soulèvent des questions importantes :

- Comment les licences open source s'appliquent-elles au code généré par IA ?

- Quelle attribution pour les contributions IA dans les projets collaboratifs ?

- Les modèles IA entraînés sur du code open source créent-ils des obligations réciproques ?

Ces interrogations juridiques et éthiques, similaires aux débats sur la propriété intellectuelle dans l'IA, nécessiteront des clarifications dans les mois à venir.

Leçons pour les Développeurs

Cette expérience offre plusieurs enseignements pratiques pour les développeurs souhaitant intégrer l'IA générative dans leur workflow :

Prérequis Techniques

- Infrastructure de test robuste : impossible de valider les suggestions IA sans tests automatisés

- Benchmarks pertinents : mesurer objectivement l'impact des modifications

- Documentation claire : permettre à l'IA de comprendre le contexte du projet

- Expertise du domaine : capacité à évaluer la pertinence des suggestions

Workflow Recommandé

Le processus itératif de Rob illustre une approche efficace : présenter le contexte à l'IA, obtenir des propositions, sélectionner les meilleures, tester rigoureusement, et itérer rapidement sur les retours.

Cette méthodologie s'aligne avec les bonnes pratiques de développement moderne, où l'automatisation et la validation continue sont centrales.

Au-delà du Débat Polarisé

Tim Bray évite délibérément la polémique, présentant des faits plutôt que des opinions. Cette approche pragmatique contraste avec le débat souvent toxique sur l'IA dans le développement logiciel.

Les résultats parlent d'eux-mêmes : code de meilleure qualité, performances doublées, maintien de la couverture de tests, et collaboration productive. Ces données factuelles devraient informer les discussions futures sur l'adoption de l'IA dans le développement.

L'expérience Quamina démontre qu'entre le rejet catégorique et l'adoption aveugle existe un chemin médian : l'utilisation réfléchie de l'IA comme outil d'amplification des compétences humaines, sous supervision experte et avec validation rigoureuse.

Pour les développeurs cherchant à améliorer leurs workflows avec l'IA, cette étude de cas offre un modèle reproductible. L'avenir du développement logiciel ne sera probablement ni entièrement humain ni entièrement automatisé, mais une synergie entre expertise humaine et assistance algorithmique. Pour aller plus loin dans l'optimisation de vos projets avec l'IA, créez votre compte gratuit sur Roboto et découvrez nos outils de génération de contenu technique.