En mars 2026, l'intelligence artificielle connaît une transformation majeure : après des années de domination du cloud computing, l'Edge AI (intelligence artificielle locale) s'impose comme l'alternative privilégiée pour de nombreuses applications. Cette évolution répond à des enjeux cruciaux de latence, de confidentialité et d'autonomie qui redéfinissent notre rapport à l'IA.

Du lave-vaisselle connecté aux véhicules autonomes, nos objets quotidiens génèrent désormais des volumes de données considérables. Traditionnellement traitées sur des serveurs distants, ces informations migrent progressivement vers des systèmes de traitement local. Comprendre cette transition devient essentiel pour anticiper les usages technologiques de demain.

L'Internet des Objets : Un Écosystème Générateur de Données Massives

Les capteurs intelligents peuplent désormais chaque aspect de notre environnement. Dans les habitations, les bureaux, les hôpitaux et les systèmes de transport, ces dispositifs collectent en permanence des informations sur la température, la qualité de l'air, les mouvements ou encore l'état de santé des utilisateurs.

Cette prolifération de l'Internet des Objets (IoT) génère des volumes de données sans précédent. Les données de connectivité provenant des points d'accès wifi ou des balises Bluetooth permettent d'identifier les modèles d'occupation et d'optimiser le chauffage, la ventilation ou les évacuations selon les périodes et les types d'événements.

L'AIoT (Artificial Intelligence of Things) combine précisément l'IA et l'IoT pour automatiser les systèmes interconnectés et permettre une prise de décision intelligente basée sur des données réelles à grande échelle. Cette convergence technologique ouvre la voie à des applications révolutionnaires, notamment dans le domaine médical où l'analyse de données en temps réel devient cruciale.

Les Limites du Cloud Computing pour l'Intelligence Artificielle

Pendant des années, les plateformes cloud comme Amazon Web Services ou Google Cloud Platform ont dominé le traitement des données IA. Ces infrastructures centralisées offrent des ressources informatiques abondantes, capables d'héberger des modèles de fondation complexes et des systèmes d'apprentissage profond gourmands en calcul.

La Latence : Un Obstacle Majeur

La transmission de grands volumes de données IoT vers le cloud augmente considérablement les temps de réponse. Selon les conditions réseau et le volume transmis, les délais peuvent atteindre plusieurs centaines de millisecondes, voire plusieurs secondes. Pour des applications critiques nécessitant des décisions instantanées, cette latence devient rédhibitoire.

Dans un véhicule autonome ou un système de surveillance médicale, chaque milliseconde compte. Le traitement cloud introduit un délai incompatible avec les exigences de réactivité de ces systèmes. Cette problématique explique pourquoi les smartphones intègrent désormais des puces IA dédiées pour traiter localement certaines tâches.

Confidentialité et Sécurité des Données

Le transfert d'informations sensibles vers des serveurs distants soulève des questions légitimes de confidentialité. Dans une maison intelligente, les données des compteurs ou des commandes d'éclairage révèlent des habitudes d'occupation précises et permettent la localisation intérieure des occupants.

Les entreprises confrontées aux réglementations sur la protection des données préfèrent désormais conserver leurs informations sensibles en interne. Comme le souligne la gestion stratégique de l'IA en entreprise, le contrôle des données constitue un enjeu majeur de souveraineté numérique.

Edge AI : L'Intelligence Artificielle au Plus Près des Utilisateurs

L'Edge AI désigne l'exécution de modèles d'intelligence artificielle directement sur des appareils locaux ou des serveurs de proximité, sans nécessiter de connexion permanente au cloud. Cette approche exploite des ressources informatiques situées dans le même bâtiment, sur des passerelles locales ou dans des microcentres de données à proximité.

Les Avantages du Traitement Local

Le traitement local élimine les délais de transmission réseau, permettant des temps de réponse quasi instantanés. Les données restent confinées à proximité de leur source, réduisant drastiquement l'exposition aux risques de sécurité et respectant mieux la vie privée des utilisateurs.

Cette approche s'avère particulièrement pertinente pour les applications industrielles où les données de production contiennent des secrets de fabrication. Les grands modèles de langage peuvent ainsi analyser l'état des machines et prédire les besoins de maintenance sans exposer ces informations sensibles à des infrastructures tierces. Les préoccupations concernant l'utilisation des données par les IA renforcent l'attrait du traitement local.

Split Computing et Optimisation des Ressources

Les ressources périphériques disposent de capacités limitées comparées aux datacenters cloud. Le split computing répond à cette contrainte en partitionnant les modèles d'apprentissage profond entre plusieurs nœuds locaux, répartissant intelligemment la charge de calcul.

Cette technique permet d'exécuter des modèles complexes sur des appareils aux ressources modestes en distribuant les opérations les plus gourmandes. L'intégration des modèles de fondation complexifie encore cette orchestration, nécessitant des stratégies d'optimisation sophistiquées.

Apprentissage Fédéré : Former des Modèles sans Centraliser les Données

L'apprentissage fédéré représente une innovation majeure de l'Edge AI. Cette technique permet de former des modèles d'apprentissage automatique directement sur des appareils locaux, y compris sur des dispositifs IoT dotés de capacités de traitement limitées.

Concrètement, les données brutes ne quittent jamais l'appareil source. Seules les mises à jour du modèle sont transmises vers une plateforme d'agrégation où elles sont combinées pour affiner le modèle global. Cette approche garantit que les informations personnelles restent confinées localement tout en bénéficiant de l'apprentissage collectif.

Dans le secteur médical, l'apprentissage fédéré permet d'entraîner des modèles diagnostiques sur les données de milliers d'hôpitaux sans jamais centraliser les dossiers patients. Cette méthode respecte les réglementations strictes sur les données de santé tout en améliorant continuellement la précision des algorithmes.

Cas d'Usage Concrets de l'Edge AI en 2026

| Domaine | Application Edge AI | Avantages |

|---|---|---|

| Maison intelligente | Analyse des habitudes d'occupation pour optimisation énergétique | Confidentialité préservée, réactivité instantanée |

| Santé | Surveillance continue des signes vitaux | Alertes temps réel, données médicales sécurisées |

| Industrie | Maintenance prédictive des machines | Protection des secrets industriels, réduction des arrêts |

| Transport | Véhicules autonomes et gestion du trafic | Décisions instantanées, sécurité renforcée |

| Commerce | Analyse comportementale en magasin | Personnalisation sans tracking centralisé |

Ces applications illustrent la diversité des secteurs adoptant l'Edge AI. Les agents IA autonomes bénéficient particulièrement de cette architecture décentralisée pour prendre des décisions contextuelles sans dépendre d'une connexion cloud permanente.

Les Défis Techniques de l'Edge AI

Absence de Plateformes Standardisées

Contrairement aux plateformes cloud matures, l'écosystème Edge AI manque encore de solutions standardisées pour le déploiement à grande échelle. Les fournisseurs de télécommunications commencent à exploiter les ressources locales sur les sites d'antennes, mais la gestion de ces infrastructures distribuées reste complexe.

La variabilité et l'hétérogénéité des ressources périphériques compliquent leur orchestration. Un déploiement peut impliquer des dizaines de serveurs et d'appareils aux capacités disparates, nécessitant des outils de gestion sophistiqués encore en développement.

Maintenance et Mise à Jour des Modèles

La maintenance constitue un obstacle majeur au déploiement des services Edge AI. Mettre à jour des milliers de modèles répartis sur des appareils géographiquement dispersés représente un défi logistique considérable, particulièrement comparé à la simplicité de mise à jour d'un modèle centralisé sur le cloud.

Les questions de sécurité se complexifient également : chaque appareil périphérique constitue un point d'entrée potentiel pour les cyberattaques. Les risques liés à l'IA agentique et au cyberespionnage nécessitent des protocoles de sécurité robustes à chaque nœud du réseau distribué.

Edge AI et Cloud : Vers une Approche Hybride

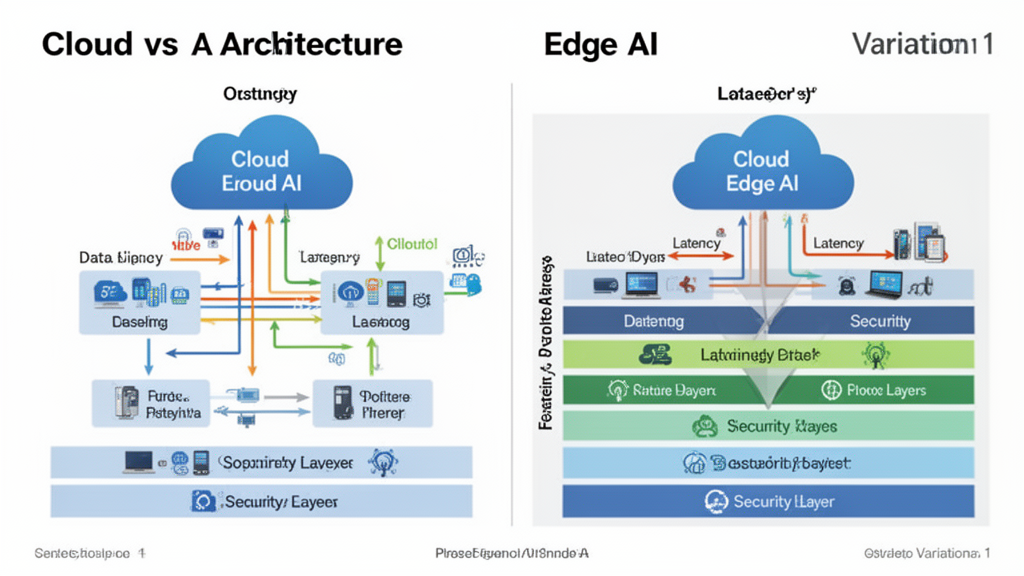

Plutôt qu'une opposition binaire, l'avenir se dessine autour d'architectures hybrides combinant les forces du cloud et de l'Edge AI. Le cloud conserve sa pertinence pour l'entraînement initial des modèles complexes, exploitant ses ressources computationnelles massives et ses vastes ensembles de données.

Une fois entraînés, ces modèles sont optimisés et déployés sur des ressources périphériques pour l'inférence en temps réel. Cette approche tire parti de la puissance du cloud pour l'apprentissage tout en bénéficiant de la réactivité et de la confidentialité de l'Edge pour l'exécution.

Optimisation des Modèles pour l'Edge

Le déploiement sur des ressources limitées nécessite des techniques d'optimisation spécifiques :

- Quantification : Réduction de la précision numérique des poids du modèle pour diminuer la taille et accélérer les calculs

- Élagage : Suppression des connexions neuronales peu importantes pour alléger le modèle

- Distillation : Création de modèles compacts reproduisant le comportement de modèles plus larges

- Compilation spécialisée : Adaptation du code aux architectures matérielles spécifiques des appareils cibles

Ces techniques permettent de réduire la taille des modèles de plusieurs ordres de grandeur tout en préservant l'essentiel de leurs performances. Un modèle de plusieurs gigaoctets peut ainsi être compressé pour tenir dans quelques dizaines de mégaoctets, le rendant déployable sur des smartphones ou des systèmes embarqués.

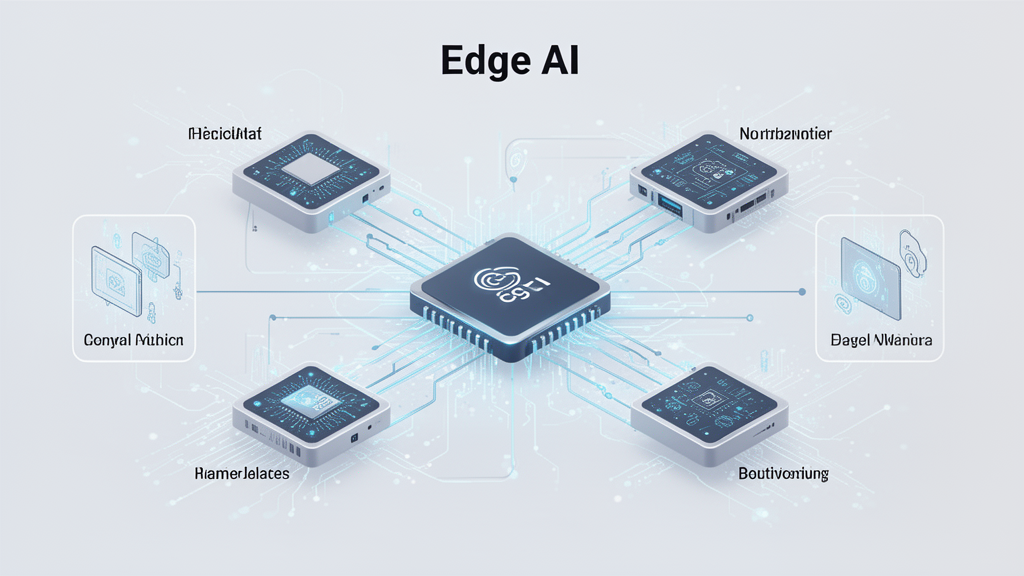

L'Impact sur l'Écosystème Technologique

L'essor de l'Edge AI transforme profondément l'industrie technologique. Les fabricants de puces développent des processeurs spécialisés (NPU, Neural Processing Units) optimisés pour l'inférence IA locale. Apple, Qualcomm, MediaTek et d'autres intègrent désormais ces accélérateurs dans leurs systèmes sur puce.

Les frameworks de développement évoluent également pour faciliter le déploiement Edge. TensorFlow Lite, PyTorch Mobile, ONNX Runtime et d'autres outils simplifient la conversion et l'optimisation des modèles pour l'exécution sur appareils mobiles et embarqués.

Cette évolution rappelle la transition décrite dans les perspectives du cloud computing, où la répartition intelligente des charges entre local et distant redéfinit l'architecture informatique.

Perspectives et Enjeux pour 2026-2030

Le marché de l'Edge AI connaît une croissance exponentielle. Les analystes prévoient une multiplication par cinq de ce secteur d'ici 2030, porté par l'adoption dans l'industrie 4.0, la santé connectée, les villes intelligentes et les véhicules autonomes.

Plusieurs tendances structurantes se dessinent :

- Démocratisation des puces IA : Les accélérateurs neuronaux deviennent standard dans tous les appareils, des montres connectées aux électroménagers

- Standardisation des frameworks : Émergence de protocoles communs facilitant l'interopérabilité entre fabricants

- Réglementation renforcée : Cadres juridiques encadrant le traitement local des données sensibles

- Efficacité énergétique : Développement de modèles ultra-frugaux pour prolonger l'autonomie des appareils mobiles

Les défis restent nombreux : complexité de déploiement, fragmentation des écosystèmes, formation des développeurs aux spécificités de l'Edge AI. Néanmoins, les bénéfices en termes de latence, confidentialité et résilience justifient les investissements massifs dans cette direction.

Conclusion : Une Complémentarité Plus Qu'une Opposition

L'Edge AI ne signe pas la fin du cloud computing, mais inaugure une ère de complémentarité intelligente. Le cloud conserve son rôle central pour l'entraînement de modèles complexes et le stockage de vastes ensembles de données, tandis que l'Edge excelle dans l'exécution locale, réactive et respectueuse de la vie privée.

Cette répartition des tâches optimise l'utilisation des ressources : calculs lourds et occasionnels dans le cloud, inférences fréquentes et sensibles au temps sur l'Edge. Les architectures hybrides émergentes exploitent le meilleur des deux mondes, adaptant dynamiquement la localisation du traitement selon les contraintes de chaque situation.

En mars 2026, l'Edge AI s'impose comme une composante essentielle de l'infrastructure IA moderne. Son adoption accélérée transforme nos interactions avec la technologie, rendant l'intelligence artificielle plus réactive, plus privée et plus autonome. Pour les entreprises comme pour les particuliers, comprendre cette évolution devient crucial pour naviguer dans le paysage technologique de demain.

Pour aller plus loin dans l'exploitation de ces technologies, créez votre compte gratuit sur Roboto et découvrez comment l'IA peut transformer vos projets de création de contenu.