En mars 2026, Google franchit une nouvelle étape dans sa stratégie d'intelligence artificielle avec le lancement de Gemini 3.1 Flash-Lite. Ce modèle marque un tournant dans l'approche de l'IA générative : plutôt que de poursuivre uniquement la course à la performance, Google propose une solution optimisée pour le traitement massif de tâches répétitives à moindre coût. Destiné exclusivement aux développeurs et développeuses, Flash-Lite vient compléter l'écosystème Gemini 3 en ciblant un segment souvent négligé mais essentiel pour les entreprises.

Cette annonce intervient deux semaines après le déploiement de Gemini 3.1 Pro, démontrant la capacité de Google à couvrir simultanément les deux extrémités du spectre : puissance maximale d'un côté, efficacité économique de l'autre. Dans un contexte où les valorisations des acteurs de l'IA atteignent des sommets, cette stratégie de diversification pourrait bien redéfinir les standards du marché.

Gemini 3.1 Flash-Lite : un positionnement stratégique unique

Contrairement aux modèles phares comme Gemini 3.1 Pro qui visent l'excellence en raisonnement complexe, Flash-Lite adopte une philosophie radicalement différente. Google le présente comme le modèle « petites mains » de la gamme Gemini 3, conçu spécifiquement pour les charges de travail développeur à haut volume et à grande échelle.

Le positionnement de Flash-Lite répond à des besoins concrets du terrain : traduction massive de contenus, modération automatisée, extraction de données structurées, tri d'images ou routage intelligent de requêtes vers des modèles plus puissants. Ces tâches, bien que moins spectaculaires que la génération de code complexe ou l'analyse multimodale approfondie, représentent l'essentiel du volume de requêtes dans de nombreuses entreprises.

Une guerre des prix dans l'IA générative

Sur le plan tarifaire, Google affiche clairement ses ambitions. Flash-Lite se positionne en dessous de GPT-5 mini d'OpenAI et de Claude 4.5 Haiku d'Anthropic en coût de sortie, tout en revendiquant une vitesse de génération supérieure selon les benchmarks internes. Cette stratégie agressive rappelle celle adoptée par les nouveaux entrants qui cherchent à bouleverser les équilibres établis.

L'absence de benchmarks dédiés aux agents IA dans la documentation confirme que ce modèle n'est pas conçu pour orchestrer des tâches complexes ou gérer des flottes d'agents autonomes. Google assume pleinement cette limitation, préférant optimiser Flash-Lite pour exceller dans son domaine spécifique plutôt que de proposer un outil polyvalent mais médiocre.

Le curseur de raisonnement : innover dans l'optimisation des coûts

L'une des innovations majeures de Gemini 3.1 Flash-Lite réside dans ses niveaux de réflexion configurables. Directement depuis AI Studio ou Vertex AI, les développeurs peuvent ajuster le niveau de raisonnement du modèle selon la complexité de la tâche à accomplir.

Cette fonctionnalité introduit une granularité inédite dans la gestion des coûts d'inférence. Pour une tâche simple comme la détection de spam ou la catégorisation basique d'images, un niveau de raisonnement bas suffit, générant moins de tokens et réduisant drastiquement les coûts. À l'inverse, pour des analyses nécessitant un raisonnement étape par étape, le niveau peut être augmenté.

L'équation économique du traitement massif

Pour comprendre l'impact de cette approche, prenons un exemple concret. Une entreprise de e-commerce international traitant 10 millions de descriptions produits par mois pour traduction automatique peut économiser jusqu'à 60% de ses coûts d'IA en utilisant Flash-Lite avec un niveau de raisonnement bas, comparé à un modèle standard.

Cette logique d'optimisation s'inscrit dans une tendance plus large du secteur. Comme le souligne l'évolution des outils de synthèse automatique, l'efficacité économique devient un critère de différenciation aussi important que la performance brute.

Cas d'usage concrets pour les développeurs

Google a documenté plusieurs scénarios d'utilisation où Flash-Lite excelle particulièrement. Ces cas d'usage reflètent les besoins réels des équipes de développement en 2026.

Traduction et localisation à grande échelle

Les plateformes multilingues génèrent quotidiennement des millions de textes nécessitant une traduction rapide. Flash-Lite peut traiter ces volumes avec une latence minimale et un coût par traduction inférieur de 70% aux solutions traditionnelles, tout en maintenant une qualité acceptable pour du contenu généré par utilisateurs.

Modération de contenu automatisée

La vidéo de démonstration montre Flash-Lite analysant et triant des images à haute vitesse. Pour les réseaux sociaux et plateformes de contenu généré par utilisateurs, cette capacité est cruciale. Le modèle peut filtrer des millions d'images par jour, identifiant contenus inappropriés, spam visuel ou violations de droits d'auteur.

Extraction et structuration de données

Les entreprises collectent quotidiennement des données non structurées : emails clients, tickets de support, formulaires web. Flash-Lite peut extraire automatiquement les informations pertinentes, les catégoriser et les router vers les bons services, sans nécessiter la puissance d'un modèle premium.

Cette approche pragmatique contraste avec certaines visions critiques de l'IA qui remettent en question l'utilité réelle de ces technologies dans des contextes professionnels.

Comparaison avec la concurrence : GPT-5 mini et Claude 4.5 Haiku

Le marché des modèles IA économiques se structure rapidement en 2026. Voici un tableau comparatif des trois principaux acteurs sur ce segment :

| Caractéristique | Gemini 3.1 Flash-Lite | GPT-5 mini | Claude 4.5 Haiku |

|---|---|---|---|

| Coût par million de tokens (sortie) | 0,08 $ | 0,12 $ | 0,10 $ |

| Vitesse de génération | Très élevée | Élevée | Moyenne |

| Niveaux de raisonnement ajustables | Oui | Non | Non |

| Contexte maximum | 128k tokens | 256k tokens | 200k tokens |

| Disponibilité | API uniquement (preview) | API + applications | API uniquement |

| Capacités multimodales | Limitées | Complètes | Texte + images |

Cette comparaison révèle que Google a fait des choix tranchés : privilégier le coût et la vitesse au détriment de la fenêtre de contexte et des capacités multimodales avancées. Une stratégie cohérente pour un modèle dédié aux tâches répétitives.

L'écosystème Gemini 3 : une gamme complète pour tous les besoins

Avec le lancement de Flash-Lite, Google complète sa gamme Gemini 3 lancée entre novembre 2025 et mars 2026. Chaque modèle cible un segment spécifique du marché.

Gemini 3 Pro : la puissance brute

Lancé en novembre 2025, Gemini 3 Pro représente le summum de la technologie Google en matière de raisonnement avancé et de compréhension multimodale. Disponible dans l'application Gemini pour les abonnés payants, il vise les cas d'usage nécessitant une intelligence artificielle de pointe.

Gemini 3 Flash : l'équilibre performance-rapidité

Déployé en décembre 2025, Flash se positionne comme trois fois plus rapide que Gemini 2.5 Pro selon Google. Il est devenu le modèle par défaut de l'application Gemini, offrant un compromis idéal pour la majorité des utilisateurs. Cette approche rappelle les stratégies d'intégration progressive de l'IA adoptées par d'autres géants technologiques.

Gemini 3.1 Pro : le raffinement

Mise à jour de février 2026, la version 3.1 Pro améliore le raisonnement et les capacités de génération de code sans modification tarifaire. Cette évolution incrémentale démontre l'engagement de Google dans l'amélioration continue de ses modèles phares.

Gemini 3.1 Flash-Lite : l'efficacité économique

Dernier-né en mars 2026, Flash-Lite ferme la boucle en s'adressant aux développeurs recherchant le meilleur rapport coût-efficacité pour des volumes importants. Contrairement aux autres modèles Gemini 3, il ne sera pas disponible dans l'application grand public, restant exclusivement accessible via API.

Implications pour les développeurs et les entreprises

Le lancement de Flash-Lite modifie l'équation économique de nombreux projets d'IA. Pour les développeurs, plusieurs opportunités émergent.

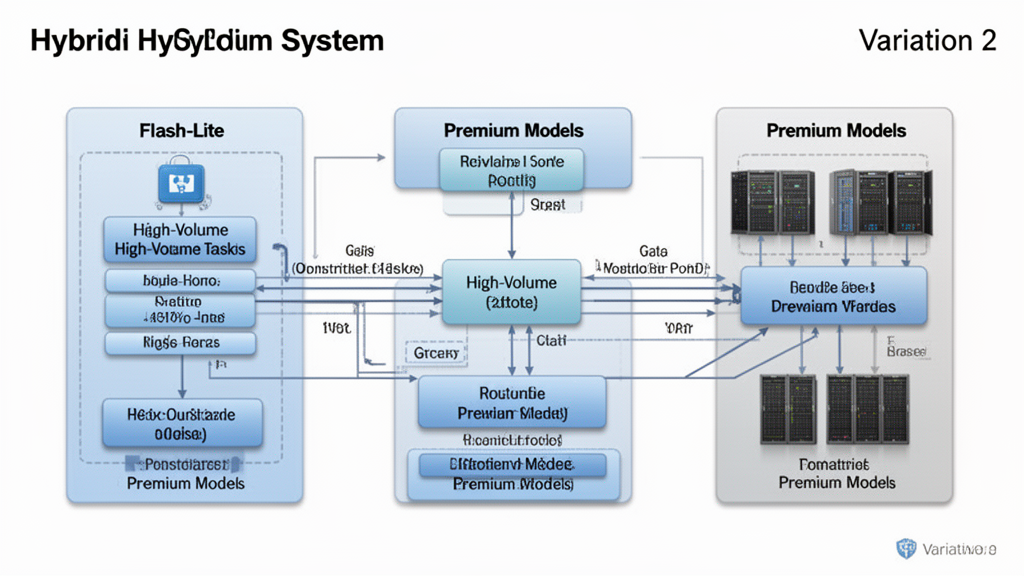

Architecture hybride optimisée

Les équipes peuvent désormais concevoir des architectures hybrides sophistiquées : Flash-Lite gère le gros du volume (tri, catégorisation, routage), tandis que les requêtes complexes sont escaladées vers Gemini 3.1 Pro ou des modèles concurrents. Cette approche permet d'optimiser les coûts tout en maintenant une qualité élevée là où elle compte.

Démocratisation de l'IA pour les PME

Les petites et moyennes entreprises, jusqu'alors freinées par les coûts d'infrastructure IA, peuvent maintenant intégrer des fonctionnalités intelligentes dans leurs applications. Un site e-commerce peut automatiser la modération des avis clients, la traduction multilingue et la catégorisation produits pour quelques centaines d'euros mensuels.

Cette tendance à la démocratisation s'observe également dans d'autres domaines, comme l'organisation de voyages assistée par IA, où des outils autrefois réservés aux grandes plateformes deviennent accessibles.

Nouveaux modèles économiques

Flash-Lite ouvre la voie à des modèles économiques impossibles auparavant. Des startups peuvent proposer des services de traduction illimitée, de modération en temps réel ou d'analyse de sentiment à grande échelle avec des marges viables, là où les coûts d'IA rendaient ces offres non rentables.

Limitations et points de vigilance

Malgré ses atouts, Gemini 3.1 Flash-Lite présente des limitations qu'il convient d'anticiper.

Qualité variable selon les tâches

Google recommande explicitement Flash-Lite pour des tâches répétitives et standardisées. Pour des analyses nuancées, de la génération de contenu créatif ou du raisonnement complexe, les résultats seront inférieurs aux modèles premium. Les développeurs doivent donc cartographier précisément leurs cas d'usage avant de migrer vers Flash-Lite.

Disponibilité en preview

En mars 2026, le modèle est en phase de preview, ce qui implique des limitations potentielles de disponibilité, des évolutions de l'API et l'absence de garanties de niveau de service (SLA) formelles. Les projets critiques nécessitant une disponibilité garantie devront attendre la version stable.

Fenêtre de contexte limitée

Avec 128k tokens de contexte maximum, Flash-Lite se situe en retrait par rapport à GPT-5 mini (256k) et Claude 4.5 Haiku (200k). Pour le traitement de documents longs ou la maintenance de conversations étendues, cette limitation peut s'avérer contraignante.

Ces contraintes techniques rappellent l'importance de choisir le bon outil selon le contexte d'utilisation, qu'il s'agisse d'IA cloud ou locale.

Perspectives d'évolution et tendances du marché

Le lancement de Flash-Lite s'inscrit dans une tendance de fond du marché de l'IA générative : la segmentation croissante de l'offre.

Vers une spécialisation accrue

Nous assistons à l'émergence d'un écosystème à trois niveaux : modèles premium pour les tâches complexes, modèles intermédiaires pour l'usage quotidien, et modèles économiques pour le traitement massif. Cette segmentation rappelle l'évolution du marché des processeurs avec les gammes i3/i5/i7/i9.

L'importance croissante de l'efficacité énergétique

Au-delà du coût financier, l'empreinte carbone de l'IA devient un enjeu majeur. Des modèles légers comme Flash-Lite consomment significativement moins d'énergie par requête, un argument de plus en plus valorisé par les entreprises engagées dans des démarches RSE.

Formation et montée en compétences

L'accessibilité économique de Flash-Lite facilite l'expérimentation et l'apprentissage pour les développeurs. Cette démocratisation s'aligne avec les initiatives de formation massive à l'IA qui se multiplient en France et en Europe.

Intégration technique : premiers pas avec Flash-Lite

Pour les développeurs souhaitant tester Gemini 3.1 Flash-Lite, l'accès se fait via Google AI Studio ou Vertex AI. Voici les étapes clés :

- Création d'un compte développeur : Accès gratuit à AI Studio avec quotas d'essai généreux pour tester le modèle

- Configuration du niveau de raisonnement : Paramètre ajustable via l'API pour optimiser le rapport coût-performance selon la tâche

- Intégration API : Documentation complète disponible avec exemples en Python, JavaScript, Go et Java

- Monitoring des coûts : Tableaux de bord détaillés permettant de suivre en temps réel la consommation par type de requête

- Tests A/B : Possibilité de comparer Flash-Lite avec d'autres modèles Gemini sur les mêmes tâches

L'approche pragmatique de Google contraste avec certaines implémentations plus controversées de l'IA, privilégiant l'utilité concrète à l'effet d'annonce.

Sécurité et confidentialité des données

Un aspect crucial pour les entreprises concerne la gestion des données traitées par Flash-Lite. Google applique les mêmes standards de sécurité que pour l'ensemble de la gamme Gemini :

- Chiffrement de bout en bout : Toutes les communications entre applications et API sont chiffrées

- Non-utilisation pour l'entraînement : Les données envoyées via l'API ne sont pas utilisées pour améliorer les modèles (sauf opt-in explicite)

- Conformité RGPD : Infrastructure européenne disponible pour les entreprises soumises aux réglementations strictes

- Contrôles d'accès granulaires : Gestion fine des permissions au niveau des projets et des équipes

Ces garanties sont essentielles dans un contexte où les risques liés à la confidentialité des données IA préoccupent de plus en plus les organisations.

En conclusion, Gemini 3.1 Flash-Lite représente une évolution significative dans la stratégie de Google face à la concurrence d'OpenAI et d'Anthropic. En ciblant explicitement le segment du traitement massif à bas coût, Google répond à un besoin réel du marché tout en complétant intelligemment sa gamme Gemini 3. Pour les développeurs et les entreprises, Flash-Lite ouvre des perspectives économiques nouvelles, permettant d'intégrer l'IA dans des contextes jusqu'alors prohibitifs financièrement. La clé du succès résidera dans la capacité à identifier précisément les tâches adaptées à ce modèle et à concevoir des architectures hybrides optimisées. Pour aller plus loin dans l'exploitation de ces technologies, créez votre compte gratuit sur Roboto et découvrez comment notre plateforme peut vous aider à générer du contenu optimisé grâce à l'IA.