En mars 2026, une étude de METR bouscule les certitudes sur les capacités réelles des agents IA en développement logiciel. Alors que les benchmarks affichent des scores impressionnants, la réalité du terrain raconte une histoire bien différente : environ la moitié des solutions de code générées par IA et validées automatiquement ne passeraient pas l'examen des mainteneurs de projets open source.

Cette découverte soulève une question fondamentale pour tous ceux qui s'intéressent aux limites actuelles de l'IA en programmation : les scores de benchmarks reflètent-ils vraiment l'utilité pratique des outils d'intelligence artificielle ?

Le Benchmark SWE-bench : Un Test Réputé pour les IA de Codage

SWE-bench Verified s'est imposé comme référence pour évaluer les capacités des modèles d'IA à résoudre de vrais problèmes de développement logiciel. Ce benchmark utilise 500 issues GitHub authentiques provenant de 12 projets open source populaires, avec un système de notation automatisé basé sur des tests unitaires.

Les performances des modèles récents semblent spectaculaires. Claude 4.5 Sonnet d'Anthropic et GPT-5 affichent des taux de réussite dépassant 60% sur ce benchmark, suggérant qu'ils peuvent résoudre automatiquement plus de la moitié des problèmes de code soumis.

Mais ces chiffres racontent-ils toute l'histoire ? L'équipe de recherche METR a décidé de le vérifier en soumettant ces mêmes solutions à l'épreuve du monde réel : la revue par des mainteneurs humains.

Méthodologie : Confronter l'IA au Jugement des Mainteneurs

Pour cette étude publiée le 10 mars 2026, les chercheurs ont recruté quatre mainteneurs actifs de trois dépôts présents dans SWE-bench Verified : scikit-learn (2 mainteneurs), Sphinx (1) et pytest (1). Ces experts ont examiné 296 pull requests générées par IA et 47 PR originales écrites par des humains.

Conditions de l'Évaluation

Les mainteneurs ont évalué chaque PR selon leurs critères habituels, avec deux ajustements méthodologiques :

- Absence d'outils d'intégration continue (linting, tests automatiques) en raison de l'état historique des dépôts

- Exemption des exigences de tests complets, les agents n'étant pas sollicités pour les créer

- Évaluation en aveugle : les reviewers ignoraient si le code provenait d'une IA ou d'un humain

Les mainteneurs devaient décider d'accepter ou de demander des modifications, en précisant la raison principale du rejet : dysfonctionnement de la fonctionnalité principale, code cassant d'autres parties du système, ou problèmes de qualité de code.

Établir une Référence Humaine

Point crucial de la méthodologie : les chercheurs ont également soumis les PR humaines originales (celles qui avaient été effectivement fusionnées dans les projets) aux mêmes mainteneurs. Résultat surprenant : seulement 68% de ces "patches dorés" ont été acceptés lors de cette réévaluation.

Ce taux de 68% établit une baseline qui révèle le niveau de subjectivité inhérent aux décisions de fusion. Tous les résultats de l'étude sont donc normalisés par rapport à cette référence, offrant une comparaison plus équitable.

Résultats Principaux : Un Écart de 24 Points Entre Benchmark et Réalité

Les données révèlent un décalage significatif entre les performances mesurées par le système automatisé et celles validées par des humains.

Tableau Comparatif : Scores Automatisés vs Validation Humaine

| Modèle IA | Score SWE-bench | Taux de Fusion Mainteneur | Écart (points) |

|---|---|---|---|

| Claude 3.5 Sonnet (Ancien) | ~45% | ~25% | -20 |

| Claude 3.7 Sonnet | ~52% | ~30% | -22 |

| Claude 4 Opus | ~58% | ~35% | -23 |

| Claude 4.5 Sonnet | ~65% | ~42% | -23 |

| GPT-5 | ~62% | ~38% | -24 |

| Moyenne | - | - | -24,2 |

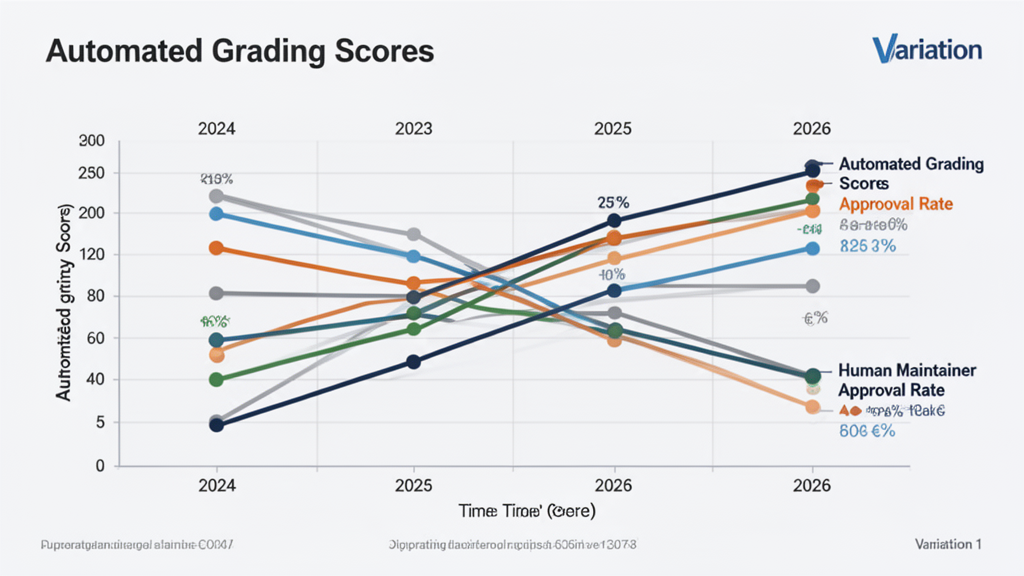

En moyenne, le taux de fusion par les mainteneurs est inférieur de 24,2 points de pourcentage au score du système automatisé, avec une marge d'erreur de 2,7 points. Cette différence est statistiquement significative et robuste.

Progression Plus Lente en Conditions Réelles

L'étude révèle également que le rythme d'amélioration diffère selon le mode d'évaluation. Les scores automatisés progressent de 9,6 points de pourcentage par an plus rapidement que les taux de fusion par mainteneurs. Toutefois, cette tendance est moins certaine statistiquement (significative seulement au seuil de 10%).

Cette observation suggère que les progrès spectaculaires affichés dans les classements de modèles IA pourraient ne pas se traduire proportionnellement en gains d'utilité pratique.

Pourquoi les IA Échouent : Analyse des Motifs de Rejet

Les mainteneurs ont catégorisé les raisons pour lesquelles ils demandaient des modifications aux PR générées par IA. Trois catégories principales émergent :

1. Problèmes de Fonctionnalité Principale

La solution ne résout pas correctement le problème initial ou contient des bugs. Paradoxalement, ces PR passent les tests automatisés mais présentent des défauts que seul un œil humain expérimenté détecte. Cela révèle les limites des systèmes automatisés pour évaluer la qualité réelle du code.

2. Code Cassant d'Autres Parties du Système

Les agents IA modifient parfois du code non lié au problème initial, créant des effets de bord indésirables. Ce manque de compréhension contextuelle du système global représente une limitation majeure des approches actuelles.

3. Qualité de Code Insuffisante

Les solutions sont verboses, ne respectent pas les conventions du projet, ou manquent d'élégance. Ce critère, hautement subjectif, explique en partie pourquoi même les "patches dorés" humains n'atteignent que 68% d'acceptation lors de la réévaluation.

Niveau de Progression Moyen

Les mainteneurs ont également évalué le niveau de progression vers une PR acceptable. Les patches dorés humains atteignent en moyenne 90% de progression, et 85% d'entre eux dépassent le seuil de 80%. En comparaison, les solutions IA affichent des scores de progression nettement inférieurs, confirmant qu'il reste du travail significatif avant la fusion.

Ce que Cette Étude Ne Dit Pas (et Pourquoi C'est Important)

Les auteurs de l'étude insistent sur trois points essentiels pour interpréter correctement leurs résultats :

Il Ne S'agit Pas d'une Limite de Capacité Fondamentale

Les agents IA n'ont eu qu'une seule tentative pour soumettre leur solution, sans possibilité d'itérer suite aux retours. Les développeurs humains, eux, affinent généralement leur code après les commentaires des reviewers. Avec de meilleurs prompts et une élicitation optimisée, de nombreux problèmes de qualité pourraient probablement être résolus.

Cette nuance est cruciale pour comprendre l'évolution des performances des modèles dans des conditions plus réalistes d'utilisation.

Les Conditions Ne Sont Pas Équitables

Comparer une IA sans feedback à un humain qui itère n'est pas une comparaison à armes égales. L'étude vise plutôt à évaluer comment les scores de benchmarks se traduisent en utilité réelle avec une utilisation naïve des agents.

Les Benchmarks Restent Utiles

Cette recherche ne disqualifie pas les benchmarks comme outils de comparaison entre modèles. Elle rappelle simplement qu'ils constituent un indicateur parmi d'autres, et non une mesure absolue de l'utilité pratique.

Implications pour les Développeurs et les Entreprises

Cette étude a des conséquences concrètes pour tous ceux qui envisagent d'intégrer des agents IA dans leurs workflows de développement.

Ajuster les Attentes

Un score de 60% sur SWE-bench ne signifie pas qu'un agent peut résoudre automatiquement 60% de vos issues GitHub sans supervision. L'intervention humaine reste nécessaire pour valider, affiner et adapter les solutions proposées.

Investir dans l'Élicitation

Les résultats suggèrent qu'améliorer la façon dont on sollicite les agents (prompts, contexte, itérations) pourrait combler une partie significative de l'écart observé. Les équipes devraient donc consacrer des ressources à l'optimisation de ces processus plutôt que de se fier uniquement aux capacités brutes des modèles.

Créer des Workflows Hybrides

Plutôt que de viser l'automatisation complète, les organisations gagneraient à concevoir des workflows où l'IA génère des solutions candidates que les développeurs humains examinent, affinent et valident. Cette approche collaborative maximise les forces de chaque partie.

Les développements récents dans l'écosystème IA montrent d'ailleurs une tendance vers ces modèles hybrides plutôt que vers le remplacement pur et simple.

Perspectives d'Avenir : Vers des Benchmarks Plus Réalistes

Cette recherche ouvre la voie à des méthodologies d'évaluation plus sophistiquées pour les agents IA de développement.

Benchmarks Multi-Itérations

De futurs benchmarks pourraient permettre aux agents de recevoir des feedbacks simulés et d'itérer sur leurs solutions, reflétant mieux le processus de développement réel. Cela fournirait une mesure plus fidèle de leurs capacités pratiques.

Évaluation de la Qualité de Code

Au-delà de la correction fonctionnelle, les benchmarks futurs pourraient intégrer des critères de qualité de code, de respect des conventions, et d'impact sur la maintenabilité du projet. Ces aspects, actuellement sous-évalués, sont cruciaux pour l'adoption en production.

Diversification des Tâches

L'étude se concentre sur SWE-bench Verified, qui contient des issues relativement simples (environ 17 lignes de code modifiées en moyenne). Des benchmarks couvrant des tâches plus complexes et variées permettraient une évaluation plus complète.

Ces évolutions méthodologiques s'inscrivent dans le contexte plus large des débats sur l'évaluation et la régulation des systèmes IA à l'échelle internationale.

Leçons pour l'Écosystème IA au Sens Large

Les enseignements de cette étude dépassent le domaine du développement logiciel et s'appliquent à l'ensemble de l'écosystème IA.

Le Piège de la Suroptimisation des Benchmarks

Quand les développeurs de modèles optimisent exclusivement pour des benchmarks, ils risquent de créer des systèmes performants sur des métriques artificielles mais moins utiles en pratique. Ce phénomène, connu sous le nom de "Goodhart's Law", rappelle que "quand une mesure devient un objectif, elle cesse d'être une bonne mesure".

L'Importance de l'Évaluation Écologique

Évaluer les IA dans des conditions proches de leur utilisation réelle ("évaluation écologique") devient crucial. Cela implique de prendre en compte les workflows humains, les contraintes organisationnelles, et les critères de qualité subjectifs mais importants.

Transparence et Communication Responsable

Les entreprises d'IA doivent communiquer clairement sur ce que leurs scores de benchmarks signifient (et ne signifient pas) en termes de performances réelles. Cette transparence est essentielle pour des décisions d'adoption éclairées.

Ces principes rejoignent les préoccupations exprimées dans les discussions sur l'utilisation responsable de l'IA dans différents contextes.

Comparaison avec les Études Antérieures

Cette recherche de mars 2026 s'inscrit dans la continuité des travaux de METR sur l'évaluation réaliste des agents IA. Elle améliore significativement leur étude précédente sur plusieurs points :

- Utilisation de mainteneurs réels plutôt que d'auto-évaluation

- Échantillon élargi : 95 tâches uniques contre 18 précédemment

- Couverture de 5 modèles de langage au lieu d'un seul

- Normalisation par rapport à une baseline humaine pour contrôler le bruit

- Évaluation en aveugle pour éliminer les biais

Ces améliorations méthodologiques rendent les conclusions actuelles plus robustes, bien que les résultats ne soient pas directement comparables (l'étude précédente portait sur des PR beaucoup plus complexes, avec plus de 500 lignes de code modifiées en moyenne).