C2PA : Comment OpenAI Utilise des Filigranes Invisibles pour Authentifier ses Images IA

Face à la prolifération des contenus générés par intelligence artificielle, OpenAI a implémenté depuis début 2024 un système de filigranes invisibles basé sur la norme C2PA pour authentifier l'origine de ses images. Cette technologie, déjà opérationnelle dans DALL-E 3, représente une avancée majeure dans la lutte contre la désinformation visuelle.

Qu'est-ce que la norme C2PA et comment fonctionne-t-elle ?

La C2PA (Coalition for Content Provenance and Authenticity) est un standard ouvert développé par un consortium d'entreprises technologiques pour certifier l'authenticité des contenus numériques. OpenAI a rejoint le comité directeur de cette coalition aux côtés d'acteurs majeurs comme Adobe, Microsoft, Sony, Nikon, Leica et Canon.

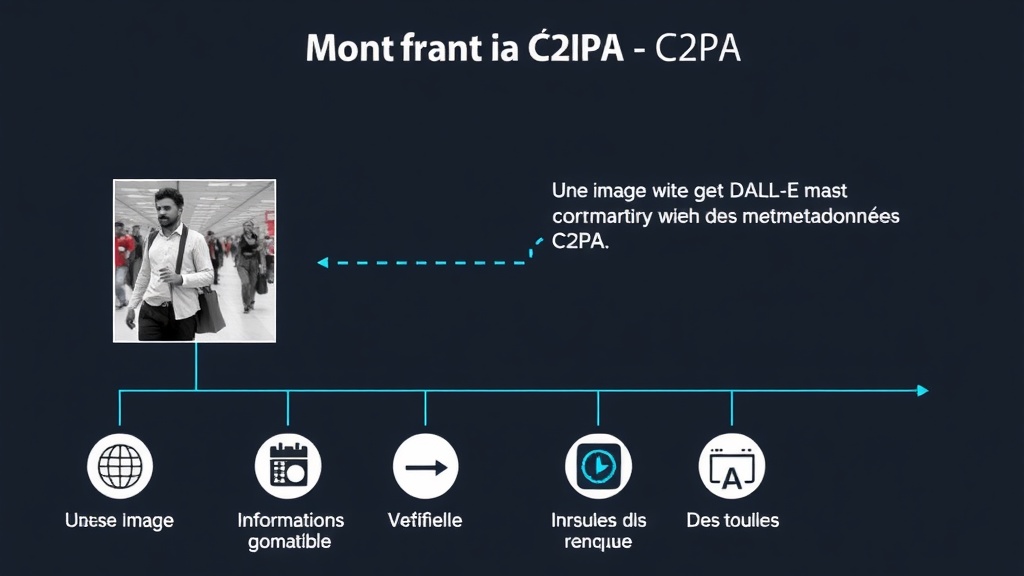

Concrètement, cette technologie fonctionne comme un passeport numérique pour chaque image générée. Toutes les images créées via DALL-E dans ChatGPT ou via l'API d'OpenAI embarquent automatiquement un tag C2PA qui contient des informations cruciales :

- L'identification du générateur d'image utilisé (DALL-E)

- Un historique détaillé des modifications apportées

- Une signature cryptographique garantissant l'intégrité de ces informations

Les avantages des filigranes C2PA pour l'authentification des images

L'implémentation de la norme C2PA par OpenAI présente plusieurs avantages significatifs pour les utilisateurs et la société :

| Avantage | Description |

|---|---|

| Transparence | Permet d'identifier clairement l'origine IA d'une image |

| Traçabilité | Conserve l'historique des modifications apportées à l'image |

| Intégrité | La signature cryptographique empêche la falsification des métadonnées |

| Compatibilité | Fonctionne avec des outils de vérification comme Content Credentials Verify |

| Impact minimal | Augmentation limitée de la taille du fichier (3 à 32%) sans dégradation de qualité |

Selon OpenAI, l'ajout de ces balises est pratiquement transparent pour l'utilisateur. Le temps de génération n'est pas significativement affecté, et la qualité de l'image reste inchangée. La seule différence notable est une légère augmentation de la taille des fichiers.

Un exemple concret : le suivi des modifications avec C2PA

Pour illustrer le fonctionnement de cette technologie, prenons l'exemple fourni par OpenAI : lorsqu'un utilisateur génère une image de chenille avec DALL-E, puis y ajoute un bonnet de Noël, les métadonnées C2PA enregistrent :

- La création initiale via DALL-E

- L'édition spécifique (ajout du bonnet)

- L'horodatage de chaque opération

Ces informations, appelées "content credentials", peuvent ensuite être consultées par n'importe quel outil compatible avec la norme C2PA. C'est un pas important vers ce que les experts en générateurs d'images IA appellent la "provenance vérifiable" - la capacité de tracer l'origine et l'historique d'un contenu numérique.

Les limites actuelles du système de filigrane C2PA

Malgré ses promesses, cette technologie présente encore plusieurs limitations importantes qu'OpenAI reconnaît ouvertement :

Premièrement, ces métadonnées peuvent être facilement supprimées, que ce soit intentionnellement ou accidentellement. Une simple capture d'écran suffit à éliminer tout tag d'origine, rendant la traçabilité inopérante.

Deuxièmement, la plupart des plateformes de médias sociaux suppriment automatiquement les métadonnées des images lors du téléchargement. Comme l'expliquait un responsable de Nikon : « L'implémentation C2PA doit couvrir tout le processus photographique, de la capture à la post-production », ce qui n'est pas encore le cas.

Enfin, il est important de noter que l'absence de balise C2PA ne prouve pas qu'une image est « authentique » - cela signifie simplement que son historique a pu être perdu ou que l'image provient d'une autre source.

Ces limitations montrent que la lutte contre la désinformation visuelle nécessite une approche plus globale que le simple marquage des images.

Application limitée aux images fixes

Une autre limitation significative est que ce mécanisme ne concerne actuellement que les images fixes. L'intégration aux contenus vidéo générés, notamment via le modèle Sora d'OpenAI, demeure à l'état de projet. Cette restriction est particulièrement préoccupante à l'heure où les générateurs de contenu IA deviennent de plus en plus sophistiqués pour créer des vidéos réalistes.

L'adoption de la norme C2PA par d'autres acteurs du marché

OpenAI n'est pas seul dans cette démarche. Adobe, par exemple, a intégré des fonctionnalités similaires dans ses logiciels phares :

Dans Lightroom et Photoshop, la fonction Content Credentials permet d'embarquer des informations sur l'origine, les modifications et l'auteur d'une photo directement dans le fichier exporté. Cette fonctionnalité est particulièrement utile pour les photographes professionnels qui souhaitent protéger leurs œuvres et en garantir l'authenticité.

Microsoft, partenaire stratégique d'OpenAI, a également annoncé l'intégration de technologies similaires dans ses outils de création de contenu, comme Designer (anciennement Bing Image Creator).

Cette convergence vers un standard commun est essentielle pour créer un écosystème cohérent où les contenus générés par IA peuvent être identifiés de manière fiable, quel que soit l'outil utilisé pour les créer.

Les perspectives d'avenir pour l'authentification des contenus IA

Face aux limitations actuelles, OpenAI travaille sur des approches complémentaires pour renforcer l'authentification des contenus générés par IA :

Filigranes algorithmiques résistants

Une piste prometteuse concerne le développement de filigranes algorithmiques invisibles directement intégrés dans les médias. Contrairement aux métadonnées C2PA, ces filigranes seraient théoriquement plus résistants aux manipulations et pourraient survivre à des opérations comme les captures d'écran ou les compressions.

Cette approche s'inspire des techniques de tatouage numérique (digital watermarking) utilisées depuis longtemps dans l'industrie musicale et cinématographique pour protéger les droits d'auteur.

Détection a posteriori

En parallèle, OpenAI développe des outils capables de détecter a posteriori si un contenu a été généré par IA, même en l'absence de métadonnées. Ces détecteurs s'appuient sur des caractéristiques subtiles que les modèles d'IA laissent dans leurs créations - une sorte d'« empreinte digitale » algorithmique.

Cependant, ces détecteurs sont engagés dans une course permanente avec les techniques d'évasion, ce qui limite leur fiabilité à long terme. C'est pourquoi une approche combinant plusieurs méthodes d'authentification semble être la voie la plus prometteuse.

Vers une responsabilité partagée dans l'écosystème numérique

L'initiative d'OpenAI s'inscrit dans un mouvement plus large de responsabilisation des créateurs de technologies d'IA générative. Comme le souligne un rapport récent sur les modèles IA français, la transparence devient un élément différenciateur sur le marché.

Pour que ces systèmes d'authentification soient véritablement efficaces, une collaboration à l'échelle de l'écosystème numérique est nécessaire :

- Les créateurs d'outils d'IA doivent intégrer des standards d'authentification robustes

- Les plateformes de médias sociaux doivent préserver les métadonnées d'authenticité

- Les navigateurs et systèmes d'exploitation pourraient intégrer des vérificateurs natifs

- Les utilisateurs doivent être éduqués sur l'importance de vérifier la provenance des contenus

Conclusion : un pas important mais insuffisant

L'intégration de la norme C2PA par OpenAI représente une avancée significative dans l'authentification des contenus générés par IA. En rendant transparente l'origine des images créées par DALL-E, l'entreprise contribue à établir une norme de responsabilité dans l'industrie.

Cependant, les limitations techniques actuelles montrent que cette approche ne constitue qu'une partie de la solution. La lutte contre la désinformation à l'ère de l'IA générative nécessitera une combinaison de standards ouverts, d'innovations technologiques et d'éducation des utilisateurs.

L'enjeu est de taille : restaurer la confiance dans notre environnement informationnel tout en permettant l'innovation technologique. Dans ce contexte, les initiatives comme celle d'OpenAI méritent d'être saluées, tout en reconnaissant qu'elles ne représentent que le début d'un long chemin vers un écosystème numérique plus transparent et digne de confiance.

Si vous souhaitez expérimenter avec des contenus générés par IA tout en maintenant un haut niveau d'éthique et de transparence, inscrivez-vous gratuitement à Roboto pour découvrir comment créer des contenus responsables et traçables.