Désinformation par IA: Comment le gouvernement français utilise des vidéos générées

La technologie d'intelligence artificielle générative connaît une évolution fulgurante, notamment dans la création de contenus visuels de plus en plus réalistes. Récemment, un cas particulièrement préoccupant a émergé lorsque le gouvernement français a diffusé une vidéo générée par intelligence artificielle, soulevant d'importantes questions éthiques et démocratiques. Cette situation met en lumière les dangers potentiels de l'utilisation des technologies d'IA par les institutions publiques et la nécessité de cadres réglementaires adaptés.

Le cas du gouvernement français et sa vidéo générée par IA

En mai 2025, le gouvernement français s'est retrouvé au cœur d'une controverse après avoir diffusé sur ses réseaux sociaux officiels une vidéo entièrement créée par intelligence artificielle. Cette vidéo, présentée comme un reportage factuel sur les avancées d'une politique publique, ne comportait aucune mention claire de son caractère artificiel, laissant penser aux citoyens qu'il s'agissait d'images réelles.

L'incident a soulevé de vives réactions dans la sphère médiatique et politique, d'autant plus que cette pratique contrevient aux principes de transparence attendus des institutions démocratiques. Les experts en détection de fake news ont rapidement identifié plusieurs marqueurs typiques des contenus générés par IA, mais le grand public n'avait pas nécessairement les outils pour faire cette distinction.

Les risques de la désinformation institutionnelle par IA

L'utilisation de contenus générés par IA sans transparence par des institutions officielles présente plusieurs risques majeurs :

- Érosion de la confiance publique envers les institutions

- Manipulation de l'opinion par la présentation de situations qui n'existent pas réellement

- Création d'un précédent dangereux légitimant l'usage de fausses informations

- Difficulté croissante pour les citoyens de distinguer le vrai du faux

- Normalisation de pratiques de communication trompeuses

Comme l'expliquent les chercheurs en éthique de l'IA, la frontière entre illustration créative et désinformation devient particulièrement floue lorsque les contenus générés artificiellement sont présentés comme authentiques, surtout par des sources considérées comme fiables.

Cadre légal et réglementaire face à la désinformation par IA

La France, comme de nombreux pays européens, renforce progressivement son arsenal juridique pour encadrer l'utilisation de l'IA, notamment dans la sphère publique. L'AI Act européen, entré pleinement en vigueur en 2024, impose des obligations de transparence concernant les contenus générés par intelligence artificielle.

| Réglementation | Exigences principales | Application aux institutions |

|---|---|---|

| AI Act (UE) | Marquage obligatoire des contenus générés par IA | Applicable aux institutions publiques |

| Loi française sur la manipulation de l'information | Interdiction de diffuser des fausses informations | S'applique à tous les acteurs, y compris l'État |

| Règles déontologiques de la communication publique | Obligation de transparence et d'honnêteté | Spécifiquement conçues pour les institutions |

Malgré ce cadre, la réglementation de l'IA reste en évolution constante et peine parfois à suivre le rythme des avancées technologiques, créant des zones grises dont certains acteurs peuvent profiter.

La réponse des autorités face à la controverse

Suite à la polémique, le gouvernement a publié un communiqué reconnaissant l'utilisation de l'IA, tout en défendant cette pratique comme un moyen "innovant" de communication. Cette justification a été largement critiquée par les experts en éthique numérique qui soulignent qu'innovation ne devrait pas rimer avec désinformation.

La CNIL (Commission Nationale de l'Informatique et des Libertés) a ouvert une enquête pour déterminer si cette pratique constitue une violation des principes de transparence algorithmique, tandis que le CSA (Conseil Supérieur de l'Audiovisuel) examine la question sous l'angle de la manipulation de l'information.

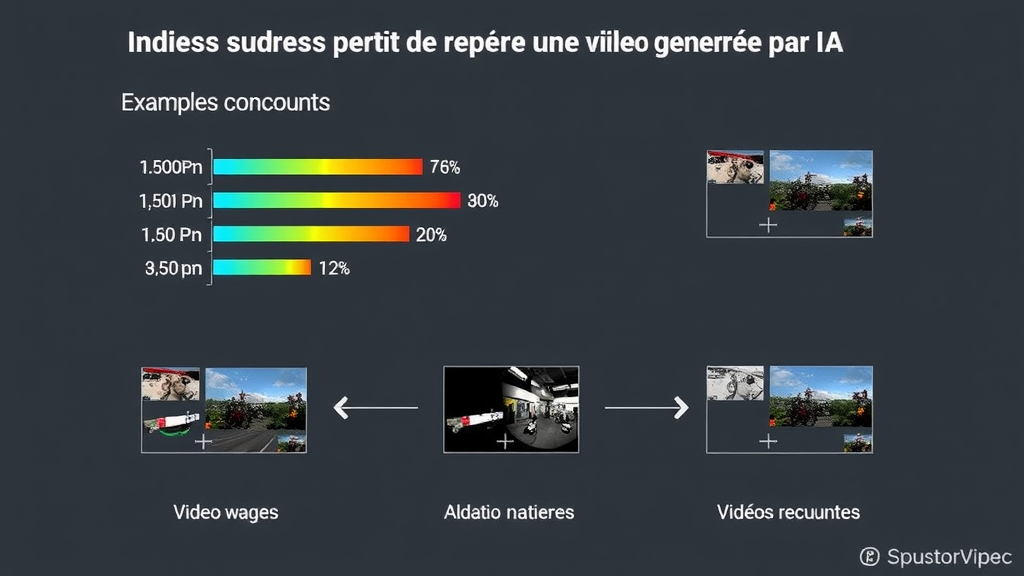

Comment identifier les vidéos générées par IA

Face à la multiplication des contenus générés par intelligence artificielle, il devient crucial pour les citoyens de développer des compétences en détection des erreurs d'IA. Voici quelques indices qui peuvent aider à repérer une vidéo créée artificiellement :

- Incohérences visuelles : Mouvements non naturels, déformations subtiles des visages ou des objets

- Problèmes de synchronisation : Décalage entre les mouvements des lèvres et les paroles

- Arrière-plans trop parfaits : Absence de détails aléatoires qu'on trouve dans la réalité

- Transitions artificielles : Changements de plans ou d'angles qui ne respectent pas les règles classiques du montage

- Qualité inégale : Variations de définition ou de style visuel au sein d'une même vidéo

Des outils comme les détecteurs de contenus IA se développent rapidement, mais la meilleure protection reste la vigilance et l'esprit critique face à tout contenu, même provenant de sources officielles.

L'impact sur la démocratie et la confiance publique

L'utilisation de technologies d'IA pour créer des contenus présentés comme réels par les institutions gouvernementales soulève des questions fondamentales sur l'avenir de notre démocratie. Dans un contexte où la France développe sa stratégie IA, il est crucial que l'éthique et la transparence soient au cœur des préoccupations.

Les sondages montrent déjà une érosion de la confiance des citoyens envers l'information officielle, et l'utilisation de l'IA pour créer des contenus trompeurs ne fait qu'aggraver cette tendance. À terme, c'est la légitimité même des institutions démocratiques qui pourrait être remise en question si les pratiques de communication ne respectent pas des standards élevés d'honnêteté.

Vers une utilisation responsable de l'IA dans la communication publique

Pour éviter les dérives tout en bénéficiant des avantages de l'IA dans la communication institutionnelle, plusieurs bonnes pratiques émergent :

- Signaler clairement et visiblement tout contenu généré par IA

- Limiter l'usage de l'IA générative à des fins illustratives et non factuelles

- Mettre en place des comités d'éthique pour évaluer les usages de l'IA

- Former les communicants publics aux enjeux éthiques des technologies génératives

- Développer des standards de transparence spécifiques aux institutions

Certaines institutions comme le Parlement européen ont déjà adopté des chartes d'utilisation de l'IA qui pourraient servir de modèle pour les administrations nationales.

Conclusion: Vers une éthique de l'IA institutionnelle

L'incident de la vidéo gouvernementale générée par IA constitue un signal d'alarme important pour notre démocratie. Si les technologies d'intelligence artificielle offrent d'immenses possibilités pour moderniser la communication publique, leur utilisation doit impérativement s'accompagner d'une transparence totale et d'un respect scrupuleux de la vérité.

Les citoyens ont plus que jamais besoin de pouvoir faire confiance à leurs institutions, particulièrement dans un monde où la désinformation se propage à une vitesse inédite. L'État, loin d'alimenter la confusion, devrait au contraire être le garant de l'information fiable et vérifiable.

Si vous souhaitez approfondir vos connaissances sur la création et la détection de contenus générés par IA, Roboto propose des outils avancés qui vous permettront de maîtriser ces technologies tout en respectant les principes éthiques essentiels. Inscrivez-vous gratuitement pour découvrir comment générer du contenu de qualité de manière responsable et transparente.