En février 2026, les modèles d'IA conversationnelle atteignent des performances impressionnantes. Claude, GPT-4, et leurs successeurs génèrent des réponses de plus en plus pertinentes. Pourtant, un problème fondamental persiste : rafraîchir la page d'un chatbot interrompt la conversation, efface le contexte et crée une expérience utilisateur frustrante. Cette limitation technique révèle un décalage majeur entre l'évolution des modèles et celle des infrastructures qui les supportent.

Alors que les entreprises intègrent massivement l'IA, cette faiblesse architecturale devient critique. Comprendre ce problème technique permet d'anticiper les solutions émergentes et d'optimiser l'expérience conversationnelle de vos applications.

Le problème du rafraîchissement : démonstration avec Claude

L'interface de Claude illustre parfaitement ce dysfonctionnement. Lorsqu'un utilisateur soumet une question, le système commence à diffuser les tokens générés par le modèle. Si l'utilisateur rafraîchit la page pendant cette génération, la connexion se coupe instantanément. L'interface affiche alors un squelette de chargement, et la réponse en cours disparaît complètement.

Ce n'est qu'après un second rafraîchement que la réponse complète réapparaît, une fois que le serveur a terminé la génération et stocké le résultat dans la base de données. Cette expérience fragmentée révèle les limites de l'architecture technique sous-jacente, basée sur les Server-Sent Events (SSE).

Comment fonctionnent les SSE dans les chatbots

Claude utilise l'API EventSource pour implémenter les SSE. Voici le processus technique :

- L'interface envoie l'ensemble du contexte conversationnel au serveur via une requête POST

- Le serveur transmet ces messages au modèle (Claude Sonnet 4.5 par exemple)

- La connexion HTTP reste ouverte pendant que le modèle génère les tokens

- Chaque token généré est transmis au client sous forme d'événement SSE

- Le client affiche progressivement la réponse au fur et à mesure

Le flux SSE ressemble à ceci : un événement message_start initie la conversation, suivi de multiples content_block_delta contenant chaque fragment de texte, puis un message_stop conclut la génération. Chaque token arrive séquentiellement, créant l'illusion d'une conversation fluide.

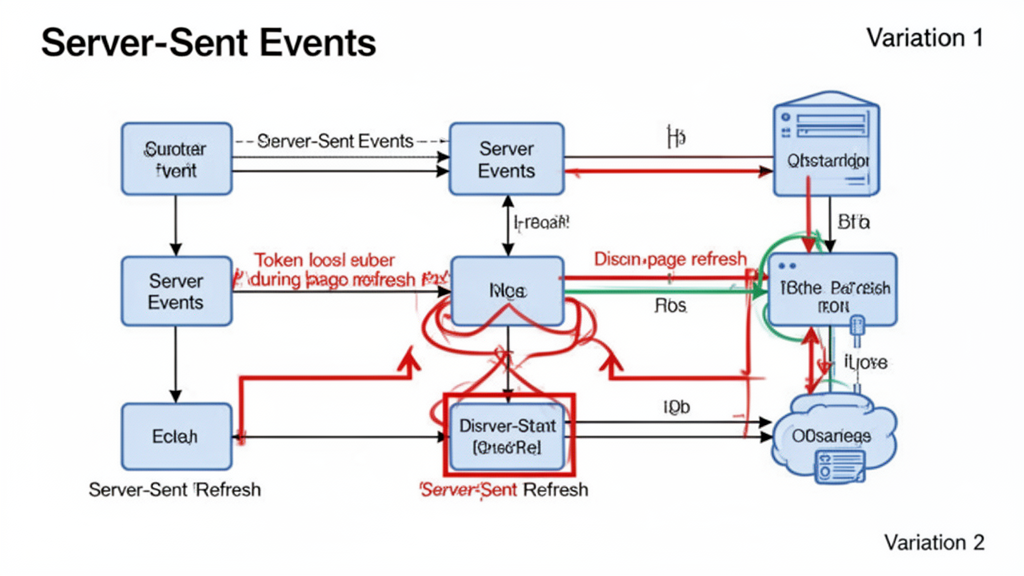

Pourquoi le rafraîchissement brise tout

Le paradigme requête-réponse des SSE est fondamentalement sans état. Quand la page se rafraîchit, le client se déconnecte du flux SSE. Les tokens déjà générés mais non encore affichés sont perdus. Le serveur continue de générer, mais le client n'a aucun moyen de récupérer ces données intermédiaires.

L'historique conversationnel ne réapparaît qu'une fois la génération complète terminée et sauvegardée en base de données. Cette architecture crée une expérience utilisateur dégradée, particulièrement problématique pour les applications IA professionnelles où la fiabilité est essentielle.

Les solutions actuelles et leurs limites

Face à ce problème, beaucoup d'éditeurs n'implémentent aucune solution. L'interface de Claude, malgré sa sophistication technique, gère mal les déconnexions. D'autres acteurs optent pour des architectures plus complexes, mais imparfaites.

La stratégie du stockage systématique

Certaines plateformes stockent chaque événement SSE dans une base de données comme Redis. Elles implémentent ensuite un endpoint de reprise permettant au client de récupérer les tokens depuis le dernier reçu. Cette approche présente plusieurs inconvénients :

- Surcharge de la base de données avec des écritures constantes

- Latence supplémentaire pour chaque token généré

- Complexité architecturale accrue pour gérer les reprises

- Coûts d'infrastructure plus élevés

Cette solution fonctionne, mais elle traite le symptôme plutôt que la cause. Elle ajoute une couche de complexité pour compenser les limites intrinsèques des SSE.

Tableau comparatif des approches techniques

| Approche | Avantages | Inconvénients | Cas d'usage |

|---|---|---|---|

| SSE sans stockage | Simple à implémenter, compatible HTTP | Perte de données au rafraîchissement | Prototypes, démos |

| SSE avec Redis | Reprise possible après déconnexion | Coûts élevés, latence, complexité | Applications à trafic modéré |

| WebSockets | Bidirectionnel, connexion persistante | Nécessite gestion des sessions | Applications conversationnelles |

| Pub/Sub moderne | Reconnexion automatique, multi-appareils | Dépendance à un service tiers | Applications professionnelles |

Au-delà des SSE : repenser l'architecture conversationnelle

Le véritable enjeu n'est pas de choisir entre SSE et WebSockets. Ces deux technologies ont atteint leurs limites pour les applications conversationnelles modernes. Le problème fondamental réside dans notre façon de concevoir le transport des données IA.

Les exigences des chatbots modernes

Les applications conversationnelles de 2026 doivent gérer des scénarios complexes que les SSE ne peuvent pas adresser efficacement :

- Reconnexion transparente : L'utilisateur doit pouvoir fermer et rouvrir son navigateur sans perdre le fil

- Multi-appareils : Démarrer une conversation sur mobile et la continuer sur desktop

- Collaboration : Plusieurs utilisateurs interagissant avec le même chatbot, comme dans les outils collaboratifs

- Historique intelligent : Persistance et récupération efficace des conversations

- Présence en temps réel : Savoir quand l'agent IA traite activement la requête

- Optimisation des tokens : Éviter de retransmettre l'intégralité du flux à chaque reconnexion

Ces fonctionnalités sont devenues essentielles, notamment pour les déploiements professionnels d'IA où la fiabilité prime sur la simplicité technique.

Pourquoi les WebSockets ne suffisent pas

Les WebSockets offrent une communication bidirectionnelle, ce qui facilite le pilotage de la conversation en temps réel. Un seul processus serveur peut gérer une conversation complète grâce à la connexion persistante. Cependant, même avec cette bidirectionnalité, l'expérience de rafraîchissement reste problématique.

Pour obtenir une reprise fluide, il faut encore stocker les identifiants de session, permettre au client de redemander le flux avec ces identifiants, et calculer côté serveur les tokens manquants. La gestion des connexions, des sessions et de la progression dans le flux reste manuelle et complexe.

L'architecture Pub/Sub : une solution émergente

Les plateformes de messagerie Pub/Sub représentent une approche architecturale différente, conçue nativement pour les cas d'usage que les chatbots modernes exigent. Ces systèmes gèrent automatiquement les problématiques qui nécessitent des développements spécifiques avec SSE ou WebSockets.

Le concept de message.append

L'innovation clé réside dans l'action message.append. Au lieu de traiter chaque token comme un événement éphémère, cette approche considère la réponse complète comme un message persistant auquel on ajoute progressivement des tokens.

Concrètement, le serveur crée un message, puis y ajoute chaque token au fur et à mesure de la génération. Les clients connectés en continu reçoivent chaque token individuellement, comme avec les SSE. Mais les clients qui se reconnectent reçoivent un message.update contenant tous les tokens jusqu'au point de reconnexion.

Les avantages techniques concrets

Cette architecture résout plusieurs problèmes simultanément :

- Efficacité réseau : Pas besoin de retransmettre chaque token delta lors d'une reconnexion

- Expérience fluide : Les clients connectés voient le streaming en temps réel, les autres obtiennent le contenu complet instantanément

- Présence automatique : Le système détecte automatiquement quand l'agent IA est actif ou s'est déconnecté

- Historique natif : Les messages persistés dans le canal forment naturellement l'historique conversationnel

- Multi-utilisateurs : Plusieurs clients peuvent s'abonner au même canal et recevoir les mêmes mises à jour

Cette approche simplifie radicalement le code applicatif. Plus besoin d'implémenter la logique de stockage des tokens, de reprise des flux, ou de gestion des déconnexions. L'infrastructure gère ces aspects automatiquement, comme les plateformes modernes le font pour d'autres fonctionnalités.

Implications pour les développeurs et les entreprises

Ce décalage entre la performance des modèles et la qualité des infrastructures crée des opportunités et des risques. Les entreprises qui continuent d'utiliser des architectures SSE basiques offrent une expérience utilisateur inférieure, malgré l'excellence de leurs modèles IA.

Choisir la bonne infrastructure

Pour les développeurs construisant des applications conversationnelles, plusieurs critères doivent guider le choix technologique :

- Volume d'utilisateurs : Les SSE conviennent aux prototypes, mais pas aux applications à fort trafic

- Criticité : Les applications professionnelles nécessitent une fiabilité que les SSE ne garantissent pas

- Collaboration : Les cas d'usage multi-utilisateurs exigent du Pub/Sub ou des WebSockets avancés

- Budget infrastructure : Stocker chaque token en Redis coûte cher à grande échelle

Comme le montrent les succès commerciaux de l'IA, l'expérience utilisateur devient un différenciateur majeur. Une architecture technique robuste n'est plus un luxe mais une nécessité compétitive.

L'avenir des interfaces conversationnelles

Les prochaines générations d'applications IA intégreront probablement :

- Synchronisation multi-appareils native : Commencer une conversation sur smartphone et la continuer sur ordinateur sans friction

- Collaboration en temps réel : Plusieurs utilisateurs interagissant simultanément avec un agent IA

- Persistance intelligente : Reprise automatique des conversations après des jours ou des semaines

- Optimisation des coûts : Compression et déduplication des tokens pour réduire les coûts de stockage

Ces fonctionnalités nécessitent de repenser l'architecture dès la conception, plutôt que d'ajouter des rustines sur des technologies inadaptées. Les entreprises qui anticipent ces besoins gagneront un avantage concurrentiel significatif, particulièrement dans le contexte économique actuel.

Recommandations pratiques pour 2026

Si vous développez ou déployez des chatbots IA, voici les actions concrètes à entreprendre :

Pour les prototypes et MVP

Les SSE restent acceptables pour valider rapidement un concept. Leur simplicité d'implémentation permet de tester l'adéquation produit-marché sans surinvestir dans l'infrastructure. Documentez cependant les limitations pour anticiper la migration future.

Pour les applications en production

Investissez dans une infrastructure Pub/Sub ou des WebSockets avec gestion avancée des sessions. Le coût initial plus élevé se justifie par la qualité d'expérience et la réduction des coûts opérationnels à long terme. Évitez la tentation de construire votre propre système de gestion de tokens, sauf si vous disposez d'une équipe infrastructure conséquente.

Pour les cas d'usage collaboratifs

Seules les architectures Pub/Sub modernes permettent réellement la collaboration multi-utilisateurs fluide. Si votre application prévoit ce type de fonctionnalité, intégrez-la dès la conception plutôt que de tenter une migration ultérieure. Les considérations légales autour de l'IA rendent également la traçabilité des conversations plus importante.

L'écart entre innovation et infrastructure

Le paradoxe de 2026 est frappant : les modèles IA progressent exponentiellement, mais les infrastructures qui les servent stagnent. Claude, GPT-4 et leurs successeurs génèrent des réponses toujours plus pertinentes, mais l'expérience utilisateur reste limitée par des choix architecturaux datés.

Cette situation rappelle les premières années du web mobile, où des sites brillamment conçus pour desktop offraient une expérience catastrophique sur smartphone. Les entreprises qui ont anticipé le mobile-first ont pris un avantage décisif. Aujourd'hui, celles qui anticipent les besoins infrastructurels des applications IA conversationnelles gagneront la prochaine vague d'innovation.

L'infrastructure n'est pas un détail technique. Elle façonne directement l'expérience utilisateur et, in fine, le succès commercial des applications IA. Un modèle excellent sur une infrastructure médiocre perd face à un modèle correct sur une infrastructure solide. Cette réalité technique devient un enjeu stratégique majeur pour toutes les entreprises déployant l'IA.

Pour aller plus loin dans l'optimisation de vos projets IA, créez votre compte gratuit sur Roboto et découvrez comment notre plateforme simplifie la création de contenu intelligent avec une infrastructure pensée pour la performance.