Dans le paysage saturé des frameworks d'apprentissage profond, TinyGrad se distingue par une philosophie radicalement différente : la simplicité absolue. Développé par Tiny Corp, ce framework open source promet de réduire la complexité des réseaux de neurones à seulement trois types d'opérations fondamentales. Alors que les géants de l'IA française continuent d'innover, TinyGrad propose une approche minimaliste qui pourrait transformer la façon dont nous développons des modèles d'intelligence artificielle.

Qu'est-ce que TinyGrad et pourquoi il change la donne

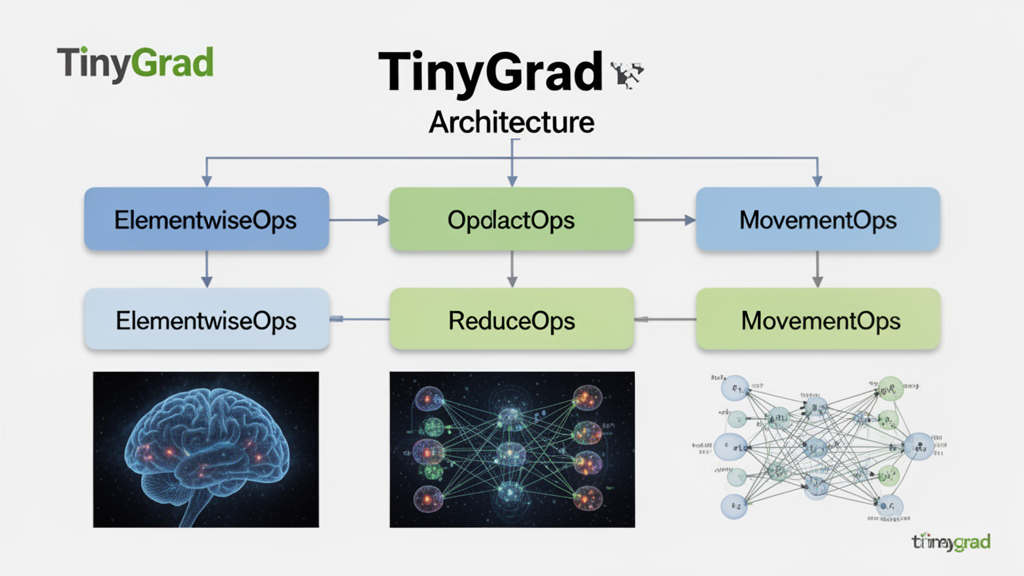

TinyGrad est un framework de réseaux de neurones qui repose sur un principe fondamental : toute opération complexe peut être décomposée en trois catégories d'opérations élémentaires. Cette architecture minimaliste contraste fortement avec les frameworks traditionnels qui accumulent des couches d'abstraction.

Les trois types d'opérations sont :

- ElementwiseOps : opérations unaires, binaires et ternaires qui s'appliquent élément par élément (SQRT, LOG2, ADD, MUL, WHERE)

- ReduceOps : opérations qui réduisent la taille d'un tenseur (SUM, MAX)

- MovementOps : opérations virtuelles qui réorganisent les données sans copie grâce au ShapeTracker (RESHAPE, PERMUTE, EXPAND)

Cette approche rappelle l'efficacité recherchée dans les outils de productivité modernes, où la simplicité devient un avantage compétitif majeur.

L'architecture technique : moins de code, plus de performance

Le mystère que TinyGrad pose volontairement est simple : où sont les convolutions et les multiplications matricielles ? La réponse se trouve dans le code source, où ces opérations complexes sont décomposées en combinaisons des trois OpTypes fondamentaux.

La compilation de kernels personnalisés

TinyGrad compile un kernel GPU personnalisé pour chaque opération, permettant une spécialisation extrême selon les dimensions des tensors. Cette approche contraste avec PyTorch qui utilise des kernels pré-compilés génériques. Comme l'expliquent les développeurs dans les récentes innovations hardware, l'optimisation au niveau du silicium devient cruciale pour les performances IA.

L'évaluation paresseuse (Lazy Evaluation)

Tous les tenseurs dans TinyGrad sont évalués de manière paresseuse, permettant une fusion agressive des opérations. Cette stratégie réduit considérablement les transferts mémoire et améliore l'utilisation du cache GPU.

| Caractéristique | TinyGrad | PyTorch |

|---|---|---|

| Lignes de code backend | ~5 000 | ~50 000+ |

| Compilation de kernels | Personnalisée par opération | Kernels pré-compilés |

| Évaluation des tenseurs | 100% paresseuse | Mixte |

| Support autodiff | Natif | Natif |

| Maturité | Alpha | Production |

TinyBox : le hardware optimisé pour TinyGrad

Tiny Corp ne se contente pas de développer un framework logiciel. L'entreprise commercialise également le TinyBox, un ordinateur spécialement conçu pour l'entraînement de modèles d'apprentissage profond.

Les trois versions disponibles

Le TinyBox red v2 (12 000$) embarque 4 GPU AMD 9070XT offrant 778 TFLOPS en FP16, avec 64 GB de RAM GPU et 128 GB de RAM système. Cette configuration vise les équipes de recherche et les startups.

Le TinyBox green v2 (65 000$) monte en puissance avec 4 RTX PRO 6000 Blackwell délivrant 3086 TFLOPS, 384 GB de RAM GPU et un système RAID de 4 TB. Destiné aux entreprises, il rivalise avec des systèmes coûtant 10 fois plus cher selon les benchmarks MLPerf Training 4.0.

L'ExaBox (10M$, livraison 2027) représente l'ambition ultime avec 720 GPU RDNA5 AT0 XL pour atteindre l'exaflop, 25,9 TB de RAM GPU et une infrastructure réseau de 3,2 TB/s. Cette machine vise les centres de calcul et les laboratoires de recherche avancée.

Performance par dollar : l'argument massue

Tiny Corp affirme que le TinyBox offre le meilleur rapport performance/prix du marché pour l'entraînement de modèles. Les tests MLPerf confirment que le TinyBox green rivalise avec des systèmes à 650 000$. Cette accessibilité rappelle comment certains outils démocratisent l'accès à des technologies autrefois réservées aux grandes entreprises.

Cas d'usage réels et adoption

TinyGrad n'est pas qu'un projet expérimental. Il est déjà utilisé en production dans OpenPilot, le système de conduite assistée open source, pour exécuter le modèle de conduite sur le GPU Snapdragon 845. Cette implémentation a remplacé SNPE (Snapdragon Neural Processing Engine) avec plusieurs avantages :

- Performances supérieures sur le même matériel

- Support natif des fichiers ONNX

- Capacité d'entraînement (pas seulement inférence)

- Support des mécanismes d'attention

Cette adoption dans un système critique comme la conduite automobile démontre la maturité croissante du framework. Tout comme l'IA transforme le diagnostic médical, TinyGrad prouve que les applications critiques peuvent bénéficier d'architectures simplifiées.

Entraînement et inférence : un framework complet

Contrairement à certains frameworks optimisés uniquement pour l'inférence, TinyGrad supporte l'intégralité du cycle d'apprentissage : forward pass, backward pass et autodifférenciation. Cette fonctionnalité est implémentée à un niveau d'abstraction supérieur au code spécifique aux accélérateurs, ce qui signifie que chaque nouveau portage vers un GPU différent hérite automatiquement de ces capacités.

API similaire à PyTorch mais plus simple

L'API de TinyGrad s'inspire de PyTorch pour faciliter la migration, tout en proposant une interface plus épurée. Les développeurs familiers avec PyTorch peuvent rapidement prendre en main TinyGrad, bien que le framework soit encore en phase alpha et donc moins stable pour la production.

Roadmap et objectifs de Tiny Corp

Tiny Corp a défini des critères précis pour sortir TinyGrad de la phase alpha : reproduire un ensemble commun de papers académiques sur un GPU NVIDIA avec des performances 2x supérieures à PyTorch, et garantir des performances excellentes sur les puces Apple M1. L'échéance visée était initialement le Q2 2026.

Stratégie de développement et embauche

L'entreprise maintenant financée recrute activement des ingénieurs logiciels à temps plein. Le processus de recrutement passe par un système de bounties (récompenses pour contributions), permettant d'évaluer les candidats sur leur capacité à contribuer au code avant l'embauche. Cette approche méritocratique attire des développeurs passionnés par l'optimisation bas niveau et l'architecture des systèmes.

Pour les postes opérationnels et hardware, une contribution préalable à TinyGrad est obligatoire. Cette exigence garantit que tous les employés comprennent profondément la philosophie du projet. Cette culture technique rappelle celle observée dans les transformations organisationnelles des entreprises tech modernes.

Avantages et limitations actuelles

Les points forts de TinyGrad

La simplicité du code facilite le debugging et l'optimisation. Avec un backend 10 fois plus petit que PyTorch, chaque amélioration d'un kernel se propage à l'ensemble du système. La compilation de kernels personnalisés permet une spécialisation extrême selon les formes de tenseurs, éliminant les inefficacités des kernels génériques.

L'évaluation paresseuse systématique autorise des fusions d'opérations impossibles dans les frameworks traditionnels. Cette approche réduit drastiquement les accès mémoire, souvent le goulot d'étranglement principal dans l'apprentissage profond.

Les défis à surmonter

Le statut alpha signifie que l'API peut encore changer, rendant TinyGrad inadapté pour des projets nécessitant une stabilité garantie. L'écosystème de bibliothèques tierces reste limité comparé à PyTorch qui bénéficie de milliers de packages communautaires.

Pour la plupart des cas d'usage actuels, PyTorch reste plus rapide car il a bénéficié d'années d'optimisation sur des patterns courants. TinyGrad mise sur le long terme : une fois que le compilateur sera pleinement optimisé, la simplicité architecturale devrait permettre de dépasser systématiquement PyTorch.

Comparaison avec les frameworks établis

Face à PyTorch, TensorFlow et JAX, TinyGrad adopte une philosophie différente. Plutôt que d'ajouter des fonctionnalités, il en retire. Cette approche minimaliste s'inspire des principes UNIX : faire une chose et la faire bien.

JAX partage certaines philosophies avec TinyGrad, notamment l'évaluation paresseuse et la compilation JIT. Cependant, JAX reste beaucoup plus complexe dans son implémentation interne. TensorFlow, avec son graphe de calcul statique, se rapproche conceptuellement mais souffre d'une complexité architecturale bien supérieure.

Cette tendance à la simplification se retrouve dans d'autres domaines technologiques, comme l'illustrent les défis d'interface utilisateur où la simplicité reste un objectif difficile à atteindre.

L'écosystème et la communauté

Le développement de TinyGrad se déroule principalement sur GitHub et Discord. La communauté, bien que plus petite que celle de PyTorch, se caractérise par un niveau technique élevé et une culture de l'optimisation poussée.

Les contributions sont encouragées et représentent le meilleur moyen de rejoindre Tiny Corp. Le projet maintient une documentation accessible sur tinygrad.org et publie régulièrement des mises à jour sur Twitter. Un canal Discord #tinybox permet aux propriétaires de machines d'échanger sur les optimisations et les configurations.

Vision à long terme : commodifier le petaflop

L'objectif déclaré de Tiny Corp est de "commodifier le petaflop et démocratiser l'IA pour tous". Cette ambition passe par deux axes : rendre le logiciel plus simple et donc plus accessible, et proposer du hardware performant à des prix disruptifs.

Le TinyBox à 12 000$ représente déjà une avancée significative dans l'accessibilité du calcul haute performance. Quand l'ExaBox arrivera en 2027, il pourrait redéfinir ce qu'une organisation de taille moyenne peut accomplir en termes d'entraînement de modèles.

Cette démocratisation rappelle comment les outils de génération d'images ont rendu accessible à tous ce qui nécessitait auparavant des graphistes professionnels.

En investissant dans TinyGrad, que ce soit par des contributions code ou par l'achat d'un TinyBox, les développeurs et les entreprises participent à un mouvement qui pourrait transformer l'infrastructure de l'IA. La simplicité architecturale, loin d'être une limitation, devient un avantage stratégique dans un domaine où la complexité croissante freine souvent l'innovation.

Pour ceux qui souhaitent explorer les possibilités de l'IA sans investir dans du hardware dédié, créez votre compte gratuit sur Roboto et découvrez comment notre plateforme peut accélérer vos projets de génération de contenu.