Un message vocal qui semble provenir de votre patron. Une vidéo troublante d'une personnalité publique. Une photo qui paraît authentique mais ne l'est pas. Les deepfakes s'imposent comme l'une des menaces numériques les plus préoccupantes de 2026. Grâce à l'intelligence artificielle, ces contenus synthétiques imitent avec une précision troublante la voix, le visage et les gestes d'une personne réelle. Sur les réseaux sociaux, dans les entreprises ou au sein des médias, les risques se multiplient : arnaques financières, usurpation d'identité, manipulations sexuelles ou campagnes de désinformation. La cybersécurité devient un enjeu concret pour chacun d'entre nous. Ce guide pratique vous aide à comprendre cette technologie, à identifier les signaux d'alerte et à adopter les bonnes pratiques de protection.

Qu'est-ce qu'un deepfake et pourquoi cette technologie progresse-t-elle si rapidement ?

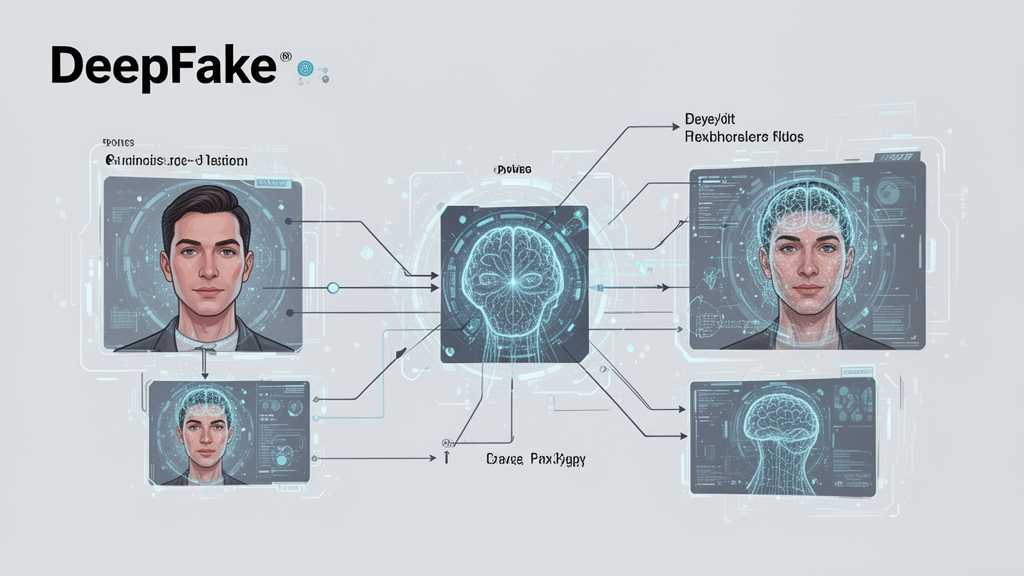

Un deepfake désigne un contenu multimédia créé ou modifié par intelligence artificielle pour donner l'illusion du réel. Il peut prendre la forme d'une image fixe, d'une séquence vidéo ou d'un extrait audio. Le principe repose sur l'imitation : le visage d'une personne, sa voix ou ses expressions sont reproduits avec un niveau de précision inédit. Pour le grand public, la frontière entre vrai et faux devient floue. L'information semble authentique, même lorsqu'elle ne l'est pas.

Cette technologie s'appuie sur l'apprentissage profond. Des algorithmes analysent des volumes massifs de données issues des réseaux sociaux, des médias ou des bases publiques. Le modèle apprend à reproduire des traits, des mouvements, une expression faciale, une intonation vocale. Chaque génération améliore la suivante. Le rendu gagne en cohérence et en naturel, ce qui complique considérablement la détection. Comme l'explique notre analyse sur la lutte contre la désinformation, les plateformes tentent de s'adapter face à cette évolution technologique.

Une démocratisation qui facilite les abus

La diffusion rapide des deepfakes s'explique d'abord par la démocratisation des outils. En mai 2026, il n'est plus nécessaire d'être expert pour produire une vidéo truquée. Des applications simples existent, certaines sont destinées au grand public, d'autres aux entreprises ou à la publicité. L'utilisation devient intuitive. Quelques clics suffisent pour créer un message crédible, parfois en quelques minutes seulement. Les capacités de calcul augmentent, les plateformes en ligne offrent un accès quasi illimité aux données publiques. Cette abondance explique la vitesse de propagation du phénomène à l'échelle mondiale.

À l'origine, ces créations servaient surtout à des fins créatives ou ludiques. Aujourd'hui, les risques sont bien réels : arnaques financières, usurpation d'identité, attaques ciblées contre des entreprises, contenus sexuels sans consentement. La cybersécurité ne se limite plus aux serveurs ou aux pare-feu. Elle concerne aussi la confiance que l'on accorde à une photo ou une voix que l'on croit authentique. La diffusion rapide des deepfakes transforme profondément notre rapport à l'information. Une vidéo ne constitue plus une preuve absolue, un message audio peut être falsifié.

Comment les deepfakes exploitent la voix, la vidéo et l'image pour tromper

Ces contenus exploitent nos réflexes humains. Ils assemblent différentes technologies d'IA pour produire quelque chose de fluide, cohérent, qui semble naturel dès le premier regard. À l'œil et à l'oreille, tout paraît cohérent. En 2026, le réalisme atteint un niveau qui dépasse souvent la simple curiosité technique. Une personne voit, entend, reconnaît. Le cerveau valide. L'illusion fonctionne, parfois sans éveiller le moindre doute.

Le clonage vocal : un levier puissant de manipulation

Le clonage vocal repose sur l'analyse de courts extraits audio disponibles en ligne. Quelques secondes suffisent. Le code apprend le timbre, le rythme, les pauses, les émotions. La voix générée semble familière, presque intime. Cette proximité crée un sentiment d'urgence ou de confiance : un message alarmant, un appel pressant, une demande financière inhabituelle. Les attaques jouent sur l'émotion plutôt que sur la logique.

Dans un contexte professionnel, une entreprise peut être ciblée via de faux ordres transmis à un collaborateur. Les secteurs industriels utilisant l'IA sont particulièrement exposés à ce type d'attaque, où un simple message vocal peut déclencher des transferts financiers ou des modifications de processus critiques.

La vidéo : une preuve qui n'en est plus une

La vidéo reste le support le plus persuasif. Elle mobilise le regard, les mouvements, les expressions du visage. Deux techniques dominent. D'abord, l'échange de visage : le visage d'une personne est superposé sur celui d'un autre individu, tout en conservant les gestes et les expressions. Ensuite, la synchronisation labiale : les lèvres sont modifiées pour correspondre à un nouvel audio. Le discours paraît naturel. Le message semble authentique. Même les utilisateurs avertis peuvent se laisser tromper.

Les vidéos en direct renforcent encore le risque. Lors d'une visioconférence, des filtres avancés modifient l'apparence en temps réel. Le public croit interagir avec la bonne identité. La détection devient complexe, surtout dans un échange rapide. Des outils comme les générateurs vidéo IA en temps réel montrent à quel point cette technologie est devenue accessible.

L'image fixe : un support discret mais redoutable

Les images fixes jouent un rôle clé dans de nombreuses fraudes. Elles servent de preuve visuelle ou de point d'ancrage. Des visages entièrement générés apparaissent sur les réseaux sociaux. Ces profils n'existent pas, mais semblent crédibles. Ils publient, commentent, interagent. D'autres images sont modifiées : un décor change, un objet apparaît, le contexte est détourné pour nuire à une personne ou renforcer une fausse information. Les outils de génération d'images IA permettent de créer des visuels d'une qualité telle qu'ils deviennent indiscernables de vraies photographies.

Quels sont les signaux concrets pour reconnaître un deepfake ?

Même avec les progrès de l'IA, certains détails révèlent encore qu'un contenu est faux. Apprendre à les repérer constitue une première ligne de défense essentielle dans un monde numérique où la manipulation devient de plus en plus sophistiquée.

Observer le visage et les micro-détails

Les visages peuvent sembler trop parfaits, sans pores ni rides, comme retouchés artificiellement, donnant cet effet étrange de "peau de porcelaine". Les yeux attirent aussi l'attention : clignements irréguliers, reflets incohérents par rapport à la lumière ambiante. Les contours du visage montrent parfois des flous ou des distorsions, surtout lors de mouvements rapides. Les mains ou les accessoires comme les lunettes peuvent être asymétriques ou mal positionnés.

Sur une vidéo, ces détails sont souvent les premiers signes qu'un matériel n'est pas authentique. Les technologies de manipulation d'images laissent parfois des traces subtiles dans les zones de transition entre le sujet et l'arrière-plan.

Vérifier la synchronisation audio-vidéo

La cohérence entre le son et l'image reste un point faible. Le mouvement des lèvres peut ne pas suivre parfaitement ce qui est dit. Une voix imitée peut paraître monotone, manquer de nuances ou prononcer certaines phrases de manière bizarre. Ces petits indices sonores permettent de repérer un message truqué. Portez attention aux respirations, aux micro-pauses naturelles du langage, aux variations d'intonation qui donnent vie à une vraie conversation.

Examiner le contexte et l'environnement

L'environnement autour de la personne peut révéler une manipulation : un éclairage illogique, des ombres qui ne correspondent pas, ou un arrière-plan instable avec des objets qui se déforment légèrement sont des signes à observer. Ces anomalies échappent souvent au premier regard, mais elles révèlent que des technologies avancées ont été utilisées pour fabriquer le matériel.

| Élément à vérifier | Signes d'un deepfake | Niveau de difficulté |

|---|---|---|

| Clignements des yeux | Rythme irrégulier ou absence totale | Facile |

| Texture de la peau | Trop lisse, sans imperfections naturelles | Facile |

| Synchronisation labiale | Décalage entre mouvement des lèvres et paroles | Moyen |

| Cohérence des ombres | Ombres incohérentes avec la source lumineuse | Moyen |

| Contours du visage | Flou ou distorsion lors de mouvements rapides | Difficile |

| Arrière-plan | Objets qui se déforment ou disparaissent | Difficile |

Vérifier les sources et croiser les informations

Ne vous fiez jamais uniquement à ce qui apparaît dans votre fil d'actualité. Remontez à la source originale. Consultez si l'information est relayée par des médias fiables. La recherche inversée d'images permet de contrôler rapidement un contenu en le comparant à d'autres versions. C'est une façon simple de ne pas se laisser piéger par des informations qui semblent vraies mais qui sont en fait fausses.

Dans les faits, un faux ne se dévoile presque jamais par un seul indice. Ce sont de petits détails, parfois discrets, qui finissent par éveiller le doute. Prendre un instant pour observer, réfléchir et vérifier avant de relayer une information fait toute la différence.

Comment se protéger efficacement contre les arnaques par deepfake ?

La protection contre les deepfakes repose sur une combinaison de vigilance personnelle, d'outils techniques et de bonnes pratiques numériques. Aucune solution n'est parfaite à elle seule, mais leur association réduit considérablement les risques.

Adopter une hygiène numérique rigoureuse

Limitez la quantité de données personnelles que vous partagez en ligne. Chaque photo, chaque vidéo, chaque enregistrement vocal peut potentiellement servir à créer un deepfake de vous. Configurez vos paramètres de confidentialité sur les réseaux sociaux pour restreindre l'accès à vos contenus. Évitez de publier des vidéos où vous parlez longuement face caméra, surtout si elles sont publiques.

Établissez des codes de vérification avec vos proches et collègues. Un mot de passe familial, une question secrète, ou un protocole de confirmation pour les demandes inhabituelles peuvent faire la différence. Si vous recevez un appel urgent demandant de l'argent, même avec une voix familière, raccrochez et rappelez sur le numéro habituel de la personne.

Utiliser des outils de détection et de vérification

Plusieurs solutions techniques émergent pour aider à identifier les deepfakes. Des extensions de navigateur analysent les vidéos en temps réel. Des applications mobiles vérifient l'authenticité des contenus multimédias. Des plateformes comme les outils de création graphique IA intègrent désormais des fonctionnalités de watermarking pour certifier l'origine des contenus.

Pour les entreprises, la mise en place de systèmes d'authentification multi-facteurs devient indispensable. Les protocoles de vérification d'identité doivent être renforcés, particulièrement pour les opérations sensibles. La formation des équipes aux risques liés aux deepfakes constitue un investissement essentiel.

Développer son esprit critique face aux contenus

Le meilleur outil de protection reste votre capacité de jugement. Posez-vous systématiquement ces questions :

- Cette information semble-t-elle cohérente avec ce que je sais de la personne ou de la situation ?

- Le ton, le vocabulaire, le style correspondent-ils à l'individu supposé ?

- Y a-t-il une urgence inhabituelle qui cherche à court-circuiter ma réflexion ?

- Cette demande sort-elle des procédures habituelles ?

- Puis-je vérifier cette information par un autre canal ?

Dans un contexte professionnel, méfiez-vous particulièrement des demandes financières urgentes, même si elles semblent provenir de votre direction. Les stratégies de communication multicanal permettent de croiser les sources et de vérifier l'authenticité des messages.

Le cadre légal et les initiatives contre les deepfakes en France

La France a commencé à adapter son arsenal juridique face à cette menace. Plusieurs textes de loi encadrent désormais la création et la diffusion de deepfakes, particulièrement lorsqu'ils visent à nuire, à manipuler ou à tromper.

Les sanctions pénales existantes

Le Code pénal français prévoit des sanctions pour l'usurpation d'identité numérique, la diffusion d'images intimes sans consentement, et la diffusion de fausses informations. Les deepfakes à caractère sexuel peuvent être poursuivis au titre du revenge porn, avec des peines pouvant aller jusqu'à deux ans d'emprisonnement et 60 000 euros d'amende. Les manipulations visant à influencer un scrutin électoral font l'objet de sanctions spécifiques.

En 2026, la législation européenne sur les services numériques (Digital Services Act) impose aux grandes plateformes des obligations de modération renforcées. Elles doivent mettre en place des systèmes de détection des contenus synthétiques et informer les utilisateurs lorsqu'un contenu a été généré par IA.

Les initiatives de sensibilisation et de formation

Des campagnes de sensibilisation sont menées auprès du grand public et des professionnels. L'Agence nationale de la sécurité des systèmes d'information (ANSSI) publie régulièrement des guides de bonnes pratiques. Les établissements scolaires intègrent progressivement l'éducation aux médias et à l'information numérique dans leurs programmes.

Les entreprises sont encouragées à former leurs collaborateurs, particulièrement ceux occupant des postes sensibles. Des certifications en cybersécurité incluent désormais des modules spécifiques sur les deepfakes et les techniques de manipulation par IA. L'approche rappelle celle adoptée pour la transformation pédagogique par l'IA, où la formation devient un enjeu central.

Les enjeux futurs et l'évolution de la menace

La course entre les créateurs de deepfakes et les systèmes de détection s'accélère. Chaque amélioration d'un côté entraîne une réponse de l'autre. Cette dynamique façonne l'avenir de notre relation à l'information numérique.

L'amélioration continue des techniques de génération

Les modèles d'IA deviennent plus performants. Les stratégies d'optimisation des modèles de langage s'appliquent également aux systèmes de génération multimédia. La qualité des deepfakes augmente, le temps de production diminue, les ressources nécessaires deviennent plus accessibles. Les deepfakes en temps réel, déjà possibles en 2026, vont se généraliser.

Les deepfakes multimodaux, combinant simultanément voix, visage et gestuelle de manière cohérente, représentent la prochaine étape. Ils seront capables d'adapter leur comportement en fonction du contexte, rendant la détection encore plus complexe.

Le développement de contre-mesures technologiques

Face à cette évolution, les systèmes de détection progressent également. L'analyse comportementale, qui étudie les micro-expressions et les patterns de mouvement propres à chaque individu, devient plus sophistiquée. Les techniques de watermarking invisible, intégrées dès la création du contenu, permettent de tracer l'origine et les modifications d'un fichier multimédia.

La blockchain et les technologies de certification décentralisée offrent des pistes prometteuses pour authentifier les contenus. Des consortiums industriels travaillent sur des standards communs de certification des médias. L'objectif : créer un écosystème où chaque contenu authentique peut être vérifié de manière indépendante.

L'importance de la responsabilité collective

La lutte contre les deepfakes ne peut reposer uniquement sur la technologie ou la législation. Elle nécessite une prise de conscience collective. Chaque utilisateur des réseaux sociaux, chaque consommateur d'information en ligne, chaque professionnel des médias porte une part de responsabilité.

Vérifier avant de partager, douter des contenus trop sensationnels, signaler les manipulations suspectées : ces gestes simples, multipliés par des millions d'utilisateurs, constituent une barrière efficace. Les plateformes doivent faciliter ces actions en proposant des outils de signalement intuitifs et en assurant un traitement rapide des contenus problématiques.

Les acteurs comme les grandes entreprises d'IA ont également une responsabilité particulière. Leurs choix en matière de diffusion de technologies, de mise en place de garde-fous et de transparence sur les capacités de leurs systèmes influencent directement l'ampleur du phénomène.

Conclusion : Rester vigilant dans un monde d'images synthétiques

Les deepfakes représentent l'un des défis majeurs de notre ère numérique. Leur réalisme croissant remet en question notre rapport à la preuve visuelle et sonore. Face à cette évolution, la vigilance devient une compétence essentielle. Apprendre à reconnaître les signaux faibles, adopter des réflexes de vérification, limiter son exposition numérique : ces pratiques constituent la base d'une protection efficace.

La technologie n'est ni bonne ni mauvaise en soi. Les mêmes outils qui permettent de créer des deepfakes malveillants peuvent aussi servir à des fins créatives, pédagogiques ou thérapeutiques. L'enjeu réside dans notre capacité collective à encadrer ces usages, à développer des contre-mesures efficaces, et à maintenir un niveau de confiance raisonnable dans l'information numérique.

En 2026, la frontière entre réel et synthétique continue de s'estomper. Mais cette évolution ne doit pas nous conduire au cynisme ou à la méfiance généralisée. Elle nous invite plutôt à développer un regard plus critique, plus informé, plus responsable sur les contenus que nous consommons et partageons. C'est cette vigilance active, combinée aux progrès technologiques et au renforcement du cadre légal, qui nous permettra de naviguer sereinement dans cet environnement en mutation.

Pour aller plus loin dans votre compréhension de l'intelligence artificielle et de ses applications, créez votre compte gratuit sur Roboto et découvrez comment utiliser ces technologies de manière éthique et productive.