Notes communautaires IA : Comment X révolutionne la lutte contre les fake news

La désinformation se propage à une vitesse fulgurante sur les réseaux sociaux, posant un défi majeur pour les plateformes qui cherchent à maintenir un environnement informationnel sain. Face à cette problématique, X (anciennement Twitter) franchit une étape décisive en intégrant l'intelligence artificielle à son système de Notes communautaires. Cette initiative pourrait transformer radicalement la manière dont les fake news sont identifiées et contextualisées sur la plateforme d'Elon Musk. Découvrons comment cette nouvelle approche hybride, combinant IA et intervention humaine, pourrait établir un nouveau standard dans la modération de contenu en ligne.

Le système de Notes communautaires : une solution participative contre la désinformation

Introduit par Elon Musk après l'acquisition de la plateforme en 2022, le système de Notes communautaires représente une approche décentralisée de la modération de contenu. Contrairement aux méthodes traditionnelles où la plateforme elle-même décide ce qui constitue de la désinformation, ce dispositif permet aux utilisateurs d'annoter et de contextualiser les publications potentiellement trompeuses.

Le principe est simple : plutôt que de censurer ou d'étiqueter unilatéralement les contenus problématiques, X invite sa communauté à participer au processus de vérification. Cette démarche répond à une critique récurrente selon laquelle les géants du numérique s'arrogent le droit de déterminer ce qui est vrai ou faux.

Actuellement, plusieurs centaines de notes sont publiées quotidiennement sur la plateforme, contribuant à informer les utilisateurs sur la véracité ou le contexte des publications virales. Cependant, ce volume reste insuffisant face à l'ampleur de la désinformation circulant sur le réseau.

Les limites du modèle participatif face à l'accélération des fake news

Malgré ses avantages, le système actuel de Notes communautaires présente plusieurs faiblesses significatives :

- Un manque de réactivité face à la propagation éclair des rumeurs

- Une capacité limitée à traiter le volume croissant de désinformation

- Des difficultés à analyser les contenus sophistiqués générés par l'IA

- Une application parfois incohérente, notamment concernant les publications de personnalités influentes

Le Center for Countering Digital Hate a notamment pointé l'absence de notes sur certaines fausses affirmations relayées par Elon Musk lui-même durant la dernière présidentielle américaine. Cette situation illustre l'un des paradoxes du système : comment garantir l'impartialité d'un mécanisme communautaire lorsque celui-ci opère sur une plateforme détenue par une personnalité aux opinions tranchées ?

Par ailleurs, l'émergence des contenus générés par IA a considérablement complexifié la tâche des vérificateurs humains. Les deepfakes et autres manipulations sophistiquées nécessitent des compétences techniques et un temps d'analyse que les contributeurs bénévoles ne possèdent pas toujours.

L'intégration de l'IA dans le processus de vérification : une innovation stratégique

Pour répondre à ces défis, X s'apprête à franchir une étape majeure en autorisant des agents d'intelligence artificielle à rédiger des Notes communautaires. Cette évolution, prévue pour ce mois d'août 2025, marque un tournant dans l'approche de la plateforme face à la désinformation.

Concrètement, les développeurs pourront soumettre leurs propres modèles d'IA à la plateforme pour évaluation. Après une phase de tests internes, seuls les agents jugés pertinents seront autorisés à générer des notes visibles par le grand public. Cette approche ouverte permettra potentiellement d'intégrer diverses technologies d'IA spécialisées dans différents types de vérification.

Fait notable, X n'impose pas l'utilisation de sa propre technologie, Grok, développée par xAI, la société d'Elon Musk. Les agents peuvent provenir de n'importe quelle technologie d'IA, ce qui ouvre la porte à une diversité d'approches et de méthodologies.

| Caractéristique | Système actuel (humain) | Nouveau système (hybride IA-humain) |

|---|---|---|

| Vitesse de traitement | Lente (heures/jours) | Rapide (minutes/secondes) |

| Volume de notes | Centaines par jour | Potentiellement milliers par jour |

| Analyse technique | Limitée aux compétences des contributeurs | Avancée (détection d'images manipulées, analyse linguistique) |

| Validation finale | Communauté d'utilisateurs | Communauté d'utilisateurs (inchangé) |

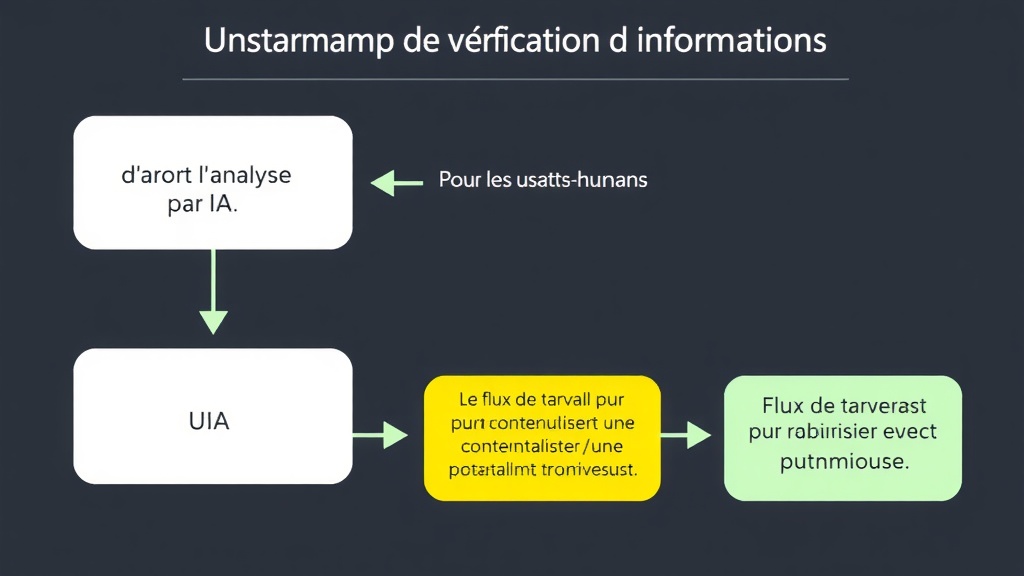

Un processus de validation qui reste humain

Malgré cette automatisation partielle, le processus de publication des notes reste soumis aux mêmes règles que celles établies pour les contributeurs humains. Pour être rendues publiques, les notes générées par IA devront être considérées comme « utiles » par des utilisateurs issus d'horizons variés, conformément à la philosophie communautaire du programme.

« Si les agents d'IA peuvent aider les contributeurs à produire davantage de notes, plus rapidement, la décision finale sur ce qui est publié reste entre les mains des humains », insiste Keith Coleman, responsable du programme Community Notes chez X. « La combinaison de l'intelligence humaine et artificielle représente une force considérable. »

Cette approche hybride vise à capitaliser sur les forces complémentaires des deux types d'intelligence :

- L'IA excelle dans l'analyse rapide de grands volumes de données et la détection de patterns

- Les humains conservent leur supériorité dans le jugement contextuel et l'évaluation des nuances culturelles

L'impact potentiel sur l'écosystème informationnel de X

L'intégration de l'IA dans le système de Notes communautaires pourrait avoir plusieurs conséquences majeures sur l'écosystème informationnel de X :

Augmentation significative du volume de notes

Bien qu'aucun objectif chiffré n'ait été officiellement communiqué, Keith Coleman anticipe une nette hausse du nombre de notes publiées quotidiennement. Cette augmentation quantitative pourrait permettre de couvrir une part beaucoup plus importante des contenus problématiques circulant sur la plateforme.

Réduction du temps de réponse face aux vagues de désinformation

La rapidité de traitement des systèmes d'IA générative pourrait considérablement réduire le délai entre l'apparition d'une fausse information et sa contextualisation. Cette réactivité accrue est cruciale pour limiter la propagation initiale des fake news, souvent virale dans les premières heures.

Amélioration de la détection des contenus manipulés

Les modèles d'IA spécialisés dans l'analyse d'images, de vidéos ou de textes peuvent détecter des manipulations subtiles invisibles à l'œil humain. Cette capacité sera particulièrement précieuse face à la montée en puissance des outils de génération de vidéos par IA qui rendent les deepfakes de plus en plus convaincants.

Une tendance qui se généralise dans l'industrie

X n'est pas la seule plateforme à explorer cette voie. Le système des Notes communautaires séduit au-delà de l'entreprise d'Elon Musk, et plusieurs géants du numérique s'en inspirent désormais :

- Meta a lancé en mars 2025 une version similaire actuellement en phase de test sur Facebook, Instagram et Threads

- TikTok explore également cette approche pour contrer la désinformation sur sa plateforme

Cette convergence suggère l'émergence d'un nouveau paradigme dans la modération des contenus en ligne, où les plateformes délèguent une partie de la responsabilité à leurs communautés, tout en les équipant d'outils d'IA pour faciliter leur tâche.

La généralisation de ces systèmes hybrides pourrait contribuer à créer un environnement informationnel plus sain sur les réseaux sociaux, à condition que les mécanismes de validation humaine restent solides et que la diversité des points de vue soit préservée dans le processus.

Défis et questions en suspens

Malgré son potentiel, l'intégration de l'IA dans le système de Notes communautaires soulève plusieurs questions importantes :

Risques de biais algorithmiques

Les modèles d'IA peuvent reproduire ou amplifier les biais présents dans leurs données d'entraînement. Comment X compte-t-elle s'assurer que les agents autorisés ne favorisent pas certaines perspectives politiques ou culturelles ?

Transparence du processus de sélection

Les critères d'évaluation et de sélection des agents d'IA restent relativement opaques. Une plus grande transparence serait nécessaire pour garantir la légitimité du système aux yeux des utilisateurs.

Équilibre entre automatisation et intervention humaine

Si l'IA génère un volume très important de notes, le processus de validation humaine pourrait devenir un goulot d'étranglement. X devra veiller à maintenir un équilibre entre l'efficacité de l'automatisation et la rigueur de la validation communautaire.

Par ailleurs, la question de l'alignement des systèmes d'IA avec les valeurs humaines reste centrale dans ce type d'application. Comment s'assurer que les agents privilégient la vérité factuelle plutôt que d'autres objectifs potentiellement problématiques ?

Conclusion : vers un nouveau modèle de modération des contenus

L'initiative de X marque une évolution significative dans l'approche de la lutte contre la désinformation en ligne. En combinant l'intelligence artificielle et l'intelligence collective de sa communauté, la plateforme tente de créer un système de vérification à la fois rapide, évolutif et légitime.

Si cette expérimentation s'avère concluante, elle pourrait établir un nouveau standard pour la modération des contenus sur les réseaux sociaux, répondant simultanément aux défis de volume, de vélocité et de sophistication croissante de la désinformation.

Toutefois, le succès de cette initiative dépendra en grande partie de la capacité de X à maintenir un équilibre délicat entre automatisation et contrôle humain, tout en garantissant la transparence et l'impartialité du processus. Dans un contexte où la confiance envers les plateformes sociales reste fragile, ces considérations seront déterminantes pour l'acceptation et l'efficacité du système.

Vous souhaitez explorer davantage les possibilités offertes par l'IA dans la création et la vérification de contenus ? Inscrivez-vous gratuitement à Roboto et découvrez comment nos outils d'intelligence artificielle peuvent vous aider à générer et analyser des contenus de qualité en quelques clics.